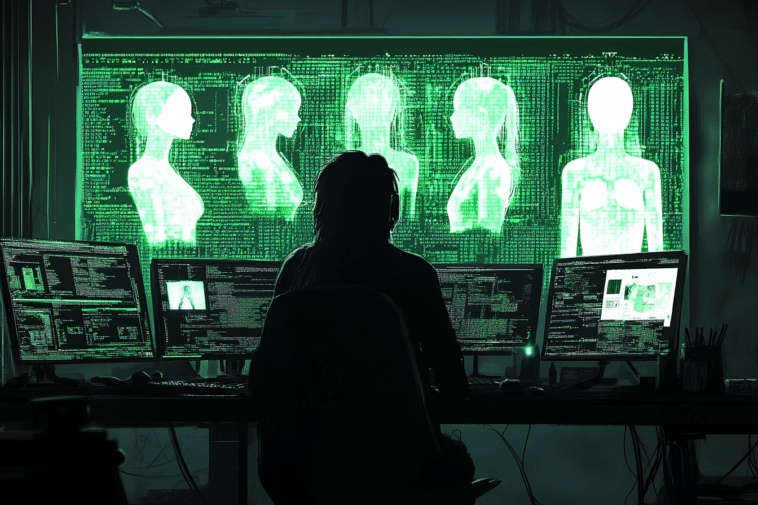

Découvrez comment les chatbots IA de cette plateforme ont été piratés, permettant de mettre à nus les secrets les plus sombres de ses utilisateurs.

L’univers des chatbots IA a connu un véritable séisme après ce scandale qui a fait couler beaucoup d’encres. En effet, le site Muah.ai, qui permet aux utilisateurs de discuter avec des chatbots IA érotiques, a été victime d’un piratage massif. Des données sensibles, révélant les fantasmes privés de milliers de personnes, ont été dérobées et pourraient être rendues publiques. Comment cette plateforme s’est faite piratée ? Est-ce que l’utilisation de l’IA présente des failles sécuritaires ? Découvrez ce que cette histoire pourra nous enseigner sur l’utilisation de l’intelligence artificielle dans ce qui suit !

Chatbots IA piratés : des données personnelles liées à des fantasmes érotiques intimes qui risquent d’être dévoilées ?

Muah.ai, une plateforme décrite comme un espace où les utilisateurs peuvent entretenir des conversations intimes, voire sexuelles, avec des chatbots alimentés par l’IA, a toujours promis à ses clients une confidentialité absolue. Chiffrement des communications, suppression de comptes simplifiée, et la garantie de ne jamais vendre les données à des tiers étaient les maîtres mots de la plateforme. Cependant, lorsque la plateforme fut piratée, il faut croire que la situation est toute autre !

Le hacker responsable de l’attaque a réussi à s’introduire dans la base de données de la plateforme. Il ou elle a pu accéder à des milliers d’échanges entre les utilisateurs et leurs chatbots. Les informations volées incluent des scénarios explicites, des fantasmes personnels et, dans certains cas, des sujets particulièrement choquants, tels que des références à des mineurs.

Ces discussions sont liées à des adresses e-mail, dont beaucoup semblent correspondre aux vrais noms des utilisateurs. On se demande donc si cette histoire ne va pas se tourner en cyberharcèlement ou en rançonnage. L’avenir nous le confirmera, mais jusqu’ici, nous pouvons dire que le hacker dispose des données sensibles qu’il peut utiliser à tout moment…

Chatbots IA non censurés ? Cette faille de sécurité bien apparente !

Celui qui a été à l’origine de ce hack a décrit Muah.ai comme « des projets open-source reliés par des gaines ». Cela sous-entend que la sécurité du site est loin d’être solide. Qui plus est, il s’est même vanté que ce piratage était un jeu d’enfant. Face à cette situation, l’administration de Muah.ai a affirmé que ce piratage avait été commandité par des plateformes concurrentes.

Cela proviendrait notamment d’entreprises qui proposent des chatbots IA pour adultes non censurés. Elle a aussi expliqué qu’une équipe de modérateurs se chargent d’effacer les contenus inappropriés, de leurs espaces de partage. Pourtant, des rapports indiquent le contraire.

Il faut croire que ce scandale de chatbots IA piratés chez Muah.ai met en lumière plusieurs questions. Étant donné que des applications IA non censurées peuvent tomber entre de mauvaises mains, est-ce qu’il ne faudrait pas revoir l’éthique et la régulation des technologies IA ?

En effet, cette non-censure laisse un vide juridique et éthique qui doive être comblé. Cela permettriat d’éviter ce genre de désagrément à l’avenir. Entre temps, ces failles sécuritaires risqueraient de détruire la réputation de leurs utilisateurs. De quoi obliger ces plateformes à améliorer leur sécurité à un niveau supérieur !

Que pensez-vous de ce genre de situation ? Est-ce que vous serez prêt à mettre en danger vos données personnelles pour interagir avec des chatbots IA ?

- Partager l'article :