La computer vision est une technologie qui vise à aider les ordinateurs à voir et à comprendre des contenus visuels. Cela paraît une tâche simple étant donné que les humains en sont naturellement capables. Mais est-ce vraiment le cas ?

Poursuivant l’idée que l’intelligence artificielle tend à imiter le fonctionnement d’un cerveau humain, la computer vision permet aux machines d’acquérir certaines de ses compétences. La vision par ordinateur combine l’intelligence artificielle avec des caméras pour permettre l’interprétation des données visuelles automatiquement, sans l’aide d’un humain.

En quoi consiste la computer vision ?

En termes simples, la computer vision est un domaine de l’intelligence artificielle qui donne aux ordinateurs la capacité d’extraire des informations significatives à partir de données numériques. Les données en question peuvent correspondre à des images, des vidéos ou d’autres types d’entrées visuelles. Ces informations permettront ainsi aux ordinateurs de prendre des décisions ou de recommander des solutions à un problème donné.

Autrement dit, la computer vision, qui est aussi un domaine du machine learning, étudie les technologies et les outils qui permettent aux ordinateurs de percevoir et d’interpréter des informations du monde réel. L’IA attribue aux machines une capacité cognitive, tandis que les caméras leur permettent de voir. Ensemble, ils forment la vision par ordinateur qui permet d’observer et de comprendre.

Les principes de la vision par ordinateur

À la différence des ordinateurs, les humains peuvent distinguer naturellement des objets, estimer leur distance et comprendre leur mouvement. En revanche, une machine doit s’entraîner à exécuter ces fonctions et cela prend plus de temps. À la place des yeux, elle se sert de données et d’algorithmes. Mais une fois qu’il est suffisamment entraîné, l’ordinateur peut facilement effectuer des tâches comme l’inspection de produits, le suivi des actifs de production, les différentes analyses, etc. Il est même possible qu’une machine formée à la computer vision finisse par devenir plus rapide que les humains.

La première partie du processus consiste donc à donner la « vue » à un ordinateur. Pour cela, il suffit d’y connecter une caméra. Ensuite, l’ordinateur devra classer et interpréter les données recueillies et en conclure leur relation et leur contexte. Ses tâches se résument donc à expliquer ce qu’il voit en temps réel.

L’origine de la computer vision

L’idée de développer des moyens afin que les ordinateurs voient et comprennent des données visuelles date d’environ une soixantaine d’années. Au fil des années, les utilisations et les technologies utilisées ont fait évoluer les notions de computer vision.

En 1959, des neurophysiologistes ont établi que le traitement d’images commençait avant tout par l’identification de formes simples et basiques. Beaucoup plus tard, le neuroscientifique David Marr établira que la vision fonctionne de manière hiérarchique. Des algorithmes seront introduits pour détecter les différentes formes de bases. Parallèlement, l’informaticien Kunihiko Fukushima mettra au point un réseau de cellules appelé Neocognitron, comprenant des réseaux de neurones convolutifs (CNN), capables de reconnaître des motifs.

Comment a-t-elle évolué ?

Dans les années 1960, l’IA a commencé à émerger en tant que domaine d’études universitaires. Parmi toutes les exploitations de l’IA, la résolution du problème de la vision humaine avait marqué cette époque. Grâce au balayage d’images, les ordinateurs pouvaient numériser et acquérir des images. Puis, en 1963, ils étaient capables de transformer les images en 2D en 3D.

Une dizaine d’années plus tard, l’OCR (reconnaissance optique de caractères) et l’ICR (reconnaissance intelligente de caractères) ont été introduites. Elles sont utilisées dans le traitement de documents, la reconnaissance des plaques d’immatriculation, les paiements mobiles, la traduction automatique, etc.

En 2000, la computer vision s’est concentrée sur la reconnaissance d’objets, puis la reconnaissance de visages en temps réel a vu le jour un an plus tard. En gros, les années 2000 ont été marquées par la normalisation de l’étiquetage des données visuelles. Cela a permis de mettre sur pied la base de données ImageNet qui constitue aujourd’hui une base pour les modèles de deep learning.

Comment fonctionne la computer vision ?

Comme toute technologie de l’intelligence artificielle, la base de la computer vision sont les données. Le système doit s’entraîner à discerner et à reconnaître les images sur une grande quantité de données.

Afin de mettre au point un système de vision par ordinateur, les développeurs doivent utiliser le deep learning ou un réseau de neurones convolutifs (CNN). Les modèles de deep learning permettent à un ordinateur de se renseigner automatiquement sur les contextes des données visuelles.

Quant au CNN, il décompose les pixels et leur attribue des balises ou des étiquettes pour effectuer des convolutions et faire des prédictions. Quand ces dernières se réalisent, c’est la définition même de la vision par ordinateur. Le traitement d’images par un CNN se fait de manière hiérarchique, comme dans un cerveau humain.

En 2025, la vision par ordinateur moderne s’appuie sur des architectures beaucoup plus avancées. Les CNN restent utiles, mais ils ont été largement complétés et, dans certains cas, remplacés par :

- Vision Transformers (ViT) : ces modèles exploitent des mécanismes d’attention pour analyser les images en tenant compte des relations à longue distance entre les pixels, offrant une précision supérieure dans la reconnaissance et la classification.

- MLP-Mixer : une approche purement basée sur les perceptrons multicouches (MLP) qui traite les images en mélangeant informations spatiales et canaux de manière efficace.

- Segment Anything Model (SAM) de Meta : conçu pour la segmentation universelle, capable de détecter et de segmenter automatiquement tout objet dans une image avec peu ou pas d’annotations manuelles.

Aujourd’hui, les systèmes de vision par ordinateur combinent souvent ces architectures avec des modèles pré-entraînés sur de très grandes bases de données (comme ImageNet ou LAION) et utilisent des techniques d’ apprentissage auto-supervisé pour réduire le besoin d’annotations manuelles.

Les éléments à prendre en compte

Maintenant que nous avons compris en quoi consiste la computer vision, et quelles techniques elle utilise, entrons un peu plus dans les détails. En effet, le visionnage semble être une tâche facile. Toutefois, la vision par ordinateur présente une grande difficulté : la classification. Autrement dit, il ne suffit pas de reconnaître des objets, il y a d’autres éléments à prendre en compte pour les discerner.

Tout d’abord, dans le monde réel, les données virtuelles sont conditionnées par les types d’éclairage. Ce premier élément peut modifier l’apparence ou la couleur d’un objet. Par ailleurs, le bruit des images peut également en compliquer la reconnaissance, tout comme le chevauchement des objets. D’autre part, il est important d’avoir des images sous plusieurs angles afin que l’ordinateur puisse reconnaître un objet en cas de changement d’angle.

En outre, la computer vision fait face à une autre difficulté : le discernement d’objets de mêmes types et de la fausse similitude. Par exemple, il existe de nombreux types de véhicules, mais l’algorithme doit réussir à reconnaître un camion et une moto. De même, il doit savoir discerner un dauphin d’une orque.

C’est donc pour résoudre toutes ces questions que la vision par ordinateur utilise les algorithmes d’intelligence artificielle (DL et CNN).

Les domaines d’applications de la computer vision

La capacité des ordinateurs à interpréter les données visuelles est utile dans différents domaines.

Une utilisation très courante touche la sécurité dans les entreprises, les usines, les écoles, etc. La reconnaissance faciale permet actuellement d’identifier les criminels et de réduire les risques de délinquances. Il en est de même pour la reconnaissance d’objets comme les armes. Dans un autre domaine, la computer vision peut aussi accélérer la vérification d’identité comme dans un aéroport.

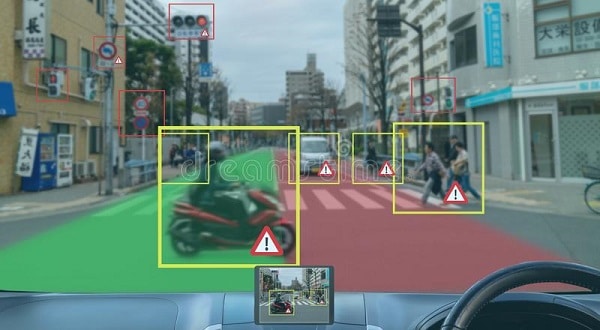

En outre, les entreprises technologiques sont de plus en plus motivées à développer des logiciels de véhicules à conduite autonome. Grâce aux capteurs radar et aux caméras, les voitures contribuent à la promesse d’un futur dans lequel les véhicules pourraient se déplacer sans conducteurs.

D’autre part, la classification d’images et la détection de motifs servent à développer des logiciels qui aident les médecins à diagnostiquer les maladies en scannant les dossiers des patients.

Dans les usines, la computer vision combine les données en temps réel des caméras à des algorithmes ML pour analyser les flux de données. Ce processus leur permet d’identifier les défauts de production et de qualité.

En gros, la vision par ordinateur peut être utilisée pour l’OCR, le contrôle des machines, la modélisation 3D, l’identification biométrique ou encore la capture de mouvement. En ce qui concerne la classification d’objets, elle permet de les détecter avec leurs repères, de les identifier, de les vérifier et de les segmenter.

Avantages de la computeur vision

La computeur vision peut automatiser plusieurs tâches sans nécessiter d’intervention humaine. Par conséquent, elle offre aux organisations un certain nombre d’avantages. Ci-dessous quelques une d’entre elles

Un processus plus simple

Désormais, plusieurs industries bénéficient de la technologie de vision par ordinateur. Ces systèmes servent une multitude d’objectifs, allant de la maintenance prédictive au contrôle de la qualité et à la sécurité sur site. En outre, la computeur vision permet d’effectuer des tâches répétitives et monotones plus rapidement. Ainsi, le travail des employés est simplifié.

De meilleurs produits et services

Ce n’est un secret que les machines ne font jamais d’erreurs. De même, les systèmes de vision par ordinateur dotés de capacités de traitement d’images ne risquent pas de faire des erreurs, contrairement aux humains. Au final, il en résulte une livraison plus rapide de produits et de services de haute qualité.

Réduction des coûts

Les machines prenant la responsabilité d’effectuer des tâches fastidieuses, les erreurs seront minimisées, ne laissant aucune place aux produits ou services défectueux. En conséquence, les entreprises peuvent économiser beaucoup d’argent qui serait autrement dépensé pour réparer des processus et des produits défectueux.

L’évolution de la computer vision

Avant l’avènement du deep learning, la computer vision ne pouvait effectuer que des tâches très limitées. Celles-ci nécessitaient beaucoup de codage manuel et d’efforts de la part des développeurs et des opérateurs humains. Par exemple, pour effectuer une reconnaissance faciale, il faut passer par certaines étapes. Celles-ci comprennent la création d’une base de données, l’annotation des images et enfin la capture de nouvelles images.

Mais le machine learning a fourni une approche différente pour résoudre les problèmes de vision par ordinateur. De ce fait, les développeurs n’avaient plus besoin de coder manuellement chaque règle dans leurs applications de vision. Au lieu de cela, ils ont programmé des « fonctionnalités », des applications plus petites capables de détecter des modèles spécifiques dans les images. Ils ont ensuite utilisé un algorithme d’apprentissage statistique pour détecter des modèles, classer des images

Le deep learning est une méthode très efficace pour la computer Vision. La création d’un bon algorithme de deep learning se résume à la collecte d’une grande quantité de données d’entraînement étiquetées et à la définition de paramètres. Par rapport aux types précédents de machine learning, le deep learning est à la fois plus facile et plus rapide à développer et à déployer.

La plupart des applications actuelles de computer Vision telles que la détection du cancer, les voitures à conduite autonome et la reconnaissance faciale utilisent le deep learning.

Les défis de la computer vision

Les possibilités de développement de la computer vision sont infinies. Mais malgré ses percées, il existe encore des points à améliorer.

Imiter la vision humaine

Certes, les algorithmes d’IA permettent aux ordinateurs de dériver des informations d’une manière similaire au cerveau humain. Néanmoins, pour une parfaite compréhension du fonctionnement de la vision humaine, il faudrait surtout comprendre davantage les organes de perception optiques.

Le contexte

La combinaison de l’IA et des caméras permet de trouver et d’identifier des objets sur une image. Toutefois, elle éprouve des difficultés à contextualiser la scène. Il s’agit d’un problème qui peut encore arriver à un humain qui ne connaît pas le contexte d’une photo. Autrement dit, il reste un long chemin à parcourir pour que la computer vision puisse atteindre un tel degré d’intelligence.

Pour être réaliste, il faudrait inventer une intelligence artificielle générale pour améliorer cet aspect. Mais actuellement, ce type d’IA omniscient est toujours du domaine de la fiction.

La confidentialité

La question de confidentialité reste à ce jour une grande préoccupation de la computer vision. Dans plusieurs pays, les gouvernements utilisent cette technologie pour des raisons de sécurité. Entre autres, ils collectent des données de caméras publiques pour identifier des criminels. Certes, il s’agit d’une cause pour le bien de tous, mais d’un autre point de vue, cela se traduit également par une atteinte à la vie privée. Des organismes font actuellement campagne pour interdire la reconnaissance faciale dans les endroits publics.

Les avancées récentes dans la computer vision

La computer vision a transformé notre interaction avec la technologie et amélioré de nombreux secteurs par ses avancées récentes. L’essor des réseaux de neurones profonds, notamment les architectures convolutionnelles, a permis des progrès significatifs dans la reconnaissance d’images et d’objets.

Des algorithmes d’apprentissage automatique, tels que les réseaux adversariaux génératifs (GAN), sont désormais capables de créer des images réalistes à partir de descriptions textuelles. Ce qui ouvre la voie à des applications innovantes dans les domaines de l’art et du design.

Par ailleurs, l’intégration de la vision par ordinateur dans des dispositifs mobiles a facilité le développement d’applications pratiques. C’est, par exemple, le cas de la réalité augmentée et du suivi de la santé. Les systèmes de surveillance basés sur la vision par ordinateur améliorent la sécurité publique. En revanche, les véhicules autonomes utilisent ces technologies pour naviguer en toute sécurité dans des environnements complexes.

En outre, les avancées dans le traitement d’images en temps réel permettent des interactions plus fluides et intuitives. Ce qui est avantageux à la fois dans le secteur du divertissement et dans celui de l’industrie. Ces progrès promettent de continuer à redéfinir nos expériences numériques et à offrir des solutions innovantes aux défis contemporains.

Les algorithmes de computer vision à connaître absolument en 2025

Le computer vision transforme radicalement notre interaction avec les technologies numériques. Cette discipline dépasse désormais la simple reconnaissance d’images pour atteindre une compréhension contextuelle sophistiquée. En 2025, trois algorithmes se distinguent en 2025 : SIFT, SURF et ORB. Chacun possède des caractéristiques uniques pour détecter et décrire des éléments visuels, avec des applications qui vont de la reconnaissance d’objets à la reconstruction tridimensionnelle.

SIFT (Scale Invariant Feature Transform) identifie des points caractéristiques uniques dans les images. Cet algorithme de reconnaissance robuste malgré les variations d’échelle et d’orientation. En revanche, une version optimisée de SIFT, SURF (Speeded Up Robust Features) privilégie la rapidité tout en maintenant une haute précision pour les traitements en temps réel.

En outre, ORB (Oriented FAST and Rotated BRIEF), une alternative open source rapide et efficace en 2025 est particulièrement adaptée aux environnements aux ressources limitées. Elle représente bien plus qu’une technologie. Elle constitue une révolution qui redessine les contours de l’interaction homme-machine.

- Partager l'article :