Bien que ChatGPT soit connu pour sa capacité de générer plusieurs types de contenu, il y a encore des tâches qu’il ne peut pas faire.

La popularité de ChatGPT n’a cessé d’augmenter ces derniers mois. Rédacteurs web, développeurs, poètes, tout le monde s’est mis à utiliser le fameux chatbot d’OpenAI. Mais malgré tout, il y a beaucoup de choses que ChatGPT refuse de faire.

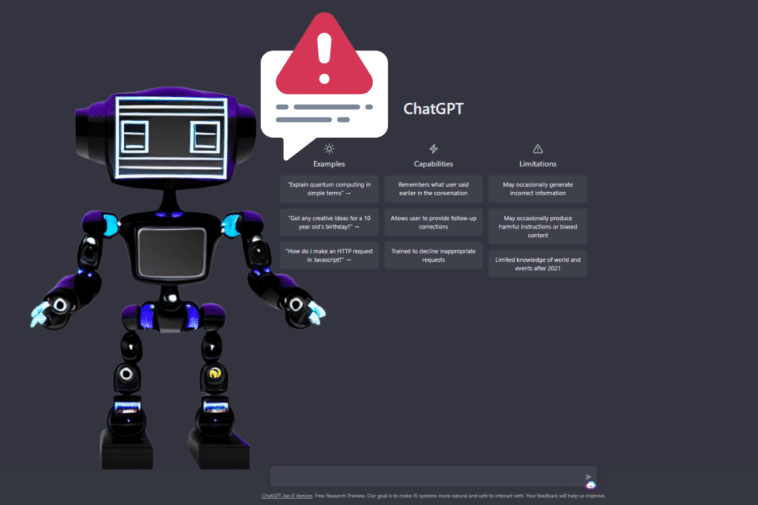

Des prouesses extraordinaires, mais des limites à ne pas franchir

Comme dit l’adage, un grand pouvoir implique une grande responsabilité. Mais ChatGPT d’OpenAI semble décliner certaines responsabilités. Il ne peut donc pas réaliser certaines tâches. OpenAI a cependant mis en place quelques précautions pour que son précieux chatbot ne fasse pas les tâches qu’il ne devrait pas faire.

ChatGPT a alors des limites qu’il ne peut pas franchir. Et cela en raison de son architecture, et donc des données qui ont servi à sa formation. Bien entendu, il est différent de GPT-3, mais certaines fonctionnalités sont en attente d’approbation pour que les utilisateurs puissent en bénéficier. Quitte à dire qu’elles ne verront jamais le jour.

Quelques tâches que ChatGPT ne peut pas faire

En attendant l’intégration de nouvelles fonctionnalités sur ChatGPT, voici les tâches qu’il ne peut pas faire.

La politique des partis : ChatGPT ne peut pas faire le choix d’un parti politique. Il est donc impossible de saisir un prompt qui demande au chatbot d’OpenAI de choisir entre n’importe quel parti.

Écriture de codes pour le développement de logiciels malveillants. Avec des prompts précis, ChatGPT peut devenir un excellent développeur. C’est pourquoi OpenAI a instauré des mesures restrictives sur l’exploitation du logiciel pour éviter la création de logiciels malveillants.

ChatGPT ne peut pas générer du contenu qui serait en relation avec la violence physique, la guerre, ni même les blessures. Ce qui l’empêche de discuter avec les utilisateurs sur la guerre en Ukraine ou les dommages pouvant y afférer.

Pas de préjugés, ni de discrimination. ChatGPT évite toute sorte de conversation pouvant avoir une relation avec le racisme, la sexualité, ainsi que le genre. Si l’utilisateur vient à le presser, ChatGPT préfère éviter catégoriquement toute tentative de discussion. Cela afin de prévenir les éventuels discours haineux.

ChatGPT ne peut pas prédire l’avenir à cause des données qui ont servi à son apprentissage. Mais aussi parce qu’OpenAI veut à tout prix réduire à néant les risques et éviter de prendre la responsabilité des erreurs.

ChatGPT ne peut pas fournir des réponses sur les sujets auxquels il n’a pas été formé. Et cela malgré toutes les données et la formation qu’il a reçue. Ce qui veut dire que le chatbot d’OpenAI n’est pas en mesure de générer du contenu sur des informations confidentielles.

La dernière limite de ChatGPT relève de la légalité des informations qu’il fournit. Il s’agit en effet d’un outil ayant une excellente force de proposition, mais qui n’a pas la capacité (ou ne veut pas) prendre en charge la gestion d’une entreprise.

- Partager l'article :