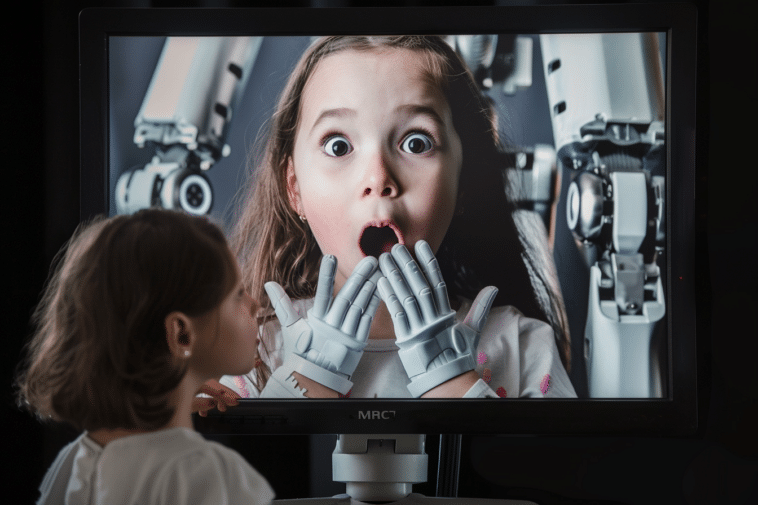

Les contenus générés par l’intelligence artificielle (IA) atteignent des sommets préoccupants. Des images d’abus sexuels sur mineurs produites par l’IA se propagent de manière alarmante sur le Web accessible à tous. Selon Internet Watch Foundation (IWF), la situation a franchi un « point de basculement ».

Les six derniers mois ont montré une explosion de ces contenus illégaux. Les contenus détectés affichent un niveau de sophistication troublant qui dépasse déjà les volumes observés l’année précédente. Ces images sont souvent créées en exploitant des visuels de véritables victimes qui rendent la situation encore plus critique.

Une sophistication qui brouille la détection

L’IWF souligne que la complexité croissante de ces images rend leur détection difficile. Les organismes de sécurité sont confrontés à une incertitude croissante quant à l’authenticité des images. De plus, ces contenus apparaissent davantage sur des forums publics, loin des réseaux obscurs du dark web.

L’IWF a traité 74 signalements de CSAM (Child Sexual Abuse Material) générés par l’IA sur les six derniers mois, . Chaque signalement peut contenir plusieurs images, ce qui amplifie la portée de ces violations en ligne. Ces chiffres démontrent l’urgence de renforcer les efforts de régulation.

Les plateformes mondiales en première ligne

Des pays tels que la Russie et les États-Unis héberge la majorité des contenus signalés. Le Japon et les Pays-Bas restent également concernés par une proportion significative de ces hébergements. L’IWF collabore avec des entreprises technologiques pour bloquer l’accès à ces URL et réduire leur visibilité.

D’ailleurs, huit signalements sur dix proviennent directement du public, alerté par ce type de contenus visibles sur des forums d’IA. Les vidéos deepfake sont également en augmentation et modifient du contenu adulte pour imiter du matériel pédopornographique. Ceci en ajoutant un autre niveau d’abus à ce problème croissant.

Instagram déploie des solutions préventives contre les abus

Pour limiter l’impact de la sextorsion, Instagram met en place une nouvelle fonctionnalité qui floute automatiquement toutes les images intimes envoyées en messages directs. Cette option permet aux utilisateurs de décider s’ils souhaitent visualiser ou non ces contenus.

Cette fonctionnalité reste activée par défaut sur les comptes d’adolescents et s’appliquera aux messages chiffrés. Les listes de suivis seront également masquées pour réduire l’exposition aux escrocs. Bien que ces mesures soient utiles, la vigilance des utilisateurs reste primordiale afin de signaler les comportements suspects.

- Partager l'article :