L’unité d’IA de Meta lance un nouveau système appelé FSL qui permet de détecter les contenus préjudiciables en quelques semaines.

Les plateformes de réseaux sociaux sont accessibles à tous et présentent de nombreux avantages pour les entreprises. Mais qui dit accessible à tous dit également sujets aux abus et aux utilisations malveillantes. Par conséquent, chaque plateforme doit prendre certaines mesures pour contenir et empêcher la propagation de ces contenus préjudiciables. À cette fin, Meta a présenté un nouveau système basé sur l’IA appelé FSL.

Lutte contre les contenus préjudiciables : Meta dévoile FSL

Sur les réseaux sociaux, les contenus préjudiciables continuent d’évoluer et les personnes qui en sont responsables cherchent sans cesse de nouveaux moyens de les introduire sur les plateformes. Pour les équipes des réseaux concernés, cela implique de développer des systèmes plus efficaces pour les empêcher de nuire.

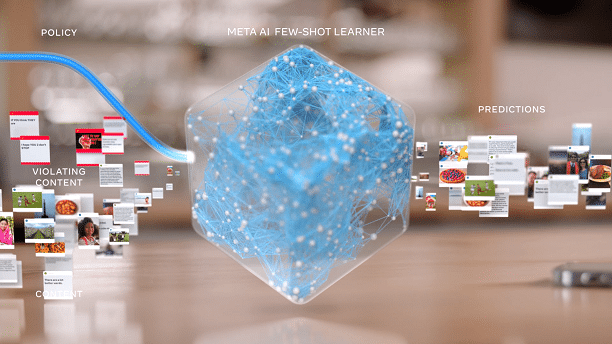

L’unité de recherche sur l’IA de Meta, anciennement Facebook, a annoncé hier un nouveau système appelé FSL ou Few-Shot Learner. Il permet de détecter les nouveaux types de contenus préjudiciables en quelques semaines si auparavant cela prenait des mois.

Le système utilise donc une méthode de machine learning appelée few-shot learning qui signifie apprentissage en quelques étapes. Entre autres, le modèle commence par la compréhension de nombreux sujets différents. Il s’entraîne ensuite sur un petit ensemble d’exemples étiquetés, voire aucun, pour apprendre de nouvelles tâches.

UN modèle entraîné au langage

Dans son article de blog, Meta explique que le système FSL peut fonctionner dans trois scénarios différents. Le premier, zéro-shot, ne nécessite aucun exemple de données étiquetées. Le deuxième que l’équipe décrit comme un few-shot avec démonstration implique l’utilisation d’un petit ensemble d’exemples (inférieur à 50). Enfin, pour le low-shot avec réglage fin, les développeurs peuvent affiner le modèle avec encore moins d’exemples. C’est donc cette réduction de la quantité de données d’entraînement qui permet à FSL d’obtenir un résultat en moins de temps.

La particularité de FSL réside également dans le fait que l’équipe de Meta l’a entraîné au langage. Autrement dit, le système ne repose pas sur la correspondance du modèle avec les données étiquetées. Par conséquent, il apprend le texte de la politique de la plateforme de manière implicite.

- Partager l'article :