Grâce au reinforcement learning multi-agents, ces chercheurs ont entraîné des robots à collaborer.

L’intelligence artificielle a permis aux robots de devenir plus autonomes. Certains dispositifs se comportent de plus en plus comme des humains. Un groupe de robots qui s’entraident et qui travaillent ensemble, qu’y a-t-il de plus humain ? En effet, c’est ce que les chercheurs de l’université de l’Illinois Urbana-Champaign (UIUC) ont mis au point.

Une collaboration entre robots ?

Généralement, la conception et le développement d’un robot se font individuellement. En d’autres termes, il s’entraîne à effectuer la tâche qui lui incombe sans l’aide d’une personne. Mais chez les humains, chaque individu ne travaille pas toujours seul. En effet, il arrive que pour mener à bien ses missions, une personne ait besoin de l’aide d’une autre personne.

L’IA vise à faciliter la tâche aux humains en tentant de reproduire le mieux possible sa manière de raisonner. Pour sa part, la robotique, qui a à peu près le même objectif, permet d’entreprendre des actions physiques. L’intelligence artificielle correspond donc au cerveau, et le robot au corps, pour ainsi dire.

De fait, l’idée de former un groupe de robots à travailler ensemble sur le même projet n’est pas étonnante. C’est même une suite logique aux évolutions de la technologie. Et afin d’y parvenir, l’équipe de l’université de l’Illinois Urbana-Champaign ont adopté une approche basée sur le reinforcement learning multi-agents (MARL).

Le reinforcement learning ou l’apprentissage par renforcement est une technique de machine learning. Il consiste à récompenser les agents IA en fonction de ses performances dans un processus d’essais et erreurs. Mais au lieu de former individuellement les agents, cette fois-ci, les chercheurs ont en donc déployé plusieurs dans un même environnement.

Le reinforcement learning multi-agents au service de la formation des robots

Dans cette nouvelle approche, plusieurs robots collaborent donc pour atteindre un même objectif. Un algorithme de reinforcement learning permet à un agent d’apprendre par lui-même à partir de ses erreurs ou de ses succès. Avec le MARL, un agent peut donc identifier quand un autre agent contribue à atteindre l’objectif global.

De même, grâce au reinforcement learning multi-agents, il peut également déterminer si l’autre robot agit de manière inutile. Il ne s’agit pas forcément d’une action qui va à l’encontre de la mission. En d’autres termes, cette action peut être inoffensive. Toutefois, si elle ne contribue pas à l’objectif, un autre agent peut la détecter.

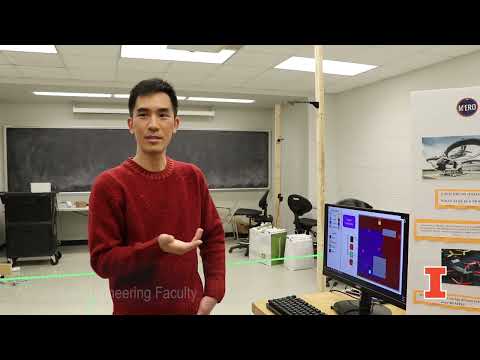

Pour tester la méthode, l’équipe de l’UIUC l’a appliquée dans des jeux simulés tels que Capture the Flag et StarCraft. Mais dans un contexte réel, cette nouvelle approche pourrait être utilisée dans le domaine de la surveillance militaire, l’entreposage, le contrôle de la circulation, etc. En fait, la combinaison du machine learning multi-agents à la robotique peut ouvrir la voie à plusieurs possibilités.

- Partager l'article :