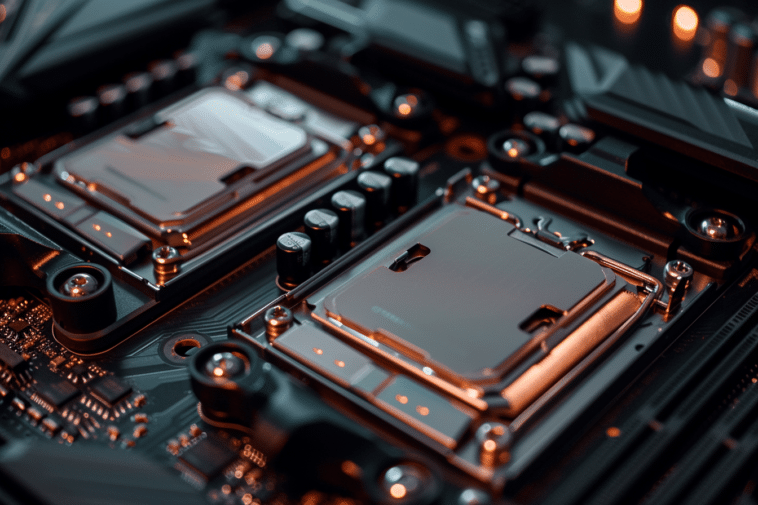

Google se lance dans la conception de son propre processeur sur mesure, Axion, basé sur l’architecture Arm. Le projet consiste à soutenir ses activités d’intelligence artificielle dans ses centres de données. La société dévoile alors une version améliorée de ses puces Tensor Processing Units (TPU) dédiées à l’IA.

Axion, le nouveau processeur ARM de Google sera d’abord exploité en interne pour alimenter les charges de travail d’IA de l’entreprise. Ce n’est qu’après qu’il sera proposé aux clients professionnels de Google Cloud.

Les puces Axion que Google a développées sont d’ores et déjà utilisées pour alimenter certains de ses services clés. Notamment les publicités YouTube, le moteur Google Earth et d’autres applications.

Faciliter le déploiement des services cloud des clients

Selon Mark Lohmeyer, vice-président de Google Cloud et directeur général de l’infrastructure de calcul et d’apprentissage automatique, il s’agit d’un projet dont le but est d’aider les clients de Google dans le transfert de leur charge de travail vers ARM.

« Le processeur Axion de Google a été conçu sur des bases ouvertes. Cette approche permet aux clients utilisant déjà des solutions ARM, quel que soit le fournisseur, d’adopter facilement Axion. Cela sans avoir à restructurer ou à réécrire leurs applications existantes », ajoute Lohmeyer dans sa déclaration.

Google assure que ses clients pourront déployer le processeur Axion dans divers services de son cloud. À savoir Google Compute Engine, Google Kubernetes Engine, Dataproc, Dataflow, et Cloud Batch.

Axion de Google : 50 % plus performant que les CPU Intel

D’après les informations partagées avec Reuters, le processeur Axion basé sur l’architecture ARM offrira des performances 30 % supérieures aux « puces ARM grand public » et 50 % meilleures que les processeurs Intel actuels.

En plus de son nouveau processeur Axion, Google met également à jour ses puces Tensor Processing Unit (TPU) dédiées à l’IA.

Ces TPU sont utilisées comme alternatives aux GPU Nvidia pour accélérer les tâches d’intelligence artificielle dans les entreprises.

Selon Mark Lohmeyer, le TPU v5p peut accélérer la formation des IA génératives les plus complexes.

Un seul pod TPU v5p contient 8 960 puces, soit plus du double de la quantité présente sur un pod TPU v4 précédent.

Pas de vente directe pour les clients de Google !

Google a annoncé la sortie de son propre processeur basé sur l’architecture Arm, quelques mois après que Microsoft ait dévoilé ses propres puces personnalisées pour son infrastructure cloud.

Microsoft a développé une puce dédiée à l’IA pour l’entraînement de grands modèles de langage. Mais aussi un processeur ARM spécialisé pour les charges de travail cloud et d’IA.

Amazon, de son côté, propose depuis plusieurs années des serveurs ARM basés sur son propre processeur personnalisé.

Google ne vendra pas ces puces directement à ses clients. Elles seront disponibles au sein de ses services cloud, que les entreprises pourront louer et utiliser.

Ainsi, Google a la possibilité de baisser sa dépendance envers des partenaires tels qu’Intel et Nvidia.

Mais il va continuer à les concurrençant sur le développement de puces personnalisées pour les charges de travail d’IA et de cloud.

- Partager l'article :