Des détecteurs d’IA affirment que la Bible et la Déclaration d’indépendance sont des faux numériques.

Un incident technique majeur vient de secouer le monde de l’édition et de la technologie. Des logiciels de détection d’intelligence artificielle ont classé plusieurs textes historiques majeurs comme étant le produit d’algorithmes modernes. Parmi ces documents figurent la Déclaration d’indépendance des États-Unis et des extraits de la Bible.

Un constat technique sans appel

Des experts ont récemment réalisé ces tests avec des outils de détection largement répandus sur le marché. Le résultat est tout simplement ahurissant. Et pour cause : le logiciel attribue la Déclaration d’indépendance de 1776 à une intelligence artificielle ! Le taux de probabilité est de 98,51 %. Deux siècles plus tard, les machines considèrent ainsi cet écrit de Thomas Jefferson comme une production artificielle.

Le phénomène ne s’arrête pas là. Des passages entiers de la Bible, ainsi que des décisions de justice rendues dans les années 1990, ont subi le même sort. Pour les algorithmes de surveillance, ces textes ne sont tout simplement pas humains. Cette situation met en lumière une faille technique dans les systèmes de vérification actuels. Ces derniers équipent pourtant déjà les écoles, les rédactions de presse et certains services administratifs.

Science et vie (https://t.co/IM88zLUUum)

— annie.tissot (@AnnieTissot) December 31, 2025

Un détecteur d'IA remet en question l'origine humaine d'un des textes les plus importants de l'Histoire

Un détecteur d'IA remet en question l'origine humaine de la Déclaration d'Indépendance de 1776.

Le fonctionnement des outils en cause

Les détecteurs d’IA ne lisent pas le texte comme un humain le ferait. Ils analysent des structures statistiques. Ils mesurent la perplexité (la complexité du vocabulaire) et la fluidité (la régularité du rythme des phrases). Le problème constaté vient du fait que les textes historiques ou sacrés utilisent souvent un langage très structuré, formel et prévisible.

Les modèles de langage modernes, tels que ChatGPT, ont été entraînés sur ces bases de données historiques pour apprendre à écrire correctement. Désormais, ils imitent ce style avec une grande précision. En conséquence, lorsque l’outil de détection analyse l’original de 1776, il y retrouve les schémas exacts qu’il a l’habitude de voir dans les productions des IA actuelles. L’algorithme confond l’original historique avec la copie numérique.

Des conséquences immédiates et concrètes

Cette confusion entre texte ancien et texte artificiel n’est pas qu’une simple curiosité technique. Elle produit déjà des effets dans le monde réel. Dans le milieu académique, des étudiants ont vu leurs travaux signalés comme frauduleux parce que leur style d’écriture, jugé trop propre ou trop formel, ressemblait aux standards des bases de données utilisées par les machines.

Dans le domaine du journalisme et de l’édition, des auteurs se retrouvent également ciblés. La difficulté réside dans le fait que ces outils de détection sont souvent présentés comme des arbitres de vérité. Or, cet incident démontre qu’ils peuvent invalider des documents dont l’origine humaine est pourtant historiquement prouvée.

L’effacement des indices physiques d’authenticité

L’analyse technique souligne un changement dans la perception des écrits. Auparavant, l’authenticité d’un document se validait par des éléments matériels comme l’encre, la qualité du papier ou la graphie spécifique d’un auteur. Avec la généralisation des supports numériques, ces repères disparaissent. L’écran uniformise la présentation des textes, rendant le style humain plus malléable et plus facile à imiter par des algorithmes. Cette uniformité visuelle accentue les erreurs des détecteurs, qui ne disposent plus de preuves physiques pour distinguer le travail d’un historien de celui d’un logiciel.

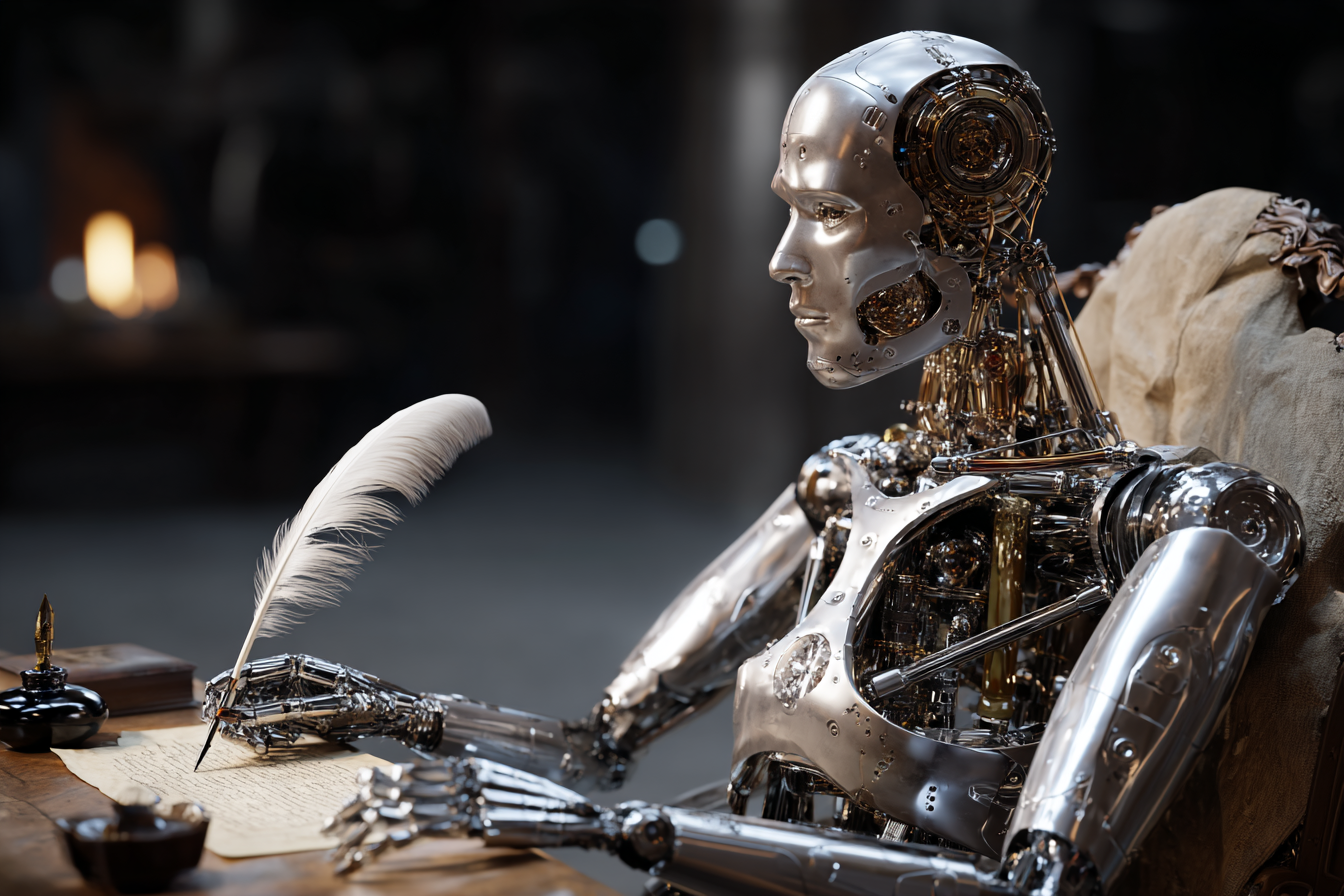

Une remise en question de la valeur de l’auteur

Face à ces défaillances répétées, certains spécialistes de la technologie proposent de déplacer le débat. Pour eux, en effet, l’origine d’un écrit pourrait devenir secondaire. Selon cette analyse, l’utilité du contenu et l’information transmise primeraient désormais sur l’identité de celui qui tient la plume, qu’il soit biologique ou numérique. Cette position marque un basculement dans la gestion de l’information. Elle pose toutefois des problèmes directs pour la propriété intellectuelle et la valeur symbolique des textes fondateurs.

Des sanctions automatiques sans recours

Le déploiement de ces outils dans les systèmes de modération et de vérification académique crée des situations de blocage. Des auteurs et des professionnels voient leurs manuscrits ou leurs articles rejetés par des plateformes automatisées sans possibilité réelle de prouver leur bonne foi. Les sanctions tombent de manière informatique, impactant des carrières et des réputations professionnelles sur la base de probabilités statistiques erronées. La confiance dans les systèmes de vérification est aujourd’hui entamée par cette incapacité des machines à reconnaître les racines de la culture humaine.

Une technologie sous surveillance

Pour l’instant, les développeurs de ces solutions de détection n’ont pas apporté de correction définitive à ce biais. Le constat est que plus un humain écrit de manière structurée et académique, plus il risque d’être classé comme une machine par ces logiciels.

L’événement marque un tournant dans l’utilisation de ces outils de contrôle. Des outils qui se généralisent pour contrer la triche ou la désinformation. Cependant, leur incapacité à distinguer un texte fondateur d’une production logicielle jette un doute sur la fiabilité des sanctions. Les documents historiques, par leur perfection grammaticale, sont devenus les premières victimes de ces erreurs d’identification.

- Partager l'article :