Cette nouvelle approche utilise un contexte plus réaliste pour détecter les deepfakes à l’aide des réseaux neuronaux convolutifs.

Le deepfake évolue comme toute invention technologique. Alors que certains médias synthétiques reflètent tout simplement le progrès des chercheurs, d’autres ont des objectifs moins inoffensifs. De ce fait, le besoin de développer des outils de détection efficaces est de plus en plus urgent.

La technologie progresse

Le terme deepfake fait référence à la création de faux médias à l’aide de l’intelligence artificielle. Il peut s’agir d’une image, d’une vidéo, d’un son ou d’un texte. Cette branche de la technologie évolue à une vitesse impressionnante et les faux médias sont de moins en moins distinguables des vrais. Concernant les visages, par exemple, les humains trouvent déjà que les deepfakes sont plus fiables que les images réelles.

D’une part, cette évolution rapide signifie que les recherches en IA/ML progressent rapidement. Mais d’autre part, cela peut se traduire par un plus grand risque d’utilisation des deepfakes à des fins préjudiciables. Par conséquent, en même temps que la technologie avance, le développement des outils pour détecter les deepfakes s’impose.

Une meilleure approche pour détecter les deepfakes

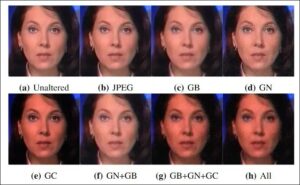

Généralement, pour générer une vidéo deepfake, les créateurs intègrent un visage à une vidéo existante avec une dégradation intentionnelle de l’image réelle. Ensuite, les médias créés sont compressés à l’aide d’un auto-encodeur ou d’une autre manière.

Actuellement, pour détecter les deepfakes, l’approche la plus courante consiste à utiliser des réseaux neuronaux convolutifs. Cependant, malgré les avancées dans le domaine, certains chercheurs estiment que les détecteurs sont souvent évalués dans des contextes non réalistes. En d’autres termes, la dégradation des images causées par la compression, le bruit ou l’amélioration n’est pas suffisamment prise en compte.

Dans une nouvelle étude, des chercheurs suisses proposent donc une nouvelle approche pour détecter les deepfakes dans des conditions plus réalistes. Elle vise à apprendre aux systèmes de détection à identifier les caractéristiques des images ayant subi une dégradation.

Notons que des études antérieures ont exploré la piste de dégradation pour développer des détecteurs. Mixup (MIT et FAIR) etAugiMix (Google et DeepMind) utilisent, par exemple, des réseaux neuronaux pour brouiller le matériel d’entraînement. D’autres méthodes consistaient à appliquer un bruit gaussien et des artéfacts de compression aux données de formation.

Quant à cette nouvelle approche, elle vise à simuler les conditions d’acquisition, de compression et des autres algorithmes de dégradation. Cela permet de produire des données d’entraînements plus résistants pour les détecteurs de deepfakes. Le nouveau modèle prend en compte le bruit, le redimensionnement, la compression, le lissage, l’amélioration ou la combinaison de ces différentes méthodes.

- Partager l'article :