Un deepfake est un faux média alimenté par l’intelligence artificielle. Sur internet, il est plus important que jamais de savoir distinguer les fausses informations des vraies. Avec l’avancée de la technologie, créer des contenus médias très réalistes est devenu un jeu d’enfant.

L’intelligence artificielle a permis de faire des progrès considérables dans tous les domaines. Mais l’utilisation de ces nouvelles technologies n’est pas toujours pour le bien de tous. Allant des fraudes à la génération de vidéos inappropriées de certaines célébrités, le deepfake est un parfait exemple de la manière dont elles peuvent présenter des menaces importantes.

Qu’est-ce que le deepfake ?

Le mot « deepfake » est la combinaison de deux concepts : « deep learning » et « fake ». En termes simples, il fait référence à de faux contenus multimédias (vidéos, images, audios) générés à l’aide de l’apprentissage en profondeur. Il s’agit d’une technologie qui permet de créer des scènes qui ne se sont pas véritablement produites en utilisant les visages ou les voix de personnes réelles. Autrement dit, elle peut placer n’importe quel visage sur une vidéo ou une image à laquelle il n’a pas participé. Une vidéo deepfake peut, par exemple, montrer un politicien prononçant un discours qu’il n’a jamais réellement tenu.

Toutefois, précisons qu’il existe d’autres outils de création de contenus réalistes qui n’appartiennent pas à ce domaine. AI Studios SaaS, par exemple, est un outil qui permet de créer des vidéos d’humains sans filmer une personne réelle. En gros, ces systèmes de montage de vidéos et d’images permettent de créer des contenus beaucoup plus rapidement avec moins de ressources.

D’où ça vient ?

C’est dans les années 1990 que des institutions universitaires ont commencé à développer la technologie deepfake. En termes d’informatique, elle appartient au domaine de la computer vision. Parmi les premiers projets figurait Video Rewrite, un outil de réanimation faciale. Il consistait à établir un lien entre un visage et les sons produits par une personne dans une vidéo.

Ensuite, des applications comme Face2Face visaient à imiter les expressions faciales d’une autre personne en temps réel. Plus tard l’application du deepfake s’est étendue à l’ensemble du corps, ainsi qu’à d’autres domaines.

Comment fonctionne le deepfake ?

Pour réaliser un deepfake, le créateur cible une personne réelle et se base sur le machine learning pour analyser les données et créer un modèle. Dans tous les cas, le créateur doit partir d’une vidéo cible et d’une collection de pistes vidéo de la personne à insérer dans la vidéo.

Dans le processus de ML ou d’apprentissage automatique, une machine est alimentée de données pour apprendre par elle-même à créer un modèle cohérent à partir de ces informations.

Le deep learning

Le deep learning est une sous-catégorie du machine learning qui implique l’utilisation de plusieurs couches de réseaux de neurones pour traiter les données à différents niveaux.

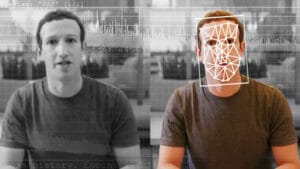

Échanger les visages

Pour créer un deepfake, une technique de DL consiste à utiliser des autoencodeurs pour substituer un visage. Notons que les vidéos montrant la personne cible peuvent ne présenter aucun rapport avec la vidéo cible au niveau du décor et de l’activité. Le rôle de l’autoencodeur est d’analyser les clips vidéo pour étudier la personne sous différentes conditions (angles, éclairage, etc.). Ensuite, il doit trouver des caractéristiques communes entre ces clips et la vidéo cible. Enfin, à l’aide de techniques d’infographie, il doit superposer une copie de la personne cible sur un autre acteur de la vidéo cible.

Cette technique est plus simple et plus rapide, mais le résultat peut aussi présenter des incohérences. Ainsi, le créateur doit encore faire des ajustements manuels pour éviter les blips et les indices révélateurs de faux contenus.

Reproduire les expressions faciales

Pour un résultat plus convaincant, le créateur peut choisir d’analyser les mouvements du visage de la personne cible, toujours en s’appuyant sur le DL. Cette technique permet d’établir une correspondance entre la bouche et le visage de l’acteur de la vidéo cible. En d’autres termes, les réseaux de neurones apprennent comment fonctionne un visage pour transférer ces informations à un autre visage.

D’autre part, un deepfake est plus crédible si la voix de l’acteur ressemble à la voix originale de la personne cible. Avec la même technologie d’apprentissage en profondeur, le créateur peut générer une voix synthétique basée sur des échantillons de la voix à reproduire.

Les réseaux antagonistes génératifs ou GAN

Les GAN correspondent à un autre type d’algorithme de deep learning qui permettent de générer de nouvelles instances de données qui imitent la réalité. Les contenus qui résultent de la generative AI sont souvent très précis.

Cependant, la grande quantité de données nécessaires pour entraîner les GAN les rendent plus difficiles à utiliser. Autrement dit, ils sont bons pour synthétiser des images, mais quand il est question de vidéos ou audios, les créateurs préfèrent utiliser d’autres algorithmes.

Un deepfake, à quoi ça sert ?

La capacité d’une technologie à remplacer des visages ou à créer des contenus synthétiques ouvre forcément la porte à plusieurs possibilités. Le deepfake peut par exemple jouer un rôle important dans le cinéma ou dans les jeux vidéo pour permettre aux personnages de prononcer n’importe quelle phrase. Dans le cas d’un producteur de films, cela offre une possibilité de simuler la présence d’un personnage dans un décor. Mais la plupart du temps, le concept de deepfake est relié à l’aspect troublant et menaçant de la technologie.

Les plus grandes menaces liées au deepfake

Une des premières applications du deepfake dans le monde réel est la création de contenus pornographiques synthétiques. En effet, en 2017, un utilisateur de Reddit a créé un forum de pornographie deepfake. Il a publié des vidéos d’acteurs dont les visages ont été remplacés par ceux de célébrités. Le code original est toujours disponible en open source. En 2019, la pornographie constituait 96 % des vidéos deepfakes trouvés en ligne. Des organismes luttent aujourd’hui pour interdire ces applications dont les femmes sont les plus victimes. Mais outre la pornographie, d’autres scénarios compromettants pourraient faire d’autres victimes de harcèlement et pas uniquement des femmes.

Mais un deepfake n’est pas forcément une vidéo. Les deepfakes audios sont également en pleine expansion. Et tout comme les vidéos, ils peuvent présenter une menace importante. L’année dernière, des fraudeurs ont réussi à voler plus de 240 000 $ en reproduisant la voix du PDG d’une entreprise au Royaume-Uni. Dans un autre cas, une voix deepfake a même permis de voler une somme de 35 millions de dollars à une banque aux Émirats arabes unis.

Le deepfake, une excuse ?

La politique représente un autre domaine dans lequel les faux contenus se font nombreux. Par exemple, en 2018, dans une vidéo deepfake, Donald Trump appelait la Belgique à se retirer de l’accord de Paris sur le climat. Une autre vidéo publiée par les chercheurs du MIT (Massachusetts Institute of Technology) a aussi montré Richard Nixon en train de prononcer un discours dans le cadre d’Apollo 11.

Mais la plus grande crainte est que les politiciens pourraient se retrouver dans des vidéos compromettantes lors des campagnes d’élection. Toutefois, le deepfake pourrait aussi devenir un prétexte pour excuser les actes répréhensibles des personnalités politiques.

Existe-t-il un moyen d’identifier les faux médias ?

Bien que les contenus deepfakes semblent réels à première vue, souvent il existe quelques indicateurs qui les trahissent. En général, les vidéos ou les images deepfake présentent certaines incohérences au niveau de l’animation des visages. Par exemple, dans un deepfake, il arrive qu’une personne ne cligne jamais des yeux ou alors il le fait beaucoup trop de fois. Ces anomalies peuvent également apparaître au niveau de la bouche.

D’autre part, la présence de zones floues sur la peau ou sur le visage peut également indiquer qu’il s’agit d’un faux média. De même, une grande différence d’éclairage entre la vidéo cible et les clips utilisés peut être évidente sur un deepfake. Enfin, si l’audio ne correspond pas à l’acteur du vidéo, ou que le son semble truqué, il s’agit probablement d’un contenu synthétique.

Utiliser la technologie pour lutter contre les deepfakes

Les éléments que nous avons cités précédemment peuvent suffire pour détecter un deepfake, mais pas tout le temps. Effectivement, en matière de nouvelles technologies, les cybercriminels ont toujours une longueur d’avance. Autrement dit, certains créateurs de faux médias maîtrisent les outils mieux que d’autres, et produisent des contenus plus difficiles à discerner. Et même s’il ne s’agit pas réellement de crimes graves, les dégâts ne sont pas moins négligeables.

Par conséquent, il existe des méthodes pour repérer les deepfakes, développés par différentes entreprises et startups. La plateforme Sensity, par exemple, agit comme un antivirus pour alerter les utilisateurs par courriels. Elle se base sur l’IA pour repérer des indicateurs de médias synthétiques. C’est également le cas de Reality Defender et de Deeptrace qui filtrent les contenus médias avant qu’ils n’atteignent les boîtes de réceptions.

Une autre approche, comme celle d’Operation Minerva, consiste à comparer un deepfake potentiel à des empreintes numériques, ou des vidéos existantes cataloguées sur la plateforme.

En outre, certains gouvernements disposent de lois concernant les faux médias, et particulièrement la pornographie deepfake.

FAQ

Un deepfake est une technique de manipulation d’images et de vidéos. Il permet de remplacer le visage ou la voix d’une personne par celle d’une autre. Cette technologie utilise des algorithmes d’intelligence artificielle pour créer des contenus audiovisuels extrêmement réalistes qui semblent authentiques mais sont entièrement fabriqués.

Le fonctionnement des deepfakes repose sur des réseaux de neurones profonds. Ces algorithmes analysent des milliers d’images d’une personne pour comprendre ses expressions, ses mouvements et ses caractéristiques faciales. Ils utilisent ensuite des modèles d’apprentissage automatique pour superposer un visage sur un autre avec une précision stupéfiante. Les algorithmes comparent et fusionnent les données visuelles pour produire des vidéos.

Pour repérer un deepfake, plusieurs indices peuvent alerter un spectateur attentif. Les incohérences dans les mouvements faciaux, les anomalies de luminosité, les variations étranges des expressions et les défauts de synchronisation audio constituent des signaux importants.

Le simple fait de regarder un deepfake n’est généralement pas illégal en soi. Cependant, si le contenu implique des éléments illicites comme la pornographie non consensuelle, l’incitation à la haine ou la diffamation, sa consommation peut tomber sous le coup de la loi. Certains pays ont adopté des législations spécifiques qui criminalisent la création et la diffusion de deepfakes malveillants. La responsabilité légale concerne principalement les créateurs et distributeurs plutôt que les spectateurs.

- Partager l'article :