La détection des deepfakes fait un bond de géant. Dans ce contexte, des chercheurs utilisent des techniques astronomiques pour démasquer les portraits générés par l’IA. Cette méthode inédite, inspirée de l’analyse des galaxies, révolutionne l’identification des faux visages numériques.

Lors de la réunion annuelle de la Royal Astronomical Society, une équipe dirigée par l’étudiante en master de l’Université de Hull, Adejumoke Owolabi, a trouvé que les réflexions lumineuses dans les yeux des humains deepfakés ne s’alignent tout simplement pas.

« Les réflexions dans les yeux sont cohérentes pour la vraie personne, mais incorrectes (d’un point de vue physique) pour la personne fausse. » a déclaré Kevin Pimbblet, professeur d’astrophysique à l’Université de Hull.

Une application ingénieuse

C’est une solution créative et non conventionnelle de la recherche scientifique. Elle pourrait avoir des implications utiles. Les générateurs d’images par IA deviennent de plus en plus aptes à générer des images photoréalistes de personnes qui n’existent pas.

En optant pour des méthodes conventionnellement utilisées pour « mesurer les formes des galaxies« , selon Pimbblet, son équipe a découvert que les images deepfake n’ont pas la même cohérence dans les réflexions entre les deux yeux.

« Nous détectons les réflexions de manière automatisée. Ensuite, nous faisons passer leurs caractéristiques morphologiques par les indices CAS [concentration, asymétrie, douceur] et Gini pour comparer la similitude entre les yeux gauche et droit., » a expliqué Pimbblet. « Les résultats montrent que les deepfakes présentent certaines différences entre la paire.«

Le coefficient de Gini

Le coefficient de Gini mesure la distribution de la lumière dans une image donnée d’une galaxie. Il ordonne les pixels par leur luminosité et compare les résultats à une distribution parfaitement homogène.

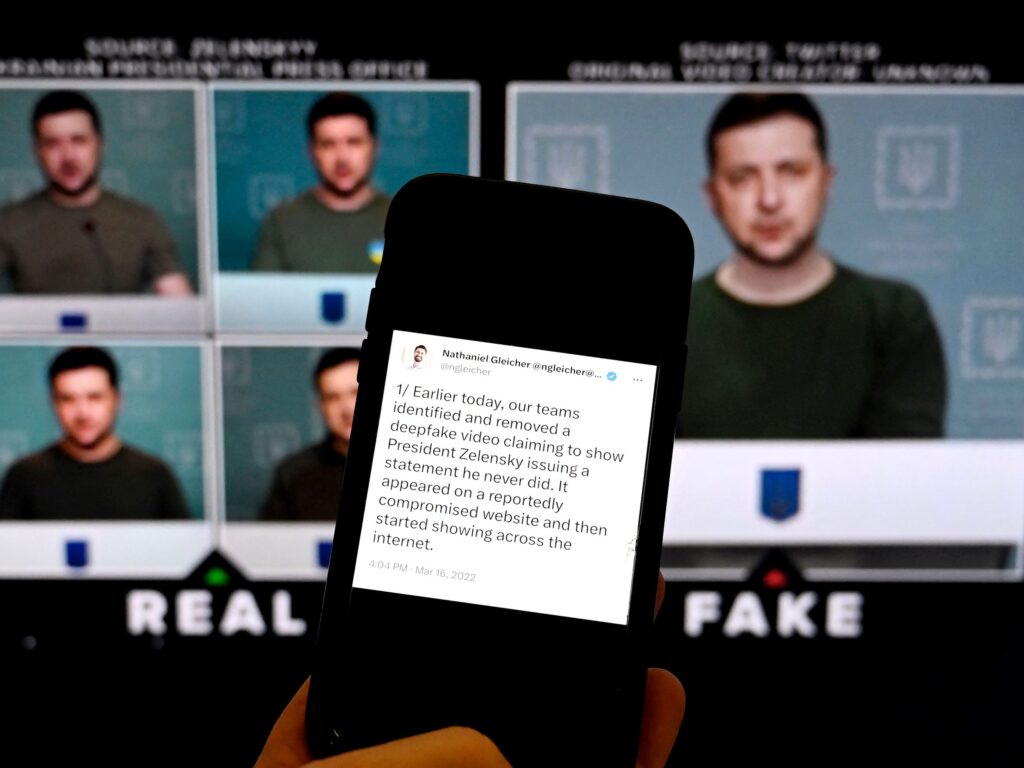

Pouvoir différencier de manière fiable les images deepfake des photos réelles est plus important que jamais. Cela est dû au potentiel de tromperie, à la diffusion de la désinformation et à la manipulation des agendas politiques.

L’importance de cette méthode devient de plus en plus cruciale à mesure que les deepfakes deviennent plus sophistiqués. La capacité de détecter ces faux pourrait jouer un rôle clé dans la préservation de l’intégrité des informations et la protection contre les abus potentiels.

Limites de la méthode

Malheureusement, la méthode récente des chercheurs n’est pas infaillible. « Il est important de noter que ce n’est pas une solution miracle pour détecter les images fausses,« a précisé Pimbblet. « Il y a des faux positifs et des faux négatifs ; ce n’est pas infaillible. Mais cette méthode nous fournit une base, un plan d’attaque, dans la course aux armements pour détecter les deepfakes.«

Bien que la méthode actuelle ne soit pas parfaite, elle représente une avancée significative dans le domaine de la détection des deepfakes. À mesure que les chercheurs affinent leurs techniques, la précision de la détection devrait s’améliorer.

Une course aux armements

La lutte contre les deepfakes est une guerre technologiques. Chaque nouvelle avancée dans la génération d’images par IA entraîne des efforts accrus pour développer des méthodes de détection plus robustes. Le travail de l’équipe de Pimbblet est un pas important dans cette direction.

Les implications de cette recherche vont au-delà de la simple détection des deepfakes. Elles ouvrent des avenues pour de nouvelles applications de la science astronomique dans des domaines inattendus. La collaboration entre des disciplines aussi diverses que l’astrophysique et l’intelligence artificielle pourrait bien être la clé pour relever les défis de l’avenir numérique.

En somme, la découverte des chercheurs de l’Université de Hull apporte une nouvelle perspective sur la détection des deepfakes. Cette méthode offre une base prometteuse pour de futures recherches et applications.

- Partager l'article :