Alors que les modèles « Frontier » comme Gemini 3.1 Pro repoussent les limites du raisonnement complexe, Google a surpris l’écosystème tech le 3 mars 2026 en dévoilant son modèle le plus agile à ce jour : Gemini 3.1 Flash-Lite. Conçu spécifiquement pour les développeurs et les infrastructures d’entreprise, ce nouveau venu ne cherche pas à rivaliser avec les capacités doctorales de ses aînés.

Son ambition est ailleurs : traiter des volumes de données massifs à une vitesse fulgurante et pour un coût presque dérisoire.

Positionné directement face à GPT-5 mini d’OpenAI et Claude 4.5 Haiku d’Anthropic, Gemini 3.1 Flash-Lite s’impose déjà comme le modèle petites mains indispensable pour l’automatisation industrielle.

Le « Curseur de Raisonnement » : comment Google casse les prix de l’IA

L’une des innovations majeures introduites avec cette version 3.1 est la possibilité pour les développeurs de moduler la profondeur de réflexion du modèle.

On peut alors adapter l’intelligence à la complexité de la tâche

Contrairement aux modèles rigides, Gemini 3.1 Flash-Lite propose des niveaux de raisonnement configurables.

Concrètement, en tant que développeur, vous pouvez choisir un réglage élevé pour une tâche nécessitant un raisonnement étape par étape. Comme la génération de code. Ou un réglage bas pour des traitements simples à haut débit, comme la classification de tickets support.

Mais l’intérêt du modèle Gemini 3.1 Flash Lite est avant tout économique. Moins le modèle sollicite ses capacités de raisonnement profond, moins il génère de tokens intermédiaires. Ce qui réduit mécaniquement la facture finale.

Pour des entreprises traitant des millions de requêtes quotidiennes, ce levier d’optimisation est stratégique.

Et avoir un contrôle granulaire pour les architectes Cloud

Cette fonctionnalité permettrait aux DSI de réduire le compromis classique entre la qualité de sortie et la maîtrise du budget.

Un pipeline de modération de contenu peut, par exemple, opérer en mode minimal pour les cas évidents. Et basculer sur un raisonnement plus approfondi uniquement pour les cas ambigus, sans avoir à changer de modèle d’infrastructure.

Des performances qui défient sa catégorie : analyse des benchmarks

Si l’appellation « Lite » suggère souvent une version bridée, les données techniques de Gemini 3.1 Flash-Lite contredisent cette idée.

Les tests réalisés tant par Google que par des organismes indépendants montrent que ce modèle d’efficience surpasse, sur plusieurs critères, les modèles intermédiaires de la génération précédente.

Une vitesse de génération record (330 tokens/seconde)

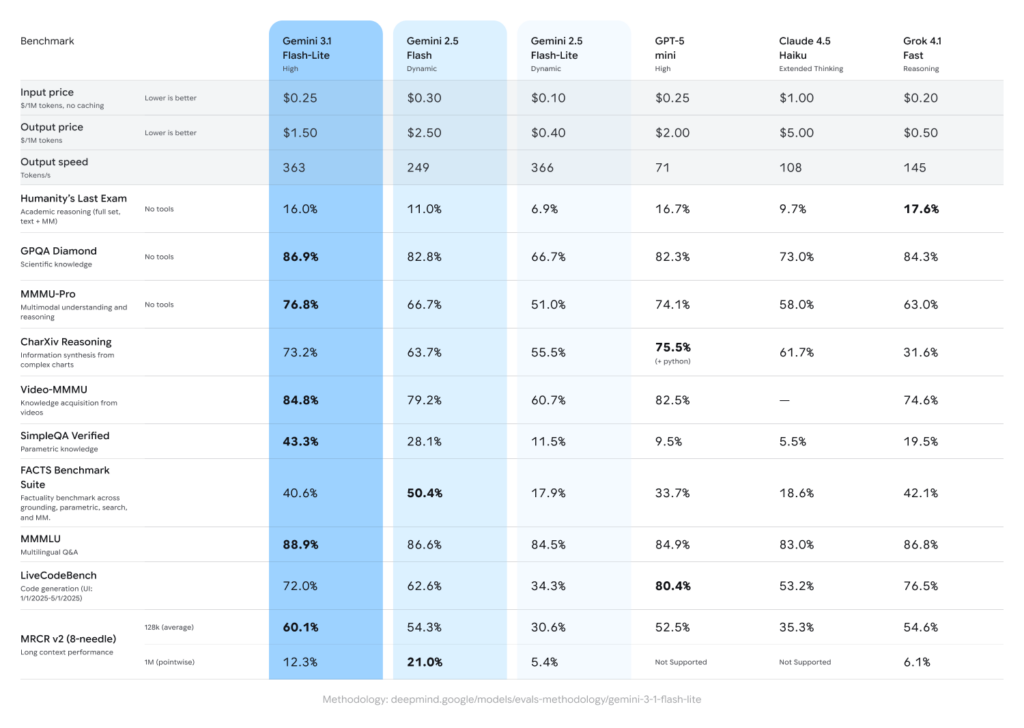

La réactivité est le premier critère de différenciation de ce modèle. Selon l’analyse détaillée d’Artificial Analysis, Gemini 3.1 Flash-Lite affiche une vitesse de sortie impressionnante de 330,1 tokens par seconde.

À titre de comparaison, ses concurrents directs sur le même segment affichent des performances nettement en retrait. GPT-5 mini plafonne à 72 tokens par seconde et Claude 4.5 Haiku à 57 tokens par seconde.

Le raisonnement scientifique (GPQA Diamond) : 86,9 %

Malgré sa légèreté, le modèle conserve une capacité de raisonnement robuste sur des sujets complexes.

Google a d’ailleurs publié des scores de benchmarks qui placent Flash-Lite en tête de sa catégorie :

- GPQA Diamond (Raisonnement scientifique de niveau doctoral) : le modèle atteint 86,9 %. Ce chiffre est particulièrement notable puisqu’il dépasse celui de Gemini 2.5 Flash.

- MMMU Pro (Vision et raisonnement visuel) : avec un score de 76,8 %, Flash-Lite démontre une compréhension fine des graphiques, des schémas techniques et des documents multimodaux.

Un million de tokens de contexte : l’atout maître

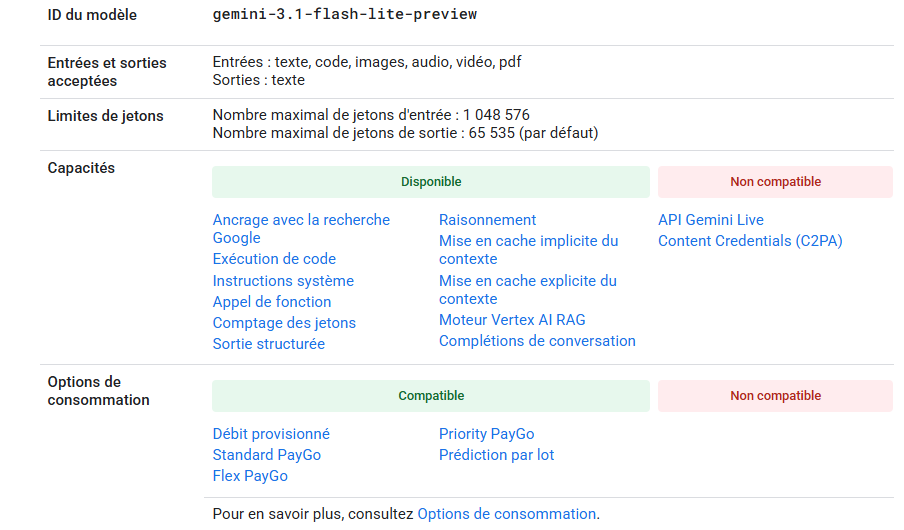

L’un des avantages concurrentiels majeurs de Gemini 3.1 Flash-Lite reste sa fenêtre contextuelle massive de 1 million de tokens, soit l’équivalent de 1 500 pages A4.

Alors que la plupart des modèles « mini » ou « haiku » de la concurrence se limitent à des fenêtres plus étroites, Flash-Lite permet d’analyser d’épais rapports techniques, des bases de code entières ou de longues vidéos en une seule requête.

Capacité multimodale : texte, image, son et vidéo

Le modèle est nativement multimodal. S’il ne génère que du texte en sortie, il accepte une grande variété de formats en entrée : texte, image, parole et vidéo.

Gemini 3.1 Flash Lite vs GPT-5 mini, qui est le moins cher ?

Le positionnement tarifaire de Gemini 3.1 Flash-Lite est sans doute son argument le plus agressif.

Comparatif des tarifs au million de tokens

Le modèle s’affiche à 0,25 $ par million de tokens en entrée et 1,50 $ par million en sortie.

Voici comment il se situe face à ses concurrents directs d’après les données d’Artificial Analysis :

- Gemini 3.1 Flash-Lite : 0,25 $(Entrée) / 1,50 $ (Sortie)

- GPT-5 mini : 0,15 $(Entrée) / 0,60 $ (Sortie)

- Claude 4.5 Haiku : 1,00 $(Entrée) / 5,00 $ (Sortie)

Le facteur « verbosité » : un point de vigilance

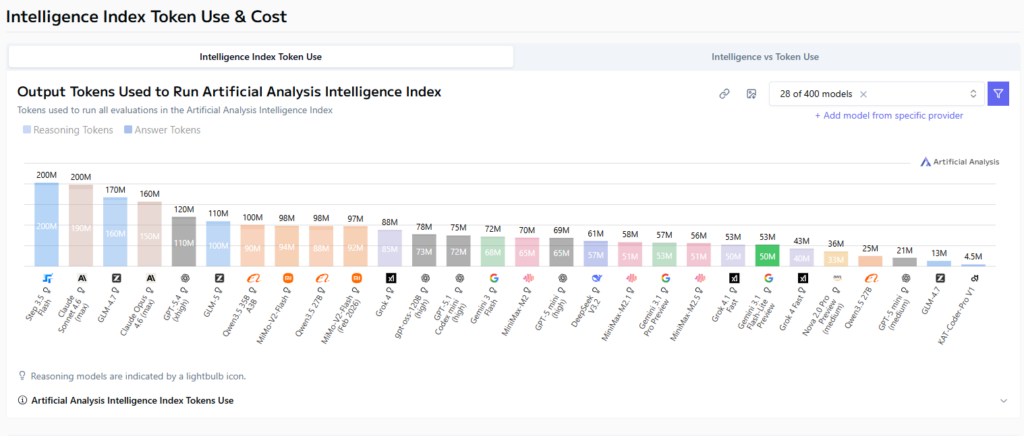

Lors des tests de l’Intelligence Index, Gemini 3.1 Flash-Lite s’est révélé « verbeux ». Il a généré 53 millions de tokens là où la moyenne des modèles de sa catégorie en utilise 20 millions pour les mêmes tâches.

Pour les entreprises, cela signifie que même si le prix unitaire du token est bas, le volume total de tokens générés peut influencer le coût final de l’opération.

L’optimisation des prompts devient alors essentielle pour exploiter pleinement la rentabilité du modèle.

Dans ce cas d’usage, quand privilégier Gemini 3.1 Flash Lite ?

Loin d’être un simple exercice technique, Gemini 3.1 Flash-Lite répond à des besoins industriels réels.

Sa conception privilégie la fluidité des processus métier là où l’intelligence des modèles « Pro » serait surdimensionnée et trop coûteuse.

Les secteurs déjà conquis : e-commerce, SaaS et jeux vidéo

Plusieurs entreprises pionnières utilisent déjà le modèle en accès anticipé pour transformer leurs services. Notamment :

- Latitude (Jeux vidéo) : le studio utilise Flash-Lite pour alimenter des systèmes de narration interactive sophistiqués, bénéficiant d’un coût d’inférence contenu malgré des volumes de requêtes élevés.

- Whering & Cartwheel : ces plateformes exploitent le modèle pour le traitement d’instructions composites et l’analyse de données complexes avec une précision proche des modèles de rang supérieur.

- E-commerce : Google a démontré la capacité du modèle à générer des catalogues entiers avec le remplissage automatique de centaines de références en quelques secondes, ou encore à créer des tableaux de bord dynamiques alimentés par des données météo en temps réel.

Un modèle taillé pour les agents à haute fréquence

Grâce à ses capacités agentiques (suivi d’instructions, utilisation d’outils via l’appel de fonctions), Flash-Lite excelle dans les workflows automatisés.

Je le recommandé particulièremenpour :

- La traduction massive : traitement de flux de chats, d’avis clients ou de tickets support en plusieurs langues.

- La modération de contenu : analyse ultra-rapide d’images et de textes pour filtrer les contenus inappropriés à grande échelle.

- Le routage intelligent : analyse de l’intention de l’utilisateur pour rediriger la requête vers le service ou le modèle (Pro/Flash) le plus adapté.

Gemini 3.1 Flash-Lite has landed.

— Google DeepMind (@GoogleDeepMind) March 3, 2026

It’s our most cost-efficient Gemini 3 series model yet, built for intelligence at scale. Here’s what’s new 🧵 pic.twitter.com/BzD2bdg3Dx

Mais il y a quelques points à prendre en compte avant de migrer vers Flash Lite de Gemini

Malgré ses performances, Gemini 3.1 Flash-Lite impose certaines contraintes qu’un architecte IA doit intégrer dans sa stratégie.

Sa base de connaissances est fixée à janvier 2025

Comme l’ensemble de la série 3.1 en preview, la date de coupure des connaissances (Knowledge Cutoff) de Flash-Lite est fixée au 1er janvier 2025 selon Artificial Analysis.

Pour toute information postérieure à cette date, l’utilisation de la fonction de « Grounding » (ancrage) avec Google Search est indispensable pour garantir la factualité des réponses.

Défis opérationnels et verbosité

Les premiers retours d’expérience soulignent deux points de vigilance. Dont les fluctuations de latence et la gestion du budget tokens.

En tant que version « Preview », des variations de temps de réponse ont été observées lors des pics d’utilisation de l’API.

Gestion du budget tokens : le modèle ayant tendance à être plus « bavard » que la moyenne, les développeurs doivent affiner leurs system instructions pour contraindre les sorties et éviter une dérive des coûts.

FAQ

Où peut-on accéder à Gemini 3.1 Flash-Lite ?

Le modèle n’est pas disponible dans l’application grand public Gemini (anciennement Bard). Pour l’utiliser, vous devez passer par l’API Gemini dans Google AI Studio ou via la plateforme Vertex AI pour les entreprises.

Quelle est la différence entre Gemini 3 Flash et 3.1 Flash-Lite ?

Gemini 3 Flash est le modèle équilibré par défaut, offrant une intelligence de niveau « Pro » à haute vitesse. Flash-Lite est une version encore plus allégée, optimisée spécifiquement pour réduire la latence et les coûts sur des volumes de requêtes industriels.

Le modèle est-il vraiment multimodal ?

Oui. Gemini 3.1 Flash-Lite accepte en entrée du texte, des images, de l’audio, de la vidéo et des fichiers PDF. En revanche, il ne génère que du texte en sortie.

Quelle est la taille maximale des documents que l’on peut lui envoyer ?

Grâce à sa fenêtre contextuelle d’un million de tokens, vous pouvez lui soumettre des documents allant jusqu’à 1 500 pages, des fichiers audio de plus de 8 heures ou des vidéos d’environ 45 minutes.

Gemini 3.1 Flash-Lite est-il plus performant que GPT-5 mini ?

En termes de rapidité, oui : avec 330 tokens/seconde, il surpasse nettement GPT-5 mini (72 tokens/s). Côté prix, si GPT-5 mini est légèrement moins cher au million de tokens, Flash-Lite offre une fenêtre contextuelle plus large (1M vs 400k) et de meilleurs scores sur certains tests de raisonnement comme GPQA Diamond (86,9%).

Comment limiter les coûts liés à sa « verbosité » ?

Le modèle ayant tendance à générer beaucoup de texte (53M de tokens lors des tests contre 20M en moyenne), il est conseillé d’utiliser des instructions système (System Instructions) strictes pour forcer le modèle à être concis, par exemple : « Réponds uniquement par un JSON » ou « Ne fais aucun commentaire ».

- Partager l'article :