La robotique est un domaine en constante évolution, mais elle se heurte encore à des limites. Les robots actuels manquent souvent d’adaptabilité, ce qui restreint leur champ d’application. Pour repousser ces limites, des scientifiques explorent une nouvelle voie : l’intégration des grands modèles de langage (LLM) dans la robotique.

Offrir aux robots une plus grande flexibilité face à tous les scénarios

Les chercheurs explorent de nouvelles pistes pour repousser les limites de la robotique. Par exemple, Ishika Singh, doctorante en informatique à l’Université de Californie du Sud, a pour projet de créer un robot capable d’agir de façon entièrement autonome. Ceci, en exploitant les grands modèles de langage tels que ChatGPT.

Par exemple, dans la restauration, les robots sont déjà capables de cuisiner des repas ou d’effectuer des tâches précises grâce à une programmation fixe. Ils répètent continuellement les mêmes étapes. Ce que cette chercheuse ambitionne est de créer un robot capable de préparer le dîner de A à Z en autonomie. Le robot devrait pouvoir tenir compte des préférences alimentaires de chacun et s’adapter à des requêtes spécifiques.

Selon Jesse Thomason, professeur en informatique à l’Université de Californie du Sud et directeur de thèse de Singh, un tel robot polyvalent est un objectif ambitieux. Cela révolutionnerait nos vies et simplifierait notre quotidien.

Combiner les LLM et la technologie robotique

D’autres experts envisagent aussi de combiner les grands modèles de langage et les robots. En effet, les LLM possèdent une connaissance impressionnante, mais ils ne peuvent interagir physiquement avec le monde réel. À l’inverse, les robots disposent de « mains et d’yeux » leur permettant d’agir sur leur environnement, mais ils manquent de l’intelligence des LLM.

Certains prototypes illustrent déjà ce mariage high-tech. Par exemple, l’entreprise Levantas a doté des robots-chiens de Boston Dynamics de la parole de ChatGPT. Ceux-ci peuvent répondre aux questions et suivre des consignes. Actuellement utilisés dans les industries, ils pourraient être utilisés dans les foyers à l’avenir.

Le projet SayCan de Google

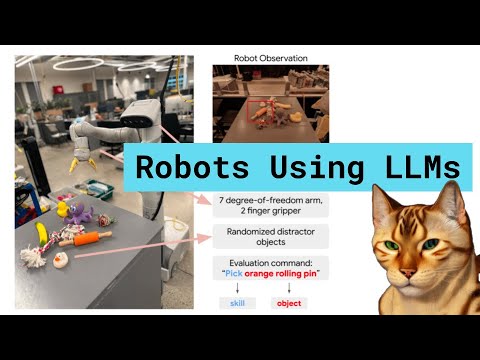

Chez Google, une équipe de chercheurs, dont Karol Hausman et Brian Ichter, expérimente une approche innovante pour transformer les capacités d’un LLM en actions concrètes d’un robot. Leur projet SayCan s’appuie sur le modèle PaLM auquel ils soumettent une liste d’actions potentielles. Le robot doit sélectionner l’action la plus adaptée pour répondre à une requête. Ainsi, lorsqu’un humain fait une requête, PaLM analyse la demande et pioche dans son répertoire les comportements les plus à même d’y répondre.

Par exemple, un utilisateur vient de faire du sport et demande au robot d’apporter une boisson et un en-cas pour bien récupérer. Le modèle juge dans un premier temps qu’une bouteille d’eau répond mieux au besoin qu’une pomme. La bouteille apportée, il considère ensuite qu’il faut maintenant chercher la pomme.

Le but ultime des chercheurs est d’atteindre un niveau de compréhension plus élevé. Par exemple, lorsqu’on lui demande une aide suite à une mauvaise nuit, il devrait savoir qu’il doit apporte du café.

Des défis à relever malgré les progrès

Le projet SayCan de Google est un véritable progrès. Néanmoins, des experts comme le psychologue Gary Marcus soulèvent des réserves quant à la fiabilité et la compréhension encore limitée des LLM comparativement aux programmes classiques.

Selon eux, le déploiement à grande échelle de ces modèles dans des applications grand public dont les robots pourrait présenter des risques. Ceci, à cause d’éventuelles incompréhensions des attentes des utilisateurs ou des requêtes mal interprétées. Pour relever ces défis, des approches hybrides mêlant capacités de simulation des LLM et planification classique doivent être envisagées.

- Partager l'article :