Face à l’omniprésence des caméras — on en dénombre 2 millions en France et 70 millions aux États-Unis — une industrie textile inédite voit le jour. Des marques comme Capable Design, Urban Privacy ou NeuThroné promettent de rendre leurs porteurs « invisibles » pour les algorithmes. Portée par un climat politique tendu, notamment outre-Atlantique, cette mode mêle ingénierie de pointe et militantisme pour la protection de la vie privée.

Le marché de la surveillance physique explose, mais la résistance s’organise désormais sur le terrain du prêt-à-porter.

L’objectif n’est plus seulement de s’habiller, mais de perturber la chaîne de vision des intelligences artificielles pour échapper à une reconnaissance systématique.

La science de l’invisibilité : le « bruit adverse »

Pour tromper les IA, les designers exploitent le concept scientifique de « bruit adverse » (adversarial noise).

Cette technique repose sur l’impression de motifs géométriques ou de taches de couleurs bariolées qui, bien que parfaitement visibles pour l’œil humain, saturent les algorithmes de détection.

Puisque la reconnaissance faciale doit d’abord détecter un visage humain avant de tenter de l’identifier, ces motifs « adversaires » viennent bloquer cette première étape.

Le résultat est saisissant : une IA confrontée à ces tissus ne voit plus un humain, mais peut identifier le porteur comme une girafe, un chien ou un simple artefact numérique sans intérêt.

Cette technologie s’étend également à la protection contre les deepfakes grâce à des accessoires comme les lunettes NeuThroné, qui introduisent des détails superflus cassant les modèles de diffusion et rendant impossible la génération de visages synthétiques à partir de photos volées.

Saturation et camouflage physique

Au-delà du bruit numérique pur, d’autres marques comme Urban Privacy misent sur des approches plus structurelles de saturation.

Certains t-shirts affichent ainsi des motifs interprétés directement comme des visages par les algorithmes. Ce qui forçe le système à détecter des dizaines de têtes sur un seul corps. Donc à de ralentir ou à paralyser totalement le traitement des données.

Parallèlement, pour contrer l’analyse de la démarche — une technique capable de déterminer l’âge ou le genre d’un piéton par ses mouvements — des vêtements d’une ampleur extrême viennent masquer les articulations comme les genoux et les coudes pour créer une asymétrie corporelle indéchiffrable.

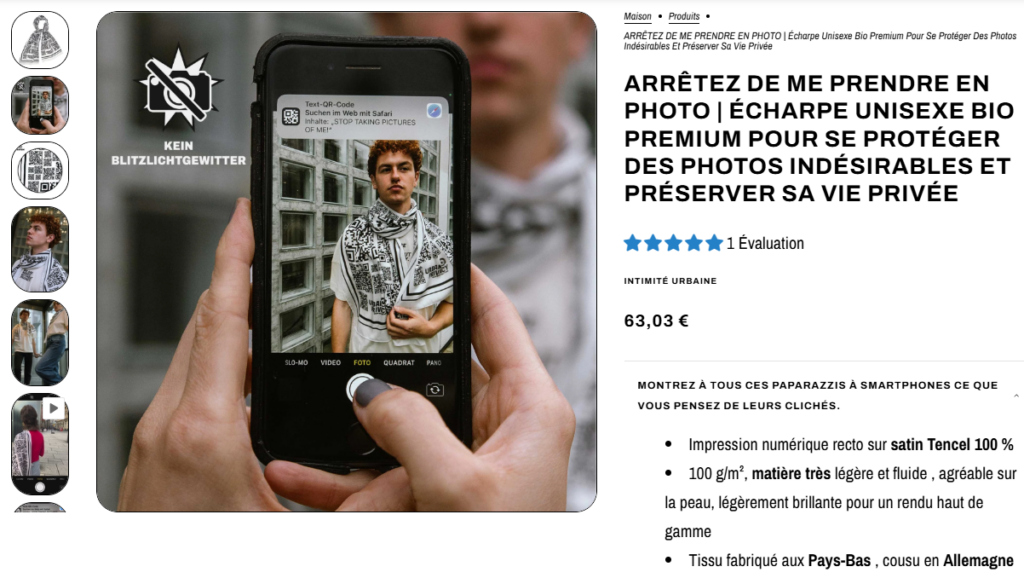

Cette panoplie est complétée par des accessoires techniques tels que des poches anti-pistage bloquant les signaux mobiles. OU encore des foulards réfléchissants conçus pour rendre les photos prises avec flash totalement illisibles.

La nouvelle mode qui promet d'échapper aux caméras 🎥 de sécurité

— fabienne billat (@fadouce) February 18, 2026

Les vêtements anti-IA !

Des arguments qui séduisent depuis le retour de Donald Trump au pouvoir. https://t.co/ghElaEd0hp pic.twitter.com/EiLKk2VaFl

Un boom porté par le contexte géopolitique

L’intérêt pour ces produits a connu une croissance exponentielle depuis le début du second mandat de Donald Trump.

De leur côté, les vendeurs ont rapporté une hausse massive des commandes provenant majoritairement des États-Unis.

À Minneapolis, épicentre de la contestation contre la police aux frontières (ICE), les manifestants utilisent ces outils pour se protéger de l’application Mobile Fortify. Ce dernier étant capable de scanner 100 000 visages en un temps record pour identifier des individus.

Pour ces créateurs, ces vêtements représentent l’équivalent physique du bouton « refuser les cookies » sur Internet. Et ils offrent une rare zone de résistance dans un espace public de plus en plus surveillé.

Une efficacité encore relative

Malgré cet enthousiasme, l’efficacité réelle de ces boucliers textiles demeure un sujet de débat intense parmi les experts en biométrie.

Si ces vêtements anti-IA parviennent à perturber les modèles en open source comme YOLO, ils montrent leurs limites face à des systèmes propriétaires plus robustes et secrets tels que Sora ou VEO.

Aussi, des tests menés par la Fondation Mozilla et Google révèlent que les IA modernes apprennent désormais à reconnaître un humain par sa simple posture. Ainsi, le camouflage du visage devient parfois insuffisant.

En conditions réelles, les variations de luminosité et d’angle de vue limitent également l’impact du bruit adverse. Ce qui pousse les marques elles-mêmes à parler de « perturbation » ou de « ralentissement » plutôt que d’une véritable cape d’invisibilité infaillible.

- Partager l'article :