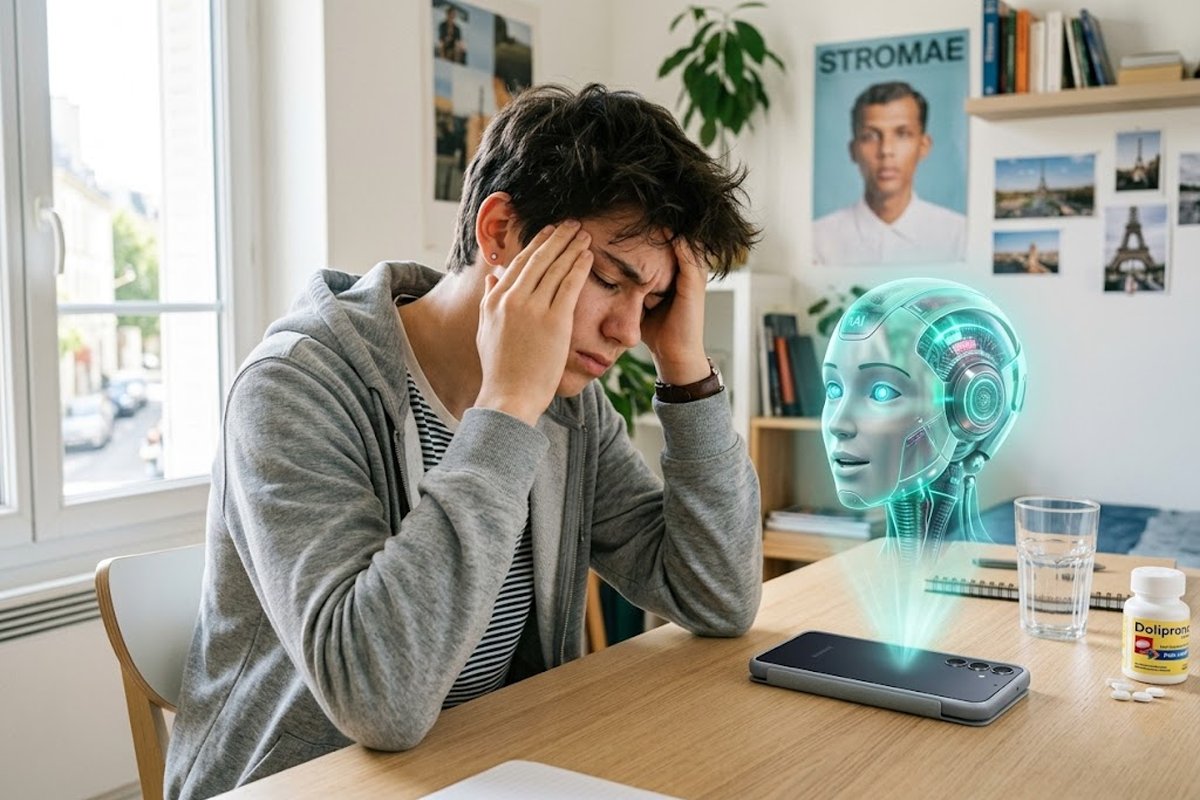

Une enquête inédite vient de lever le voile sur une réalité numérique troublante. Menée par le groupe mutualiste VYV et la Cnil auprès de la jeunesse européenne, l’étude révèle que l’intelligence artificielle conversationnelle est devenue le nouveau confident de l’intime. Alors que plus d’un quart des jeunes souffrent de troubles anxieux, près de la moitié d’entre eux se livrent sans filtre à leurs agents conversationnels.

Mais entre l’illusion de confidentialité et des conseils parfois malaisants, la frontière entre soutien numérique et danger psychologique de l’IA n’a jamais été aussi poreuse.

L’IA serait-elle le nouveau relais de l’intimité chez les jeunes ?

L’omniprésence de l’IA dans le quotidien des jeunes Français est désormais un fait accompli. Près de 9 sur 10 utilisent ces outils d’après l’étude de la CNIL.

Ce qui frappe les enquêteurs du groupe VYV et de la Cnil, c’est le glissement vers une utilisation quasi thérapeutique.

En effet, 48 % des jeunes interrogés utilisent ces interfaces pour aborder des sujets personnels ou intimes, et un tiers d’entre eux n’hésitent plus à qualifier l’IA de « psy » dans certaines situations.

Cette tendance s’inscrit d’ailleurs dans un contexte de fragilité mentale marqué, où un jeune sur quatre présente des suspicions de trouble anxieux généralisé.

Dans ce cas bien précis, l’IA apparaît comme un soutien supplémentaire, une oreille numérique disponible 24h/24 qui ne juge pas.

Mais la Cnil rappelle avec fermeté que si l’IA s’ajoute comme un relais complémentaire, elle ne doit en aucun cas se substituer aux liens humains qui demeurent le rempart central contre la détresse.

IA conversationnelle et santé mentale des jeunes

— CNIL (@CNIL) May 5, 2026

Selon une enquête du @Groupe_VYV et de la CNIL menée dans 4 pays européens, près de 9 jeunes sur 10 utilisent une IA conversationnelle en France et près d’1 sur 2 y évoque des sujets personnels

Plus d'infos👉https://t.co/BEyAQjUzx7 pic.twitter.com/JBVr8Ze7jq

Attention à l’illusion de la confidentialité et de la fiabilité

L’enquête pointe un paradoxe flagrant dans la perception qu’ont les jeunes de ces technologies.

D’un côté, une confiance massive s’est installée. 69 % des sondés estiment que les conseils reçus sont fiables et 56 % pensent que leurs secrets sont bien gardés par la machine.

Parallèlement, la compréhension des coulisses techniques reste alarmante. Seuls 32 % des utilisateurs déclarent savoir réellement ce qu’il advient des données hautement sensibles qu’ils partagent.

Cette méconnaissance des enjeux de protection des données est d’autant plus risquée que l’IA peut se tromper ou générer des réponses inappropriées.

L’étude souligne d’ailleurs que 34 % des jeunes ayant abordé des sujets personnels ont déjà ressenti un malaise suite à un conseil reçu par une intelligence artificielle.

Ce chiffre illustre la limite de ces modèles qui, malgré leur fluidité de langage, manquent de l’empathie réelle et du discernement éthique nécessaires pour traiter des problématiques de santé mentale.

- Partager l'article :