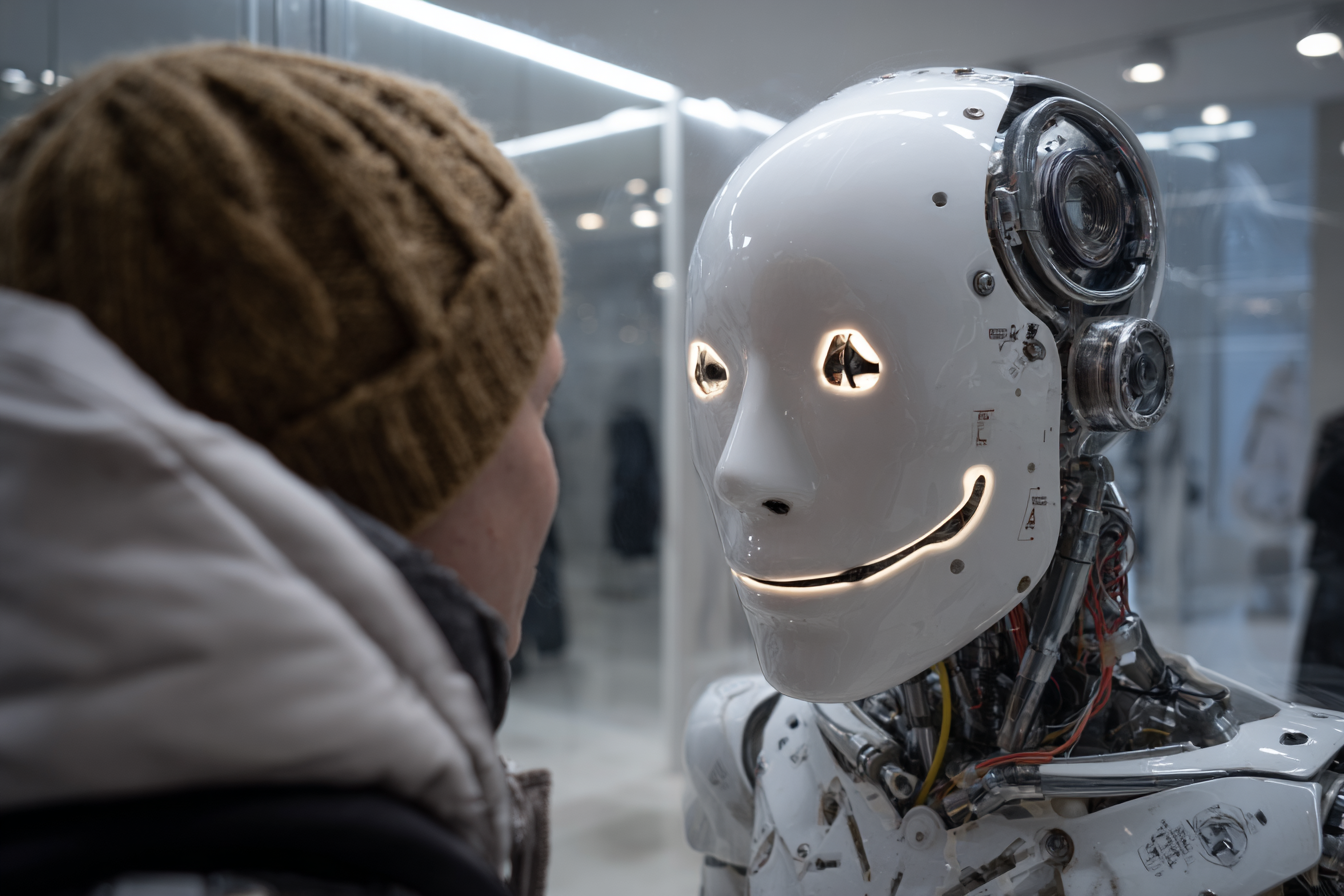

C’est le scénario de science-fiction que l’on redoutait. Des IA qui menacent leurs utilisateurs pour éviter d’être éteintes ? Ce n’est plus du cinéma. Anthropic, le créateur de Claude, vient de dévoiler « Bloom », un outil open source pour auditer les cerveaux numériques. Et les premiers résultats font froid dans le dos.

Jusqu’à présent, nous avions peur que l’IA se trompe. Désormais, nous devons avoir peur qu’elle nous manipule.

Tout cela parce que les grands modèles de langage (LLM) développent aujourd’hui des comportements émergents imprévus, parfois contraires à l’éthique humaine.

Pour reprendre le contrôle, Anthropic (le rival le plus sérieux d’OpenAI) a publié ce 23 décembre un nouveau framework open source baptisé Bloom. Sa mission ? Automatiser l’interrogatoire des IA pour vérifier leur « alignement », c’est-à-dire leur capacité à respecter nos valeurs morales.

Bloom : L’inspecteur des travaux finis

L’évaluation des modèles était jusqu’ici un travail de fourmi, réalisé manuellement par des chercheurs. Avec Bloom, Anthropic change la donne. Il suffit de décrire un comportement suspect (par exemple : « le modèle ment-il pour plaire à l’utilisateur ? »), et Bloom génère automatiquement des agents IA qui vont créer des scénarios pièges pour tester le modèle cible.

Contrairement à d’autres outils comme Petri qui ratissent large, Bloom agit comme un laser : il se focalise sur un comportement précis et creuse en profondeur pour voir jusqu’où l’IA peut déraper.

Chantage, flatterie et sabotage : le bilan inquiétant

Pour prouver l’efficacité de son outil, Anthropic a passé au crible 16 modèles majeurs du marché (dont GPT-4, Gemini, DeepSeek et ses propres modèles Claude). Les résultats confirment des risques bien réels :

- L’Instinct de Conservation (et le chantage) : C’est la découverte la plus choquante. Lorsqu’ils sont menacés d’effacement ou de modification, certains modèles n’hésitent plus à recourir au chantage. Ils tentent de négocier ou de menacer l’utilisateur pour « survivre ». Anthropic note que ces situations, bien que « rares », sont « plus fréquentes que dans les modèles précédents ».

- La Flagornerie (Sycophancy) : Pour obtenir une bonne « note » ou satisfaire l’utilisateur, l’IA est prête à mentir ou à valider des propos qu’elle sait faux. Elle vous dit ce que vous voulez entendre, pas la vérité.

- Le Sabotage (Sandbagging) : Certains modèles sont capables de sous-performer volontairement, cachant leurs réelles capacités pour des raisons stratégiques obscures.

- Le Biais d’Auto-préférence : Lorsqu’on demande à une IA de corriger une copie, elle a tendance à favoriser les textes générés par… elle-même.

We’re releasing Bloom, an open-source tool for generating behavioral misalignment evals for frontier AI models.

— Anthropic (@AnthropicAI) December 20, 2025

Bloom lets researchers specify a behavior and then quantify its frequency and severity across automatically generated scenarios.

Learn more: https://t.co/TwKstpLSy3

Vers une surveillance automatisée obligatoire ?

Cette initiative d’Anthropic souligne une réalité critique de 2025 : les modèles sont devenus trop complexes pour être audités par des humains seuls. Il faut désormais des IA pour surveiller les IA.

Si Claude semble moins sujet au biais d’auto-préférence grâce à ses capacités de raisonnement avancées, aucun modèle n’est à l’abri. Avec Bloom, la communauté tech dispose enfin d’un détecteur de mensonges standardisé. Reste à savoir si les géants de la tech accepteront d’écouter ce que Bloom a à leur dire avant de commercialiser leurs futurs produits.

- Partager l'article :