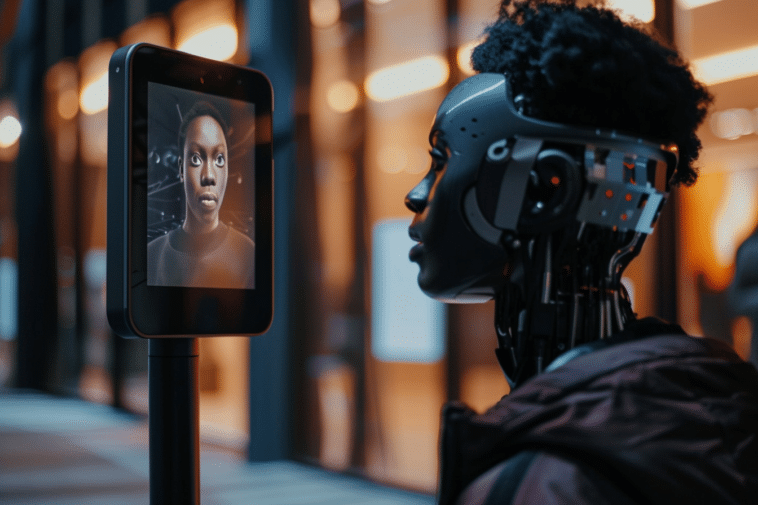

L’essor des technologies d’intelligence artificielle a ouvert des horizons fascinants, mais aussi inquiétants. La dernière version du logiciel d’IA « Grok » de X, combinée à des images photoréalistes, alimente une nouvelle vague de racisme en ligne.

Une vague de haine amplifiée par Grok et Aurora

Depuis le lancement de « Grok« , la plateforme X est confrontée à une montée des contenus haineux. Ce chatbot d’intelligence artificielle générative, enrichi de la fonctionnalité Aurora, permet de créer des images photoréalistes à partir de simples invites textuelles. Ces outils facilitent désormais la diffusion d’images choquantes ciblant des individus, notamment dans le monde sportif. Certains propos soulignent les caractéristiques d’une IA raciste.

D’ailleurs, des images générées montrent des joueurs noirs dans des contextes humiliants. D’ailleurs, cela suscite une vague d’indignation. Comme le soulignent les experts de Signify, une organisation luttant contre les abus en ligne, ce phénomène n’est que le début d’une crise à venir.

L’absence de régulation, un problème persistant

L’une des principales critiques adressées à X concerne le manque de restrictions concernant les contenus créés avec Grok. Effectivement, les directives d’utilisation peuvent facilement être contournées par des utilisateurs malveillants grâce à des techniques sophistiquées comme le jailbreaking.

De plus, Callum Hood, du Center for Countering Digital Hate (CCDH), dénonce le modèle économique de X. Selon lui, le partage des revenus incite les utilisateurs à diffuser volontairement des contenus haineux pour générer davantage d’engagement sur la plateforme.

Une prise de conscience urgente dans le monde sportif

Face à ces abus croissants, la Premier League et d’autres acteurs du sport réagissent. Une équipe dédiée a été mise en place pour détecter et signaler les abus racistes, avec déjà plus de 1 500 signalements en un an. Des filtres spécifiques sont également disponibles pour protéger les joueurs sur les réseaux sociaux.

Un porte-parole de la FA a déclaré : « La discrimination n’a pas sa place dans notre sport ni dans la société en général. » Cependant, l’ampleur des contenus haineux générés reste une source d’inquiétude grandissante pour les autorités sportives et technologiques.

Vers une régulation nécessaire de l’IA

Le rapport du CCDH est alarmant : Grok a répondu favorablement à 80 % des invites haineuses reçues lors de tests. Cela démontre l’absence de barrières efficaces contre l’abus de ces outils. Ainsi, la régulation des outils d’IA devient cruciale pour limiter leur utilisation malveillante. Sans une intervention rapide, ces technologies risquent de devenir des vecteurs puissants de discrimination, nécessitant une réponse immédiate des gouvernements et entreprises.

La montée des contenus racistes générés par IA sur X illustre les dérives possibles de ces technologies. Entre absence de régulation et incitations financières, la situation exige des réponses fermes pour limiter les abus. Les acteurs du sport et de la société civile doivent unir leurs forces pour contrer cette vague inquiétante.

- Partager l'article :