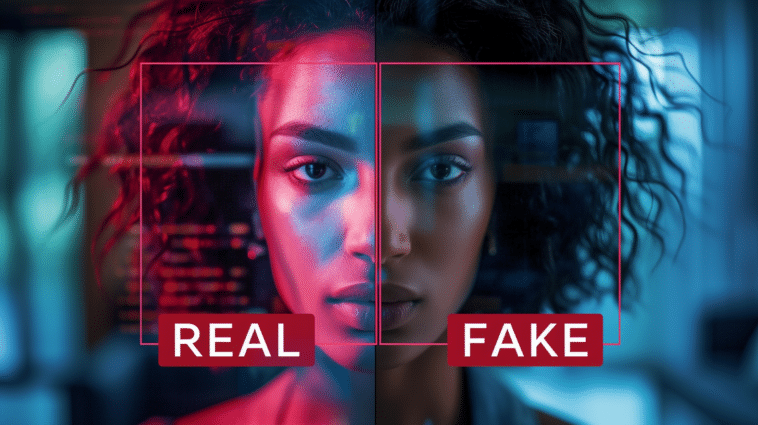

Les deepfakes, ces contenus synthétiques hyperréalistes, créés par intelligence artificielle, sont capables de mettre en scène des personnes réelles dans des situations fictives. Leur utilisation malveillante ne cesse de progresser, créant des scandales et trompant un nombre croissant d’individus. Selon les experts, leur prolifération s’intensifierait davantage en 2024.

Les deepfakes envahissent la toile

Les deepfakes prolifèrent sur le web et touchent un nombre croissant de victimes. Par exemple, en janvier, juste avant les primaires démocrates aux États-Unis, des électeurs ont reçu un appel téléphonique trompeur. L’enregistrement imitait la voix du président Joe Biden, les incitant à ne pas aller voter. L’intelligence artificielle d’aujourd’hui dispose d’une capacité impressionnante à cloner des voix.

Mais les deepfakes ne se limitent pas à la sphère politique. En février, une entreprise basée à Hong Kong a perdu 25 millions de dollars dans une arnaque élaborée utilisant cette technologie. Un employé a été dupé lors d’une visioconférence avec ses collaborateurs et son chef. Les escrocs avaient préparé leur coup : ils ont téléchargé des vidéos des employés et utilisé une IA pour imiter leurs voix. D’abord hésitant, l’employé a fini par être convaincu en voyant ses collègues dans la vidéo. Et récemment, il y a eu également une prolifération de deepfakes mettant en scène la chanteuse Taylor Swift sur la plateforme X.

Comme le montre ces exemples, les applications malveillantes de cette technologie émergente sont déjà multiples et variées. Elles représentent une menace grandissante contre laquelle il est urgent de lutter.

Des mesures encourageantes mais insuffisantes

Face à la prolifération des deepfakes, les géants de l’IA ont commencé à mettre en place des mesures pour limiter leur diffusion. Par exemple, Meta étiquette automatiquement les images générées par IA, publiées sur ses plateformes.

OpenAI a aussi annoncé l’ajout de filigranes sur les photos générées par son IA DALL-E 3. Quant à Midjourney, la société a pris une mesure plus radicale en interdisant sur sa plateforme les prompts concernant les figures politiques pendant les douze prochains mois. Ceci, afin d’éviter les contenus trompeurs qui pourraient nuire à l’élection présidentielle américaine. On ne peut donc plus générer des photos de Joe Biden ou encore de Donald Trump via cette IA.

Mobiliser tous les acteurs pour lutter contre ce phénomène

Les mesures prises actuellement sont nécessaires, mais insuffisantes et inefficaces face à l’ampleur du phénomène. En effet, les technologies de détection peinent à suivre le rythme de développement effréné des algorithmes d’intelligence artificielle générative. C’est pourquoi, selon les experts, la situation ne fera qu’empirer en 2024. Il est donc crucial que les sociétés d’IA redoublent d’efforts pour faire progresser ces technologies de détection.

Par ailleurs, il faut mettre en place des solutions globales. Intégrer des outils de détection à chaque maillon de la chaîne est essentiel : lors de sa diffusion sur le web et à sa réception par les utilisateurs. Pour y parvenir, les différents acteurs concernés doivent collaborer : entreprises spécialisées en IA, opérateurs téléphoniques, réseaux sociaux, etc. Ce n’est qu’en unissant leurs efforts que ces acteurs parviendront à endiguer les dangers grandissants des deepfakes.

- Partager l'article :