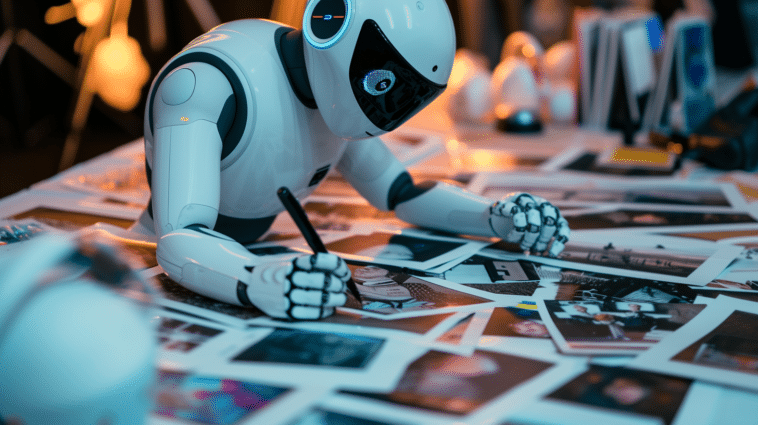

Face à la prolifération des deepfakes, les entreprises d’intelligence artificielle se mobilisent pour contrer ce phénomène. Après l’annonce des mesures prises par Meta dans ce sens, OpenAI emboite le pas en dévoilant une initiative similaire. L’entreprise californienne a décidé de mettre en place un système de marquage sur les images générées par son outil DALL-E 3. Ceci permet aux internautes de distinguer les vraies photos des visuels créés par l’IA.

Une marque visible pour lutter contre la désinformation

Les avancées de l’intelligence artificielle ont donné lieu à l’émergence des deepfakes. D’un réalisme saisissant, ces derniers peuvent toutefois tromper aisément les internautes. Des individus malintentionnés exploitent cette technologie à des fins de diffusion de fausses informations et de manipulation visuelle.

Conscients de ces menaces, surtout face aux rendez-vous électoraux aux États-Unis, les géants de l’intelligence artificielle prennent des mesures préventives. Meta a mis en place un système d’étiquetage automatique pour les images générées par l’IA. Et OpenAI suit cette tendance en apposant un filigrane « CR » sur toutes les images produites par DALL-E 3. Placé dans le coin supérieur gauche, ce marquage permet d’identifier instantanément des contenus générés par l’intelligence artificielle d’OpenAI, que ce soit via ChatGPT sur le Web que via l’API.

Ajout de métadonnées aux images pour se conformer à la norme C2PA

En complément du filigrane, OpenAI intègre aussi la norme C2PA (The Coalition for Content Provenance and Authenticity) aux images générées par son IA. Cette norme technique assure la traçabilité des contenus grâce à l’ajout des métadonnées. Elle ne se limite pas uniquement au domaine de l’IA. Divers organismes de presse et fabricants d’appareils photos aussi utilise cette norme.

Les utilisateurs pourront vérifier la provenance des images en consultant ces métadonnées via des plateformes dédiées comme Content Credentials. Même si ces mesures ne permettent pas d’éradiquer totalement les deepfakes, elles contribuent à les limiter. En fait, ces marquages peuvent être manipulés, voire supprimés.

OpenAI assure que l’ajout de filigrane et l’intégration de la C2PA n’affectent pas la qualité des images générées par DALL-E 3. Et, il faut noter que ces mesures ne s’appliquent pas encore aux vidéos et audios générées par des outils IA.

- Partager l'article :