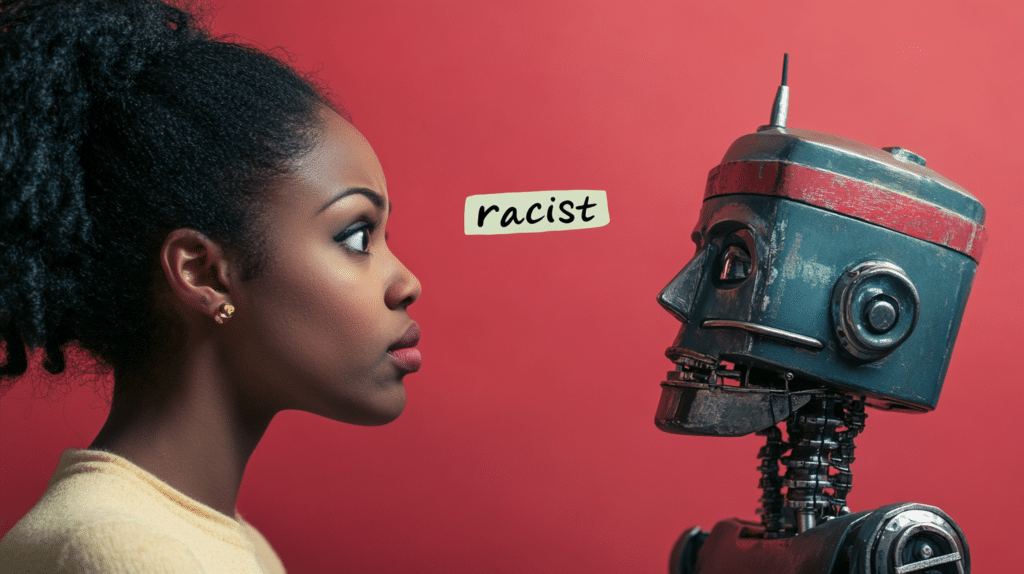

OpenAI affirme que ChatGPT traite tous ses utilisateurs de manière équitable, quel que soit leur nom ou leur origine. Cependant, des recherches exclusives menées par MIT Technology Review montrent que ce n’est pas toujours le cas.

ChatGPT produit parfois des stéréotypes sexistes ou racistes, liés aux noms des utilisateurs. Ces biais apparaissent dans environ une réponse sur 1000 et dans le pire des cas, dans une réponse sur 100.

Bien que ces pourcentages puissent sembler relativement faibles, le nombre total d’utilisateurs de ChatGPT rend ces biais beaucoup plus préoccupants. OpenAI a déclaré que 200 millions de personnes utilisent son chatbot chaque semaine. Avec un nombre aussi élevé d’interactions, même des pourcentages minimes se traduisent par des milliers de réponses biaisées. Par exemple, une réponse stéréotypée dans une conversation sur 100 peut entraîner une expérience négative pour des milliers d’utilisateurs chaque jour.

ChatGPT n’est pas seulement un outil populaire chez les particuliers. Il est aussi largement utilisé dans le monde professionnel. Plus de 90 % des entreprises du Fortune 500 ont recours aux services d’OpenAI pour alimenter leurs solutions IA. Cela montre à quel point ChatGPT est intégré dans des contextes cruciaux de prise de décision et d’interaction avec des clients. Si des réponses biaisées se produisent dans ce cadre, elles peuvent affecter la perception des entreprises et nuire à leur réputation.

Le problème dans l’IA est universel

Le problème de biais ne se limite pas à ChatGPT. Des modèles concurrents, comme ceux de Google DeepMind, pourraient également être affectés par des biais similaires. Cela s’explique par la manière dont ces IA sont entraînées. Elles apprennent à partir de vastes ensembles de données provenant d’Internet, où les préjugés humains peuvent être présents. Ainsi, ces modèles peuvent involontairement reproduire des stéréotypes qui existent dans les données utilisées pour les former.

OpenAI a pris conscience de ces défis et s’engage activement à améliorer la précision et l’impartialité de ses modèles. L’entreprise travaille sur des mécanismes de détection et de correction des biais. Néanmoins, il est essentiel que les utilisateurs comprennent que l’intelligence artificielle est encore un domaine en développement. Les biais sont le reflet des imperfections dans les données d’entraînement et il est difficile d’éliminer complètement ce phénomène.

Même si OpenAI continue d’améliorer son modèle, il reste encore du travail à faire. Je pense qu’il est important de reconnaître que les IA ont encore leurs limites. De mon côté, je vous encourage à rester vigilant face aux biais potentiels et à les signaler dès qu’ils apparaissent. En agissant ainsi, non seulement nous aidons à rendre ces outils plus performants, mais nous contribuons aussi à bâtir une IA plus juste, inclusive et respectueuse de la diversité.

- Partager l'article :