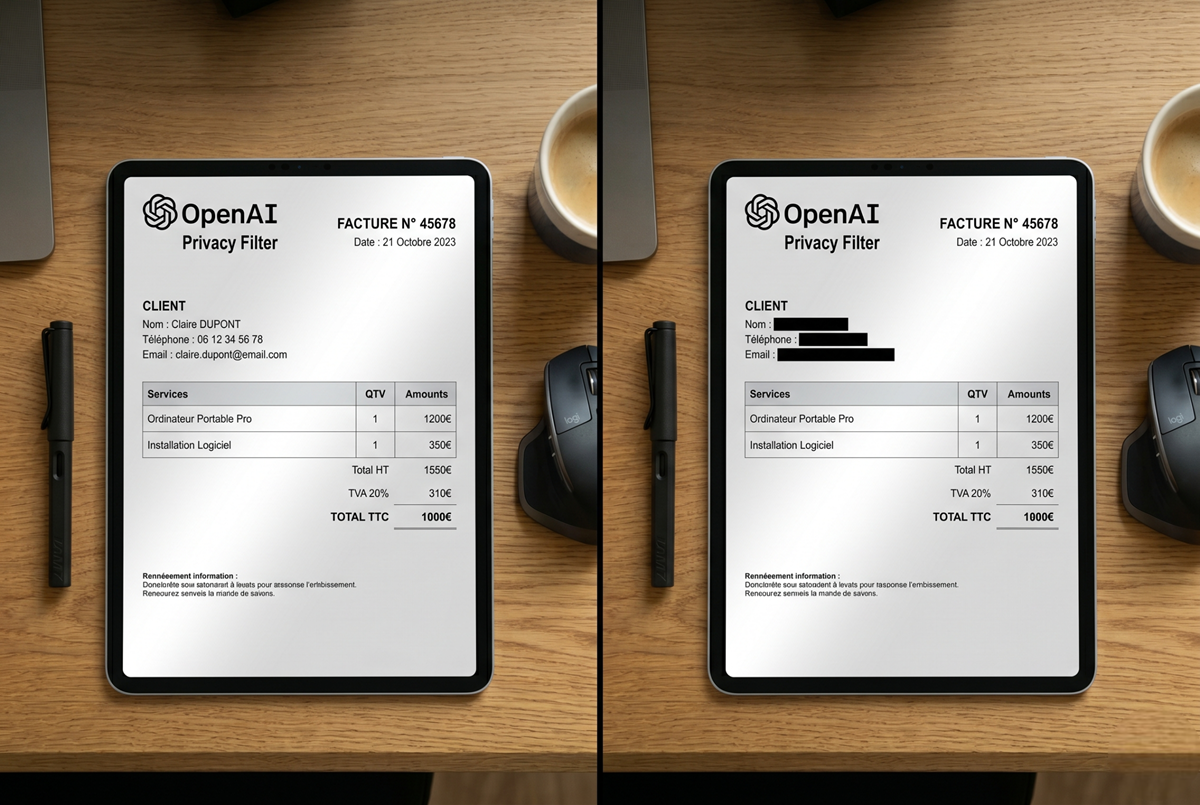

OpenAI libère un modèle open source capable de désinfecter les données sensibles en local avant tout envoi sur le cloud.

OpenAI a mis en ligne Privacy Filter, un modèle ultra-léger dédié à la détection et à la suppression des informations personnellement identifiables (PII). Ce lancement marque le retour en force d’OpenAI vers l’open source avec une ambition claire : imposer un standard de sécurité, véritable « SSL du texte », au sein de l’industrie.

Le retour au Open de OpenAI

Après une longue période de fermeture logicielle centrée sur ses modèles propriétaires, OpenAI change son fusil d’épaule. Privacy Filter est publié sous licence Apache 2.0 sur Hugging Face, offrant une liberté totale aux entreprises. Ce mouvement local-first permet de traiter les données à la source, sur un simple PC ou dans un navigateur, sans jamais exposer les fichiers bruts aux serveurs distants.

Le modèle s’appuie sur la famille gpt-oss, une lignée de modèles à raisonnement ouverts lancée plus tôt cette année. En proposant cet outil gratuitement, OpenAI ne cherche pas la rentabilité immédiate, mais l’intégration de sa technologie comme brique de base dans chaque pipeline IA. L’objectif est limpide : sécuriser la chaîne de traitement avant que les données n’atteignent des géants comme le modèle GPT-5, entre autres.

Une architecture bidirectionnelle

Techniquement, Privacy Filter pèse 1,5 milliard de paramètres, mais fonctionne avec une agilité déconcertante. Grâce à la structure Sparse Mixture-of-Experts (MoE), seulement 50 millions de paramètres sont sollicités lors d’une tâche. Cela permet au modèle de passer au crible des flux de données massifs avec une consommation électrique dérisoire, idéal pour une intégration directe via transformers.js et WebGPU.

Contrairement aux LLM classiques qui devinent le mot suivant, ce filtre est un classificateur de jetons bidirectionnel. Il analyse le contexte de gauche à droite et de droite à gauche. Cette vision périphérique lui permet de comprendre, par exemple, qu’une suite de chiffres dans un mail correspond à un compte bancaire et non à une référence produit. Ce qui évite ainsi les faux positifs qui rendraient le texte illisible.

Un nettoyage en trois étapes

Pour une entreprise, Privacy Filter devient la première sentinelle du flux de travail. Le processus se décompose en trois temps :

- Captation : réception des données brutes (mails, logs, dossiers médicaux).

- Sanitisation : le filtre anonymise localement les noms, adresses, clés API et secrets.

- Inférence : Le texte propre est envoyé vers un modèle de raisonnement puissant en toute conformité.

Le modèle gère huit catégories de données, incluant les identifiants numériques et les secrets de programmation. Grâce à une fenêtre de contexte de 128 000 tokens, il peut traiter un contrat de cent pages en un seul bloc. Cela garantit qu’un nom cité en page 1 et rappelé en page 50 soit identifié comme la même entité à caviarder.

https://t.co/6nXMYFjqHR

— Adam.GPT (@TheRealAdamG) April 22, 2026

"Today we’re releasing OpenAI Privacy Filter, an open-weight model for detecting and redacting personally identifiable information (PII) in text. This release is part of our broader effort to support a more resilient software ecosystem by providing…

Un outil puissant, mais pas infaillible

La communauté tech a réagi avec enthousiasme, notamment Elie Bakouch de Prime Intellect, qui souligne l’efficacité du filtrage à l’échelle du trillion de données. Cependant, OpenAI joue la carte de la transparence totale sur les limites de l’outil. Le modèle est présenté comme une « aide à la rédaction » et non comme un bouclier infaillible.

Dans sa documentation, l’entreprise avertit contre une confiance aveugle, citant des risques de spans manqués (des segments oubliés). Pour des secteurs ultra-sensibles comme la santé ou la défense, le risque d’erreur de détection subsiste. Privacy Filter réduit drastiquement la surface d’attaque. Cependant, OpenAI rappelle qu’en matière de cybersécurité, le risque zéro n’existe pas, même avec le meilleur shredder du marché.

- Partager l'article :