Arrêtez de perdre votre temps à copier-coller des fichiers JSON complexes pour expliquer vos besoins à une intelligence artificielle. L’outil n8n MCP change la donne en connectant directement vos LLM comme Claude, ChatGPT ou Cursor à votre instance n8n.

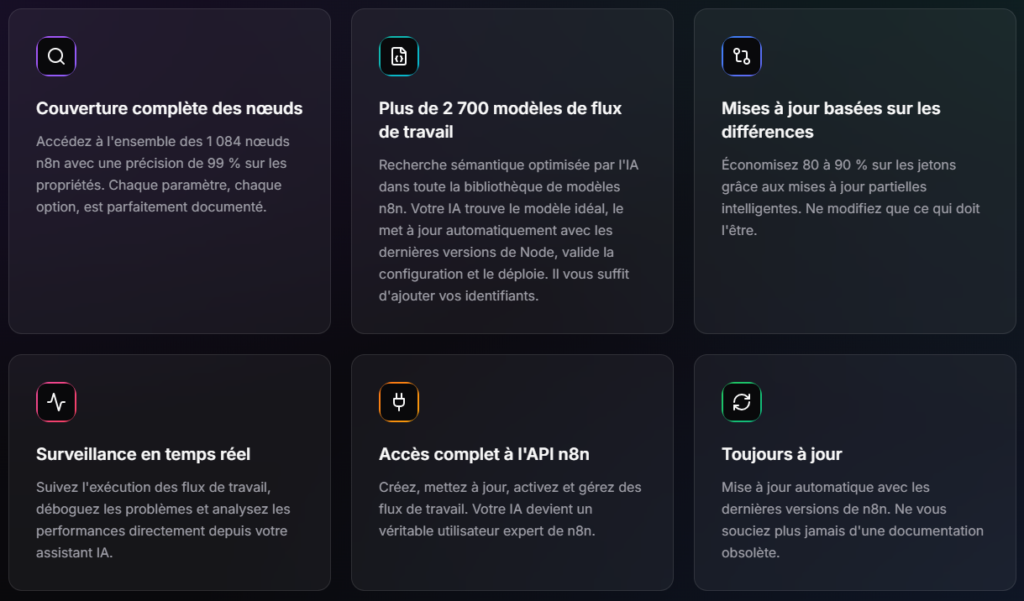

Ce serveur open source sous licence MIT permet à votre IA de manipuler plus de 1 000 nœuds technologiques. Notamment Gmail, Slack ou PostgreSQL, pour construire vos workflows à votre place, simplement en discutant avec elle.

Une efficacité redoutable pour votre consommation de tokens

Contrairement aux méthodes archaïques qui renvoient l’intégralité du workflow à chaque petite modification, ce système utilise des mises à jour différentielles intelligentes.

En ne transmettant que les changements effectués au lieu du fichier complet, vous réalisez une économie massive située entre 80% et 90% de tokens sur les modifications importantes selon le site officiel de l’outil.

Cette architecture permet à votre IA de garder une vision claire de la structure globale sans saturer sa fenêtre de contexte.

Une configuration simplifiée pour tous vos environnements de travail

Si vous recherchez l’instantanéité, le service hébergé propose un accès OAuth sans configuration complexe. Ce qui est idéal pour une prise en main immédiate avec une limite généreuse de 100 appels par jour.

Pour les utilisateurs plus avancés ou soucieux de leur souveraineté numérique, le déploiement en self-hosted s’effectue simplement via la commande npx n8n-mcp nécessitant Node.js 18+. Ou via une image Docker légère d’environ 280 Mo basée sur Alpine.

Une fois en place, l’outil s’intègre nativement à Claude Desktop, Gemini CLI ou encore VS Code.

Ainsi, vous pouvez puiser dans une bibliothèque colossale de plus de 2 700 templates via une recherche sémantique naturelle.

Une sécurité renforcée par une logique de déploiement prudente

Bien que l’IA puisse désormais manipuler des propriétés et des opérations complexes avec une agilité déconcertante, je vous recommande de ne jamais la laisser modifier directement vos workflows de production.

La stratégie gagnante consiste à laisser l’IA générer et modifier vos automatisations dans un environnement de développement dédié. Mais aussi de procéder à des tests de validation, puis d’effectuer un export sécurisé vers vos systèmes critiques.

New blog: We broke down 20 MCP servers worth knowing and showed how to orchestrate them with n8n, turning temporary chat sessions into persistent, trigger-based workflows you can rely on. https://t.co/b6lfPHAnEV

— n8n.io (@n8n_io) March 4, 2026

Cette approche vous protège contre les initiatives malheureuses d’une IA qui déciderait d’optimiser votre pipeline de facturation en supprimant des étapes qu’elle jugerait superflues.

Au fial, quand vous adoptez n8n MCP, il n’y a qu’une seule limite. Et c’est votre capacité à décrire vos besoins.

En déléguant la plomberie technique à votre LLM, vous regagnez un temps précieux pour vous concentrer sur la stratégie de vos flux de données.

- Partager l'article :