Dans les coulisses de l’algorithme, les certitudes des éditeurs de sites sont souvent bousculées par la réalité technique de Google. Le 03 mars 2026, John Mueller, Wewmaster Trends Analyst chez Google, a mis en lumière des révélations cruciales sur les statistiques GSC. Et alors que nous passons des heures à peaufiner nos fichiers techniques, il s’avère que certains signaux que nous jugeons essentiels sont, en réalité, de simples suggestions pour les robots.

Ce blocage ou cette envolée de chiffres dans notre interface de suivi ne sont pas alors des anomalies.

Il s’agit en réalité du reflet d’une nouvelle ère où l’IA et la pertinence perçue dictent leur loi sur notre visibilité.

Google just revealed how sites should be named if you want to show up in traditional + AI search results.

— Alex Groberman (@alexgroberman) December 26, 2025

This comes straight from Google's John Mueller.

Someone complained that their site doesn’t show up when they search for *their own* site name.

John’s response was blunt:… pic.twitter.com/OfUH07m0Nv

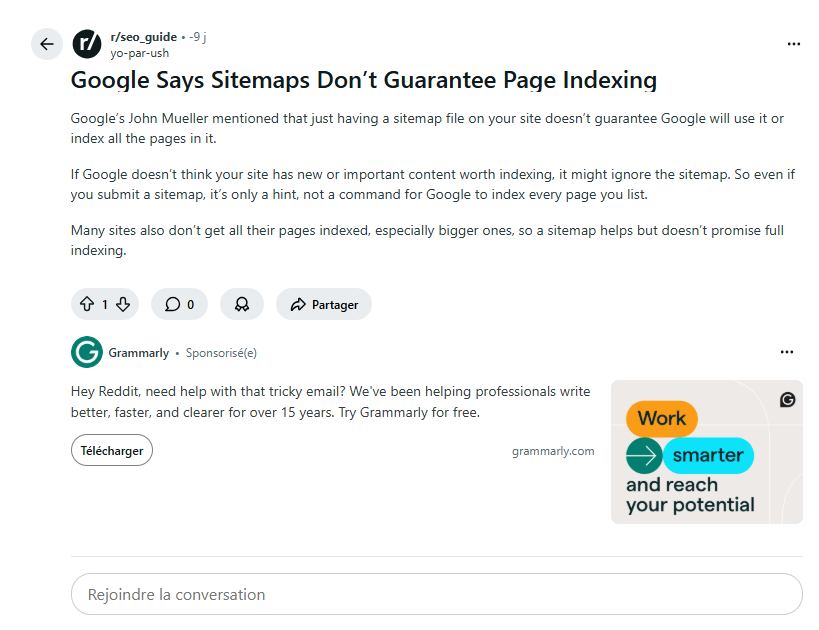

Notre sitemap n’est donc pas une garantie d’indexation

Pour commencer notre optimisation technique, nous devons accepter une vérité brutale. Sachez alors que la soumission d’un fichier sitemap.xml ne constitue en aucun cas un contrat d’indexation avec Google.

Même si vous utilisez cet outil pour orienter le crawl des robots, John Mueller a récemment précisé sur Reddit que le moteur de recherche s’autorise à ignorer totalement ces fichiers.

Cette situation se produit principalement si l’algorithme estime que votre site ne propose pas de nouveaux contenus suffisamment importants ou qualitatifs pour justifier l’effort de stockage.

Ensuite, vous devez considérer le sitemap comme une simple carte routière que Google choisit de suivre, ou non, selon la valeur ajoutée qu’il perçoit.

Finalement, bien que le taux de fiabilité de cette information soit de 3/3, il reste judicieux de maintenir ces fichiers à jour pour favoriser la découverte de vos pages, tout en sachant que l’indexation finale dépendra uniquement de la qualité intrinsèque de votre production.

GMes recommandations : gérez l’explosion de vos impressions sans céder à la panique

Une hausse soudaine des impressions dans votre Search Console sans une augmentation proportionnelle des clics peut générer une frustration légitime. Mais vous ne devez pas y voir un problème technique ou une pénalité imminente.

Pour analyser ce phénomène, sachez que Google effectue régulièrement des tests ou expose vos contenus de manière plus large via de nouvelles fonctionnalités comme les AI Overviews ou le AI Mode.

Ces outils génératifs affichent vos données pour enrichir une réponse sans pour autant garantir que l’internaute cliquera sur votre lien.

Ensuite, vous devez comprendre que cette visibilité accrue, bien qu’invisible sur votre compteur de trafic, signifie que vous apparaissez dans les radars de l’algorithme pour des requêtes plus vastes.

Et avec un indice de fiabilité de 3/3, vous devez interpréter ces pics comme une étape normale de l’évolution des moteurs de recherche, où l’exposition ne se traduit plus systématiquement par une visite immédiate, mais par une présence accrue dans l’écosystème informationnel de l’utilisateur.

L’impact de ces révélations sur votre quotidien est majeur. Elles vous obligent à délaisser la simple obsession technique pour vous concentrer sur la valeur réelle perçue par l’IA.

Si vous arrivez à comprendre que vos outils ne sont que des boussoles et non des télécommandes, vous gagnerez en sérénité face aux fluctuations de vos rapports statistiques.

- Partager l'article :