RAG ou Fine-tuning : votre stratégie de modèle impacte directement les coûts et la fiabilité des données. Ce guide décrypte comment une architecture LLM optimisée peut réduire fortement vos coûts tout en limitant significativement les hallucinations factuelles.

L’adoption de l’intelligence artificielle ne suffit plus pour rester compétitif ; la maîtrise de vos données est devenue un levier stratégique clé. Choisir entre la mémoire dynamique de la recherche augmentée (RAG) et l’expertise structurée du Fine-tuning détermine à la fois la précision, la sécurité et la pérennité de vos systèmes. Ce choix impacte directement les coûts et l’agilité de votre organisation face à une concurrence de plus en plus automatisée.

Les deux piliers de l’IA moderne

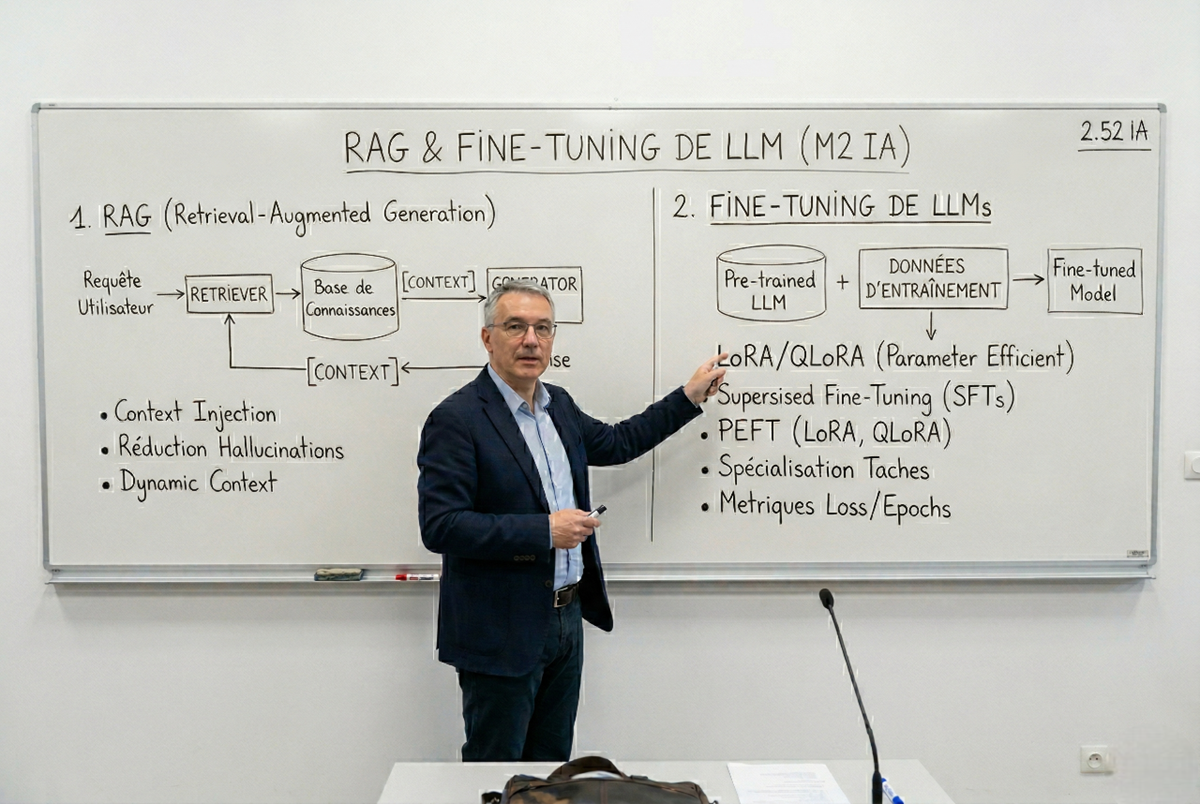

Le déploiement d’une IA générative en entreprise repose sur deux piliers technologiques distincts. Ces deux méthodes peuvent toutefois collaborer au sein d’une architecture hybride complexe. D’un côté, nous exploitons la flexibilité d’une source de données externe et connectée. De l’autre, nous modifions la spécialisation profonde des neurones artificiels du modèle de base.

Une IA connectée à vos données en temps réel avec le RAG

Le RAG IA ou le Retrieval-Augmented Generation agit comme un assistant doté d’une bibliothèque illimitée. Cette bibliothèque est mise à jour quotidiennement pour refléter la réalité de votre métier. Au lieu de compter sur ses souvenirs, le système interroge une base vectorielle performante. Des solutions comme Pinecone ou Weaviate permettent d’extraire l’information brute en quelques millisecondes seulement.

Cette méthode sépare la capacité de raisonnement linguistique de la connaissance factuelle pure. Le modèle ne sait pas tout, mais il sait où chercher l’information fiable. Le processus se déroule en trois étapes techniques : l’encodage, la recherche et la génération. Le modèle reçoit ainsi un contexte enrichi contenant les preuves nécessaires à sa réponse. Le RAG aide, pour sa part, à fournir des sources vérifiables sans aucun processus de calcul lourd.

Le Fine-tuning IA : une expertise métier gravée dans le modèle

Le fine-tuning IA consiste à reprendre un modèle pré-entraîné pour ajuster ses paramètres internes. On utilise pour cela un jeu de données spécialisé et annoté par des experts. Le modèle ne reçoit pas de documents à lire au moment de la question. On lui apprend plutôt à penser et à s’exprimer selon vos codes spécifiques.

Cette technique modifie durablement le comportement du modèle de langage de façon structurelle. Le changement est permanent, indépendamment de la nature des requêtes qu’il reçoit par la suite. Cette spécialisation est particulièrement pertinente pour des tâches de classification complexe ou de respect stylistique. Si votre architecture LLM exige un format JSON strict, l’entraînement devient alors nécessaire.

5 techniques to fine-tune LLMs, explained visually!

— Akshay 🚀 (@akshay_pachaar) October 1, 2024

Fine-tuning large language models traditionally involved adjusting billions of parameters, demanding significant computational power and resources.

However, the development of some innovative methods have transformed this… pic.twitter.com/cuIHSIazpe

La robustesse et la transparence des décisions

Actuellement, la confiance dans l’IA repose sur la capacité d’audit des réponses générées. Les entreprises exigent des systèmes capables de justifier chaque affirmation pour limiter les risques juridiques.

Auditabilité et traçabilité des sources

Le RAG offre une transparence native exceptionnelle pour les environnements réglementés. Chaque réponse générée peut pointer vers la source exacte et le paragraphe d’origine dans vos documents. Cette traçabilité permet un audit immédiat par un opérateur humain en cas de doute. La confiance utilisateur s’en trouve renforcée par cette capacité de vérification directe et systématique.

À l’inverse, le Fine-tuning fonctionne comme une « boîte noire » où les décisions sont prises en interne. Il est extrêmement difficile d’expliquer pourquoi le modèle a généré une information spécifique plutôt qu’une autre. Cette opacité représente un frein majeur pour les secteurs de la santé ou de la finance. Sans preuve tangible, la responsabilité de l’entreprise est, en effet, plus difficile à dégager en cas d’erreur.

Tolérance aux erreurs et robustesse du système

La robustesse face aux données imparfaites est un autre point de divergence crucial entre ces technologies. Le RAG fait preuve d’une grande tolérance car il peut croiser plusieurs sources pour valider une info. Si un document est bruité, le système peut s’appuyer sur d’autres extraits pour corriger le tir. Cette redondance documentaire assure alors une stabilité de réponse même avec une base de données hétérogène.

Le Fine-tuning est beaucoup plus sensible à la qualité intrinsèque du dataset de départ. Une erreur présente dans les données d’entraînement est « apprise » et se propage systématiquement dans les réponses. Cela peut créer des biais ou des erreurs factuelles récurrentes et très difficiles à corriger a posteriori. La préparation d’un dataset parfait devient alors un enjeu de sécurité critique pour votre projet.

Pilotage, coûts et infrastructure technique

Le choix architectural impacte directement votre dépendance aux ressources matérielles et votre agilité financière. Entre le Cloud souverain et les serveurs dédiés, les stratégies diffèrent selon votre modèle.

Dépendance à l’infrastructure et scalabilité

L’infrastructure d’un système RAG repose principalement sur la performance de la base vectorielle choisie. Elle dépend également de la stabilité de l’API du modèle de langage utilisé en bout de chaîne. Cette architecture est facilement scalable car elle ne nécessite pas de serveurs de calcul intensif en continu. Vous payez pour ce que vous consommez, ce qui optimise votre budget opérationnel (OpEx).

Le Fine-tuning exige une infrastructure lourde, incluant des clusters de GPU puissants pour les phases d’entraînement. La maintenance d’un modèle spécifique demande des ressources serveurs dédiées pour l’hébergement du modèle « poids lourd ». Cela représente un investissement en capital (CapEx) significatif et une complexité de gestion matérielle accrue. Pour une PME, cette barrière à l’entrée peut s’avérer rédhibitoire par rapport à la souplesse du RAG.

Selon vos besoins et volumes de données, vous pouvez opter pour des serveurs locaux ou utiliser des API cloud comme OpenAI. La première infrastructure vous aide à réduire les coûts à long terme, la seconde offre plus de flexibilité.

L’impact sur la consommation de tokens et le Prompt Engineering

Le RAG dépend fortement de la qualité du prompt engineering pour piloter correctement le modèle. Chaque requête inclut des documents sources, ce qui augmente mécaniquement la consommation de tokens à chaque appel. La facture API peut donc grimper si vos documents injectés sont trop longs ou mal segmentés. C’est le prix à payer pour une information toujours fraîche et parfaitement sourcée.

Une approche avec le Fine-tuning réduit cette dépendance aux instructions complexes car le comportement est déjà câblé en interne. Les réponses sont plus directes et consomment moins de tokens en entrée de prompt. Vous gagnez en vitesse de génération et réduisez vos coûts variables sur les gros volumes de trafic. Cet avantage économique devient décisif dès que votre application dépasse les milliers d’utilisateurs quotidiens.

What is fine tuning and custom models? 🤖⏳ pic.twitter.com/njGdquNSoG

— Auth0 (@auth0) March 11, 2026

Sécurité, confidentialité et interopérabilité

Aujourd’hui, l’interopérabilité des systèmes garantit que vous ne resterez pas prisonnier d’une technologie obsolète. La protection des données doit s’accompagner d’une liberté de mouvement technologique totale.

Contrôle granulaire et droit à l’oubli

Le RAG permet un contrôle granulaire des accès directement au niveau de la couche de données. Si vous supprimez un document de votre base, l’IA oublie instantanément cette information lors de la requête suivante. Cette agilité est indispensable pour respecter le droit à l’oubli et les mises à jour réglementaires urgentes. Vos données restent ainsi dans votre propre périmètre de sécurité. Cela limite les risques de fuites majeures.

Portabilité et standards ouverts

L‘interopérabilité est le point fort du RAG car il utilise des standards ouverts pour le stockage vectoriel. Vous pouvez migrer votre base de connaissances d’un modèle OpenAI vers un modèle LLama 4 en quelques heures. Cette flexibilité vous protège contre le vendor lock-in (verrouillage fournisseur) et assure la pérennité de vos investissements. Vous n’êtes alors plus lié au destin d’un seul fournisseur de technologie IA.

Le Fine-tuning est par nature spécifique à une architecture de modèle et à un fournisseur précis. Entraîner un modèle propriétaire vous lie contractuellement et techniquement à cet écosystème pour longtemps. La migration vers une autre technologie demande alors un nouvel investissement massif pour ré-entraîner vos données. Cette dépendance stratégique doit être analysée avec prudence par vos responsables de la sécurité des systèmes d’information.

Comparatif stratégique : agilité vs profondeur

| Critère de décision | RAG (Agilité & données) | Fine-tuning (Profondeur & style) |

| Mise à jour des données | Instantanée (Simple upload) | Lente (Réentraînement complet) |

| Traçabilité / Audit | Totale (Citations directes) | Nulle (Boîte noire interne) |

| Robustesse | Haute (Croisement de sources) | Faible (Erreurs propagées) |

| Infrastructure | Base vectorielle + API | Serveurs GPU dédiés |

| Time-to-market | Quelques jours (MVP) | Plusieurs semaines (Expertise) |

| Interopérabilité | Excellente (Modèles interchangeables) | Faible (Spécifique au modèle) |

Une stratégie hybride pour l’excellence IA ?

En définitive, RAG et Fine-tuning ne s’opposent pas mais s’additionnent pour créer des systèmes robustes. Le RAG est parfait pour les domaines multi-sujets et les informations volatiles comme le support client. Le Fine-tuning brille dans les domaines ultra-spécialisés exigeant une forme parfaite, comme la rédaction de contrats juridiques.

Ma recommandation stratégique est de privilégier en priorité une implémentation de type RAG. Cela sécurise votre auditabilité et votre droit à l’oubli tout en maîtrisant votre budget initial. Une fois le cas d’usage stabilisé, le Fine-tuning peut intervenir pour optimiser la performance et réduire la latence. En combinant le meilleur des deux mondes, vous bâtissez une IA résiliente, éthique et surtout rentable.

FAQ : Questions fréquentes sur les différences stratégiques

- Le RAG est-il plus fiable pour la conformité RGPD ?

Oui, car il permet un retrait immédiat des informations et un contrôle d’accès granulaire sur les documents sources. - Quelle solution choisir pour des données qui changent toutes les heures ?

Le RAG est la seule option viable car il met à jour sa base de connaissances instantanément sans réentraînement. - Le Fine-tuning est-il nécessaire pour imposer un ton de voix ?

Il est très performant pour cela, mais un bon prompt engineering avec RAG peut souvent suffire pour des besoins standards. - Peut-on auditer les réponses d’un modèle fine-tuné ?

C’est très complexe. Contrairement au RAG, il ne peut pas citer spontanément le document source d’une information apprise.

- Partager l'article :