TabTransformer d'Amazon Web Service (AWS) ouvre la voie à l'utilisation du deep learning pour les données dans les tableaux.

Les Transformers sont principalement utilisés dans le cadre du NLP (traitement du langage naturel). Pour les données tabulaires, l'arbre de décision était la meilleure méthode avant qu'AWS dévoile TabTransformer. Désormais, le deep learning permet d'obtenir des résultats tout aussi efficaces.

AWS TabTransformer : le deep learning au service des tableaux de données

En termes d'IA, les Transformers appartiennent au domaine du machine learning. Plus exactement, il s'agit d'un modèle de deep learning qui est probablement l'une des formes d'IA les plus puissantes. En effet, les modèles les plus puissants, tels que GPT-3 d'OpenAI ou BERT de Google, reposent sur les réseaux neuronaux profonds. Les Transformers constituent généralement la base des grandes applications de NLP.

Entre autres, le deep learning a permis de faire d'énormes progrès dans presque tous les domaines d'application de l'IA. Néanmoins, il y a un domaine pour lequel le deep learning n'était pas encore la meilleure alternative. Il s'agit de l'analyse des données contenues dans des tableaux.

Jusqu'alors, les meilleurs résultats étaient le fruit des méthodes basées sur les arbres de décision. Mais les chercheurs d'AWS ont commencé à développer TabTransformer. Ils le présentent comme une nouvelle architecture de réseaux de neurones profonds qui modélise les données tabulaires pour l'apprentissage supervisé et semi-supervisé.

Une nouvelle application pour les Transformers

TabTransformer prend en charge les tâches de classification et de régression avec Amazon SageMaker JumpStart d'AWS. Les utilisateurs de Python peuvent y accéder depuis l'interface utilisateur de SageMaker JumpStart dans SageMaker Studio et le SDK SageMAker Python. Par ailleurs, AWS l'a ajouté au dépôt de la bibliothèque Python open source Keras.

TabTrasnsformer utilise donc des Transformers pour créer des représentations de données pour les variables catégorielles. Quant aux valeurs numériques et les variables continues, il les traite dans des flux parallèles. Par ailleurs, il utilise le NLP pour apprendre un schéma d'intégration générale après avoir formé le modèle sur des données non étiquetées. Celui-ci est ensuite affiné sur des données étiquetées pour une tâche spécifique.

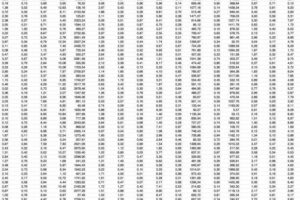

Les chercheurs ont testé TabTransformer sur 15 ensembles de données accessibles au grand public. Les résultats du modèle ont dépassé d'au moins 1,0 % ceux des algorithmes de deep learning de pointe pour les données tabulaires, sur l'AUC (aire sous la courbe) moyenne.

En outre, avec des données étiquetées limitées, les réseaux de neurones profonds dépassent souvent les modèles basés sur les arbres de décisions dans l'apprentissage semi-supervisé. Cette fois, TabTransformer d'AWS a montré une augmentation moyenne de 2,1 % sur l'AUC par rapport au benchmarck appliquant la méthode la plus avancée d'apprentissage non supervisé.

En gros, malgré les données manquantes ou bruitées, les incorporations apprises à l'aide de TabTransformer sont plus résistantes et plus interprétables. De ce fait, l'étude montre que la puissance du deep learning peut finalement s'appliquer aux données tabulaires.

- Partager l'article :