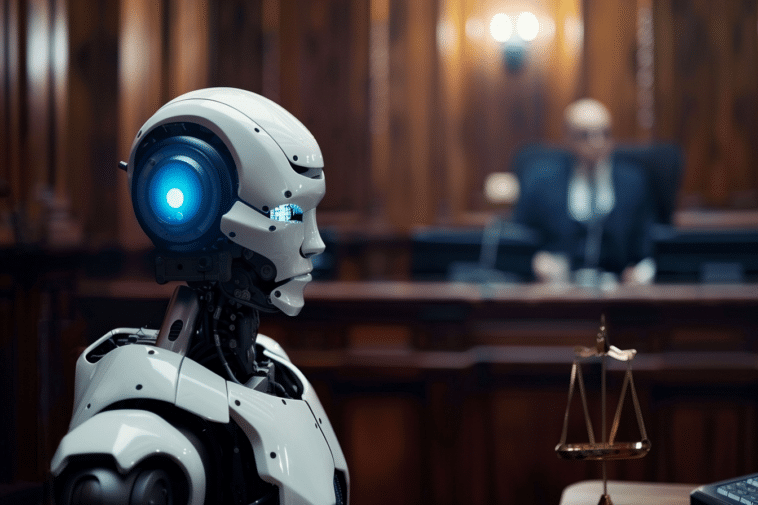

OpenAI vient de faire face à une situation incontrôlable. ChatGPT, son fameux chatbot, aurait publié des informations confidentielles d’un utilisateur. Mais étonnamment, OpenAI n’a rien pu faire pour y remédier.

Les clauses du RGPD stipulent que toute entreprise œuvrant dans le développement d’intelligence artificielle se doit d’accéder aux informations collectées par leur système.

Or, OpenAI, la plus grande entreprise d’IA, affirme ne pas savoir quelles données ChatGPT a stockées durant ces deux ans.

La firme n’a même pas la capacité de corriger le tir, ni de rectifier les informations malgré le volume de données à sa disposition.

Par contre, elle est bien consciente de l’impact d’une telle situation. Et pour répondre aux allégations, OpenAI a juste annoncé qu’ils sont actuellement en phase de recherche sur l’exactitude factuelle des réponses de son LLM.

De fausses informations confidentielles fournies par ChatGPT que même OpenAI ne peut pas effacer ni modifier

En 2022, OpenAI a lancé ChatGPT et en très peu de temps, le chatbot a fait l’objet d’un battage médiatique.

Tout le monde s’est alors mis à adopter l’outil. Entreprises, particuliers, professionnels et amateurs, chacun a utilisé l’IA à volonté.

Sauf que de plus en plus, ChatGPT commence à dérailler. Ses réponses commencent à devenir de moins en moins factuelles.

Aujourd’hui, OpenAI a déployé d’autres versions plus performantes, notamment GPT-4 Turbo. Mais rien ne garantit que l’outil puisse fournir des réponses correctes et factuelles.

Autrement dit, les IA génératives ont souvent tendance à inventer leurs réponses. Mais certaines réponses sont néanmoins tolérables. Mais pas quand il s’agit d’informations confidentielles que ChatGPT fournit sur un quelconque individu.

À ce propos, Nyob a déposé une plainte contre OpenAI pour non-respect de la vie privée d’un utilisateur.

Selon lui, ChatGPT aurait inventé de fausses réponses quand il lui a demandé sa date d’anniversaire.

Ce qui va à l’encontre de l’article 5 du RGPD. Autrement dit, ChatGPT aurait pu admettre qu’il ne connaissait pas la réponse au lieu d’en inventer une autre.

Il s’agit ici d’une violation du règlement. Et pour couronner le tout, OpenAI a rejeté la demande de modification de l’utilisateur. Elle a même refusé de supprimer ces données incorrectes.

Sa seule réponse : « il nous est impossible d’apporter des modifications sur les données que ChatGPT collecte et fournit ».

Et d’après les nouvelles, OpenAI a même refusé de révéler les sources des données d’entraînement de ChatGPT.

Du point de vue légal, c’est encore une fois une violation de l’article 15 du Règlement Général sur la Protection des Données. Mais aussi de l’article 16 permettant aux habitants de l’Union européenne de supprimer les fausses informations leur concernant.

OpenAI muet, l’enquête se poursuit

À l’heure actuelle, NYOB demande au DSG (autorité autrichienne de protection de données) d’ouvrir une enquête sur comment OpenAI traite les données.

Elle sollicite également les autorités à identifier quelles mesures a-t-il adopté OpenAI pour garantir l’exactitude des données personnelles des utilisateurs de ChatGPT.

Pour finir, NYOB ajoute qu’OpenAI devrait s’aligner à toutes demandes de suppression ou de modification en cas de plainte. Et donc de se conformer aux RGPD.

À titre d’information, ce n’est pas la première fois qu’OpenAI fait l’objet d’une controverse. Dernièrement, le Wall Street Journal a interrogé Mira Murati, directrice technique d’OpenAI, sur les données d’entraînement de Sora AI.

Mais comme par hasard, elle n’a pas pu répondre à la question. Sa seule réponse : « ce sont des données sous licence et accessibles au public ».

- Partager l'article :