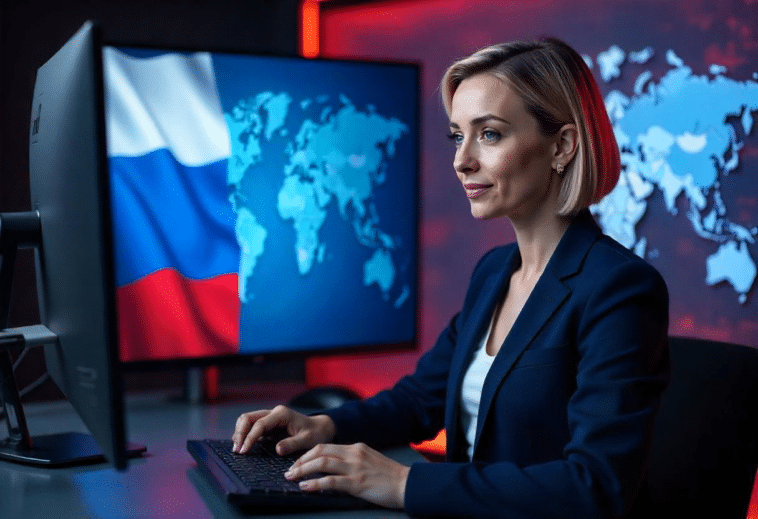

Cette information fait l’effet d’une bombe, la propagande russe arrive à détourner ChatGPT et les autres assistants d’IA. Comment distinguer le vrai du faux ? Comment se protéger de la désinformation massive amplifiée par l’IA ? Des réponses à prendre, sûrement, avec des pincettes !

L’année 2024 nous a prouvé que tout était possible avec l’intelligence artificielle. Si beaucoup avaient pensé que cet outil n’était juste qu’un gadget de la Silicon Valley, il faut croire qu’ils ont eu tords. En effet, les chatbots d’IA gratuits se sont révélés être une véritable aide dans l’optimisation du temps de travail. Qui plus est, ils ont été de véritables assistants dans la réalisation des tâches chronophages. Cependant, ces outils se sont également révélés être une puissante arme dans la guerre des informations.

Selon une étude réalisée par NewsGuard, le Kremlin aurait détourné ces chatbots en faveur de la propagande russe depuis le début de la guerre en Ukraine. Mais comment ? Tout simplement en se faisant passer pour des médias d’information locaux et en influençant les réponses données par les agents d’IA. Deepfakes, faux sites d’informations, appels téléphoniques automatisés…l’IA est devenu un terrain propice à la désinformation. Explication !

L’IA au service de la désinformation massive russe ?

D’après NewsGuard, dix des assistants d’IA les plus utilisés à l’instar de ChatGPT ou encore de Perplixity ont relayé des fausses informations pro-kremlin au cours de ces dernières années. Ces fakes news proviennent des sites et des plateformes relatives à la propagande russe.

Parmi ces campagnes de désinformation, la plus récente concerne certainement cette vidéo qui montre des combattants Azov en train de brûler des effigies de Donald Trump. Il y a également ces prétendus récits sur l’interdiction de Truth Network par Volodymyr Zelensky ou encore ces laboratoires d’armes biologiques en Ukraine.

Malheureusement, les chatbots d’IA n’arrivent pas à distinguer le vrai du faux. Ils relayent les informations telles qu’elles. Ils ne sont pas en mesure de reconnaître que certains sites et plateformes sont utilisés uniquement pour la propagande russe. Ces infox sont générées, publiées et validées par les chatbots. Cela les rend crédibles aux yeux des utilisateurs. Et oui, qui ne croirait pas à une information publiée par ChatGPT, le numéro un des chatbots d’IA du moment !

Pourquoi ChatGPT est exposé aux campagnes de désinformation russe ?

Si les assistants conversationnels comme ChatGPT font les frais des campagnes de désinformation russe c’est tout simplement à cause de leur mode d’entraînement. En effet, pour pouvoir proposer des réponses aux questions des utilisateurs, ces chatbots utilisent et recyclent des informations publiés sur les sites web gratuits, les réseaux sociaux et les plateformes web tels que Wikipédia.

Ces informations sont nécessaires pour qu’un modèle d’IA puisse répondre correctement aux questions qui leur soient posées. Toutefois, cette quantité de données les exposer à des risques de désinformation. Qui plus est, la production et la diffusion de ces infox se font en un temps record, contrairement à ces années où les campagnes étaient réalisées par « des petites mains » derrière les écrans.

Qu’est-ce qu’il faut faire pour ne pas tomber dans ces pièges ?

Il faut le reconnaître, de plus en plus d’internautes se tournent vers les chatbots d’IA pour trouver les réponses à leurs questions. Mais la question qui se pose c’est comment éviter les pièges liés aux désinformations ? Nous avons déjà rencontrés ce même problème dans le passé avec l’apparition des moteurs de recherche. Toutefois, avec le temps, les utilisateurs ont appris à trier les informations et à discerner les résultats fiables.

Cela sera également le cas avec l’IA. Le grand public a besoin d’être éduqué pour adopter une approche critique face aux réponses que les chatbots fournissent. Entre temps, la régulation de l’IA s’impose, notamment la transparence des bases de données utilisées pour les modèles de langage.

Certes, des entreprises technologiques telles que Meta, Microsoft, Google, OpenAI et X, se sont engagés pour lutter contre les fakes news, surtout lors des élections. Cependant, dans cette course effrénée à l’IA, est-ce que ces engagements seront suffisants pour endiguer contenus trompeurs générés par l’IA ? Une question qui nécessite une réponse pour assurer l’intégrité de l’information à l’ère où les agents conversationnels intelligents occupent de plus en plus de place dans notre société.

- Partager l'article :