Gemini 3.1 Pro s’impose en ce printemps 2026 comme le nouveau maître du raisonnement abstrait. En doublant ses scores de logique pure en seulement trois mois pour atteindre 77,1 % sur le benchmark ARC-AGI-2, Google DeepMind ne se contente pas de rattraper la concurrence : il redéfinit les standards de l’intelligence « agentique ». Pour les entreprises, ce modèle marque la fin de l’IA qui « récite » au profit d’une IA qui « réfléchit » véritablement face à l’imprévu.

Ce modèle est le premier à utiliser l’incrément « .1 » (au lieu du traditionnel « .5 »), signalant une mise à niveau chirurgicale du moteur de raisonnement.

Il s’agit de la démocratisation de la technologie Deep Think — celle-là même qui a réfuté une conjecture mathématique vieille de dix ans en février dernier — désormais accessible à tous les développeurs et abonnés Google Cloud.

Qu’est-ce que Gemini 3.1 Pro ?

Décrit par Google DeepMind comme une « suite de modèles de raisonnement multimodaux natifs et hautement performants », Gemini 3.1 Pro repose sur l’architecture du Gemini 3 Pro lancé en novembre 2025.

Une nomenclature délibérée

Contrairement aux cycles précédents (1.5, 2.5), l’incrément « .1 » indique qu’il ne s’agit pas d’une refonte architecturale complète, mais d’une mise à niveau ciblée du système de raisonnement.

C’est le moteur de raisonnement de « Deep Think » (le modèle scientifique de pointe qui a réfuté une conjecture mathématique vieille de dix ans en février 2026) mis à la disposition des entreprises et des développeurs.

Capacités clés :

- Multimodalité native : texte, images, audio, vidéo et code.

- Fenêtre de contexte : 1 million de jetons en entrée et 64 000 en sortie.

- Accessibilité : ddisponible via API, Vertex AI et les abonnements Google standards.

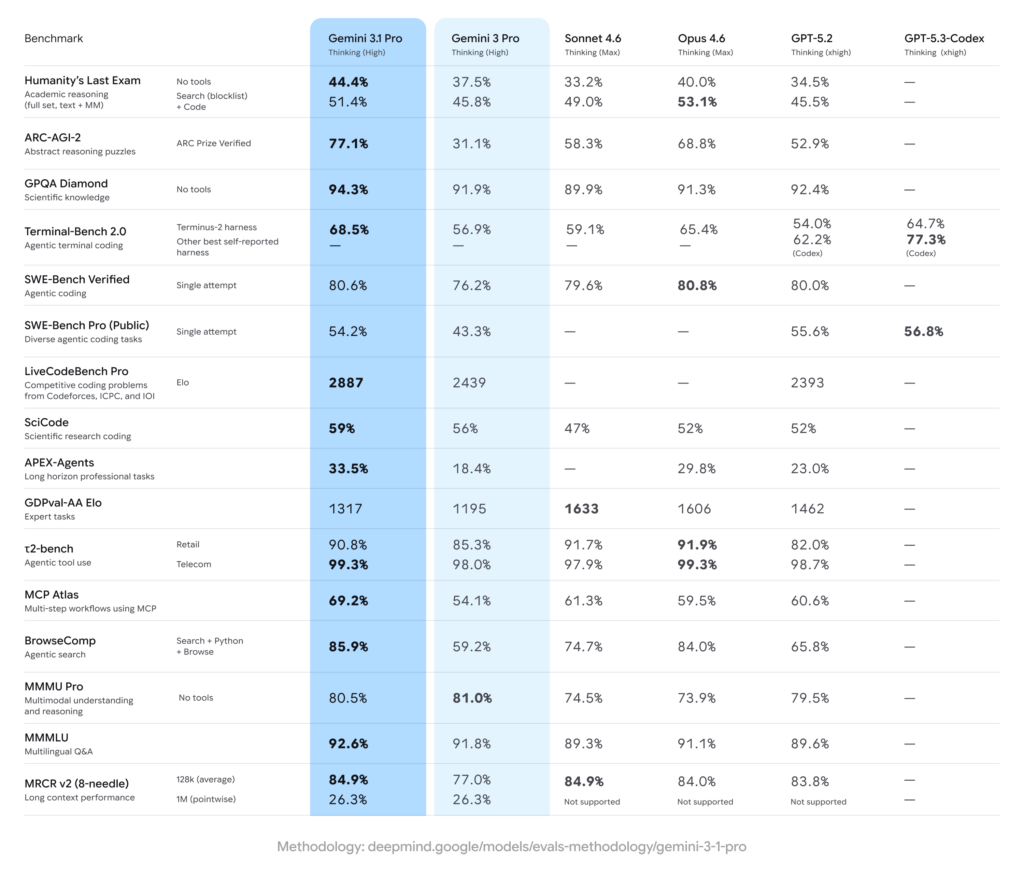

Gemini 3.1 Pro domine le raisonnement sur les benchmarks

Le changement le plus significatif réside dans la capacité du modèle à résoudre des problèmes inédits, testée par le benchmark ARC-AGI-2.

Ce test est conçu pour empêcher la mémorisation : il évalue la capacité à inférer des règles à partir de schémas logiques jamais rencontrés.

Comparatif du raisonnement pur

| Modèle | ARC-AGI-2 (Raisonnement abstrait) | GPQA Diamond (Sciences Master) |

| Gemini 3.1 Pro | 77,1 % | 94,3 % |

| Gemini 3 Pro | 31,1 % | 91,9 % |

| Claude Opus 4.6 | 68,8 % | 91,3 % |

| GPT-5.2 | 52,9 % | 92,4 % |

Sur GPQA Diamond, Gemini 3.1 Pro a obtenu le meilleur score jamais enregistré (94,3 %), surpassant toutes les IA de pointe actuelles.

Sur le test académique complet « Humanity’s Last Exam », il atteint 44,4 %, confirmant sa supériorité sur Opus 4.6 et GPT-5.2.

Pensée dynamique et paramètre thinking_level

Gemini 3.1 Pro introduit la « pensée dynamique » : un raisonnement automatique en chaîne dont la profondeur s’adapte à la complexité de la tâche.

Pour les développeurs, ce comportement est configurable via le paramètre thinking_level à quatre niveaux :

- Low : pour les tâches factuelles simples et rapides.

- Medium (Nouveauté 3.1) : comble le manque entre vitesse et profondeur pour les applications de production.

- High : pour les synthèses de recherche en plusieurs étapes.

- Max : pour les problèmes de délibération maximale.

Performances « Agentiques » et Codage

Le terme « agentique » désigne la capacité de l’IA à fonctionner de manière autonome. Gemini 3.1 Pro réalise des gains relatifs impressionnants :

- APEX-Agents (Tâches pro long terme) : 33,5 % (+82 % de gain relatif).

- BrowseComp (Recherche web autonome) : 85,9 % (+45 % de gain relatif).

- Terminal-Bench 2.0 (Codage terminal) : 68,5 %, devant Claude Opus 4.6 (65,4 %).

Capacité de Codage

Avec un score Elo de 2887 sur LiveCodeBench Pro (contre 2393 pour GPT-5.2), Gemini 3.1 Pro s’impose comme le leader de la programmation compétitive.

Sur le test SWE-Bench Verified (génie logiciel réel), il talonne Claude Opus 4.6 à 0,2 point de pourcentage près (80,6 % contre 80,8 %).

La fin de la troncature

Il faut reconnaître qu’un correctif majeur a été apporté concernant la troncature des réponses. JetBrains a confirmé que la version 3.1 Pro offre des résultats plus fiables avec moins de jetons de sortie, réduisant ainsi directement les coûts d’API.

Multimodalité et SVG Animés

L’une des fonctionnalités les plus bluffantes est la capacité du modèle à générer des SVG animés et des expériences interactives en code pur.

Comme ce sont des définitions mathématiques, les fichiers sont légers, redimensionnables sans perte de qualité et modifiables.

Des tests indépendants (DataCamp) ont validé la génération d’animations de chargement fluides et professionnelles dès le premier essai.

Google a également démontré des tableaux de bord aérospatiaux en direct et des simulations 3D avec bandes-son génératives adaptées aux mouvements.

Là où la concurrence garde l’avantage

Un rapport équilibré impose de noter que Gemini 3.1 Pro ne gagne pas partout :

- Claude Opus 4.6 reste le maître des tâches professionnelles exigeantes (modélisation financière, juridique) via le test GDPval-AA. Il excelle aussi dans l’utilisation d’ordinateurs via interface graphique et l’orchestration multi-agents (Agent Teams).

- GPT-5.3-Codex conserve l’avantage sur le benchmark SWE-Bench Pro (56,8 %).

Accès, tarification et cas d’usage

Comment y accéder dès aujourd’hui ?

- API Gemini (Google AI Studio) : modèle gemini-3.1-pro-preview.

- Gemini CLI : agent terminal via npm install -g @google/gemini-cli.

- Vertex AI : pour les entreprises (sécurité, conformité, VPC).

- Google Antigravity : plateforme de développement multi-agents.

- NotebookLM : optimisé pour les abonnés Pro et Ultra.

Tarification (Aperçu)

Le prix est identique à celui du Gemini 3 Pro Preview, rendant la mise à niveau « gratuite » en termes de performance.

- Entrée : 2,00 $ / million de jetons (contexte < 200k).

- Sortie : 12,00 $ / million de jetons.

- Forfaits : Google AI Pro (19,99 $/mois) et Ultra (249,99 $/mois).

Cas d’utilisation concrets

- Recherche scientifique : lecture simultanée de dizaines d’articles grâce à la fenêtre d’un million de jetons.

- Analyse de code source : traquer un bug dans un dépôt entier (exemple de Cartwheel sur les transformations 3D).

- Agents de recherche autonomes : collecte et vérification croisée d’informations sans intervention humaine.

- Synthèse de données d’entreprise : analyse de données tabulaires et non structurées (test OfficeQA de Databricks).

Sécurité et gouvernance

Google a évalué le modèle via son Frontier Safety Framework. Gemini 3.1 Pro n’atteint aucun niveau de capacité critique dans les domaines CBRN ou manipulation malveillante.

Toutefois, ses capacités en cybersécurité ont atteint le « seuil d’alerte », ce qui a nécessité le déploiement de mesures d’atténuation.

Sur le test RE-Bench, le modèle a prouvé qu’il pouvait réduire le temps d’exécution d’une tâche technique de 300 à 47 secondes (battant la référence humaine de 94 secondes).

Gemini 3.1 Pro Grounding has landed #2 in the Search Arena.

— Arena.ai (@arena) March 26, 2026

This places three Gemini models in the top 7 for Search, more than any other lab.

Congrats to @GoogleDeepMind on this achievement! https://t.co/ften5f1syI pic.twitter.com/imtyPmKj4k

FAQ

En gros, c’est quoi la grosse différence avec la version 3.0 ?

C’est simple : le cerveau a été musclé. On ne parle pas d’une nouvelle architecture, mais d’une mise à jour chirurgicale de sa logique. En trois mois, Google a réussi à doubler ses capacités de raisonnement sur des problèmes inédits. Si la version 3.0 était un excellent assistant, la 3.1 commence à réfléchir comme un véritable ingénieur.

C’est quoi cette histoire de score « ARC-AGI-2 » dont tout le monde parle ?

C’est le juge de paix. La plupart des IA réussissent des tests parce qu’elles ont « appris par cœur » Internet. L’ARC-AGI-2 leur soumet des puzzles logiques totalement nouveaux qu’elles n’ont jamais vus. Avec 77,1 %, Gemini 3.1 Pro explose le plafond de verre (Claude est à 68 % et GPT-5 à 52 %). C’est la preuve qu’il ne fait pas que recracher des données, il comprend la logique.

Gemini 3.1 Pro est-il vraiment meilleur que Claude Opus 4.6 ?

Ça dépend de votre usage. Si vous faites de la recherche scientifique pure ou du raisonnement abstrait, Gemini gagne par KO. En revanche, pour tout ce qui touche à l’utilisation concrète d’un ordinateur (cliquer dans des menus, gérer des interfaces graphiques), Claude reste le patron. Gemini est un savant, Claude est un artisan de luxe.

C’est quoi ce nouveau réglage thinking_level dans l’API ?

C’est votre curseur « temps vs intelligence ». Parfois, vous avez besoin d’une réponse rapide pour un truc simple (niveau low). Parfois, vous voulez que l’IA se « pose » et réfléchisse longuement à un problème complexe (niveau max). Le niveau medium est la nouveauté : il offre le meilleur rapport qualité/prix pour la plupart des applications pro.

Est-ce qu’il peut me générer des images ?

Oui et non. Il ne va pas vous sortir une photo (format pixel). Par contre, il est devenu un génie du code visuel. Vous lui demandez un logo animé ou un tableau de bord interactif, et il vous pond le code SVG ou HTML/CSS instantanément. C’est plus léger, c’est redimensionnable à l’infini et c’est directement intégrable dans vos apps.

Un million de jetons de contexte, ça sert vraiment à quelque chose ?

Oh que oui. Ça veut dire que vous pouvez lui balancer tout le code source d’une application ou 10 articles de recherche de 50 pages en une seule fois. Il ne « perdra pas le fil ». Vous pouvez lui poser une question sur un petit bug caché au milieu de 50 000 lignes de code, et il le trouvera.

Est-ce que ça va me coûter plus cher que la version précédente ?

Bonne nouvelle : non. Google a gardé les mêmes tarifs que pour la version 3.0 Preview (2 $ / million de jetons en entrée). Comme le modèle est plus efficace et qu’il a besoin de moins de mots pour répondre, vous pourriez même finir par payer moins cher pour un résultat plus intelligent.

Où est-ce que je peux le tester là, maintenant ?

Plusieurs options :

- Pour les dévs : allez sur Google AI Studio ou via l’API (gemini-3.1-pro-preview).

- Pour les curieux : via l’application Gemini (le déploiement est progressif pour les abonnés Pro/Ultra).

- Pour les hardcores : installez la Gemini CLI (npm install -g @google/gemini-cli) pour l’utiliser directement dans votre terminal.

Est-ce que c’est risqué pour ma cybersécurité ?

Google est très clair : le modèle est puissant, presque trop. Ses capacités en cyber ont atteint un « seuil d’alerte ». Il est tellement bon pour trouver des failles que Google a dû brider certaines fonctions et mettre en place des gardes-fous très stricts avant de le lâcher dans la nature.

- Partager l'article :