Moonshot AI vient de rappeler au monde que la Chine ne fait pas de la figuration dans la course à l’IA. La startup de Pékin lance Kimi K2.5, un modèle titanesque conçu pour rivaliser avec les leaders américains. Et derrière cette annonce se cache une architecture technique impressionnante et des exigences matérielles délirantes.

Dirigée par Yang Zhilin, un ancien ingénieur de chez Google et Meta, Moonshot AI affiche des ambitions mondiales claires.

Soutenue financièrement par les géants Alibaba et Tencent, elle est désormais valorisée à 4,3 milliards de dollars. Et le modèle repose sur une architecture complexe de type Mixture-of-Experts (MoE).

Il totalise environ un trillion de paramètres, une structure qui lui permet d’être puissant tout en restant optimisé.

Kimi K2.5 a d’ailleurs été nourri avec une quantité de données vertigineuse. Et le modèle a absorbé environ 15 000 milliards de tokens de texte et de vision.

Et il s’agit d’un entraînement « multimodal natif », ce qui signifie qu’il comprend les images et la vidéo au même titre que le texte.

La rupture « Agent Swarm » et le Visual Coding

Selon Moonshot, leur modèle fait référence à une innovation majeure qu’ils ont nommée l’Agent Swarm.

Au lieu de confier une mission à une seule entité, Kimi K2.5 peut créer et coordonner automatiquement jusqu’à 100 sous-agents.

Chaque agent gère ensuite une micro-tâche, permettant de lancer jusqu’à 1 500 appels d’outils ou d’API en parallèle.

Si vous lui demandez par exemple de construire un modèle financier à partir de dix PDF, il ne travaille pas séquentiellement.

Il dépêche alors ses agents pour extraire les données et générer les tableaux Excel en simultané. Et selon les retours, cette méthode est environ 4,5 fois plus rapide qu’un agent classique.

Sur les benchmarks AIME 2025 ou GPQA-Diamond, Kimi K2.5 en mode « Thinking » talonne GPT-5.2.

Kimi K2.5 prend même l’avantage sur la partie vision et vidéo native. Ses capacités de « Visual Coding » sont également bluffantes. Elles me rappellent d’ailleurs l’Agentic Vision que Google a récemment lancé dans Gemini Flash.

D’ailleurs, le modèle a la capacité de transformer une capture d’écran en code HTML/CSS prêt à l’emploi, comme le fait Claude 4.5 Opus.

Un écosystème complet pour l’indépendance technologique

à titre d’information, le positionnement de Moonshot AI sur le marché est autant politique que technique.

En publiant Kimi K2.5 sous une licence inspirée du MIT, quasi open source, la startup veut réduire la dépendance aux modèles américains.

Elle affronte directement OpenAI, Anthropic et Google en proposant des API compatibles et des outils de fine-tuning. L’offre ne se limite donc pas au modèle brut.

Moonshot fournit aussi une interface web type « ChatGPT » accessible gratuitement pour tester le modèle.

Elle propose par ailleurs un environnement en ligne CLI orienté code, comparable à Claude Code, avec exécution et gestion de fichiers.

🥝 Meet Kimi K2.5, Open-Source Visual Agentic Intelligence.

— Kimi.ai (@Kimi_Moonshot) January 27, 2026

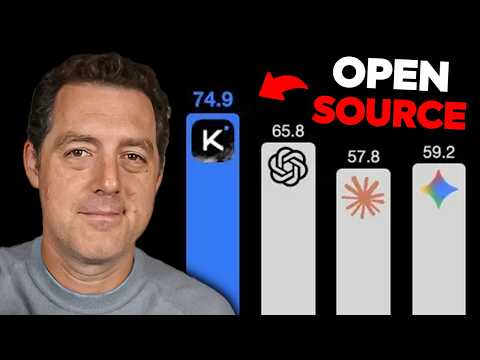

🔹 Global SOTA on Agentic Benchmarks: HLE full set (50.2%), BrowseComp (74.9%)

🔹 Open-source SOTA on Vision and Coding: MMMU Pro (78.5%), VideoMMMU (86.6%), SWE-bench Verified (76.8%)

🔹 Code with Taste: turn chats,… pic.twitter.com/wp6JZS47bN

Préparez votre portefeuille

Si le logiciel est gratuit, le matériel pour le faire tourner en local est hors de prix pour le commun des mortels.

Le modèle complet pèse 630 Go, ce qui élimine d’office les PC portables, les Mac mini et les PC de gaming standards.

Il nécessite des outils spécifiques comme llama.cpp optimisé ou Unsloth. La configuration « pas cher » exige une RTX 4090 avec 24 Go de VRAM et 128 Go de RAM pour une version ultra-compressée en 1.8-bit.

Même avec cela, la vitesse plafonne à un pénible 0,4 token par seconde. La configuration recommandée pour atteindre 5 à 10 tokens par seconde est un Mac Studio M3 Ultra avec 512 Go de RAM unifiée, soit un coût d’environ 14 000 euros.

Pour le mode pro, il faut un serveur équipé de 4 ou 8 GPU NVIDIA H200 avec 141 Go de VRAM chacun.

L’investissement dépasse alors les 200 000 euros, rappelant que la liberté de l’open source a parfois un coût matériel exorbitant.

- Partager l'article :