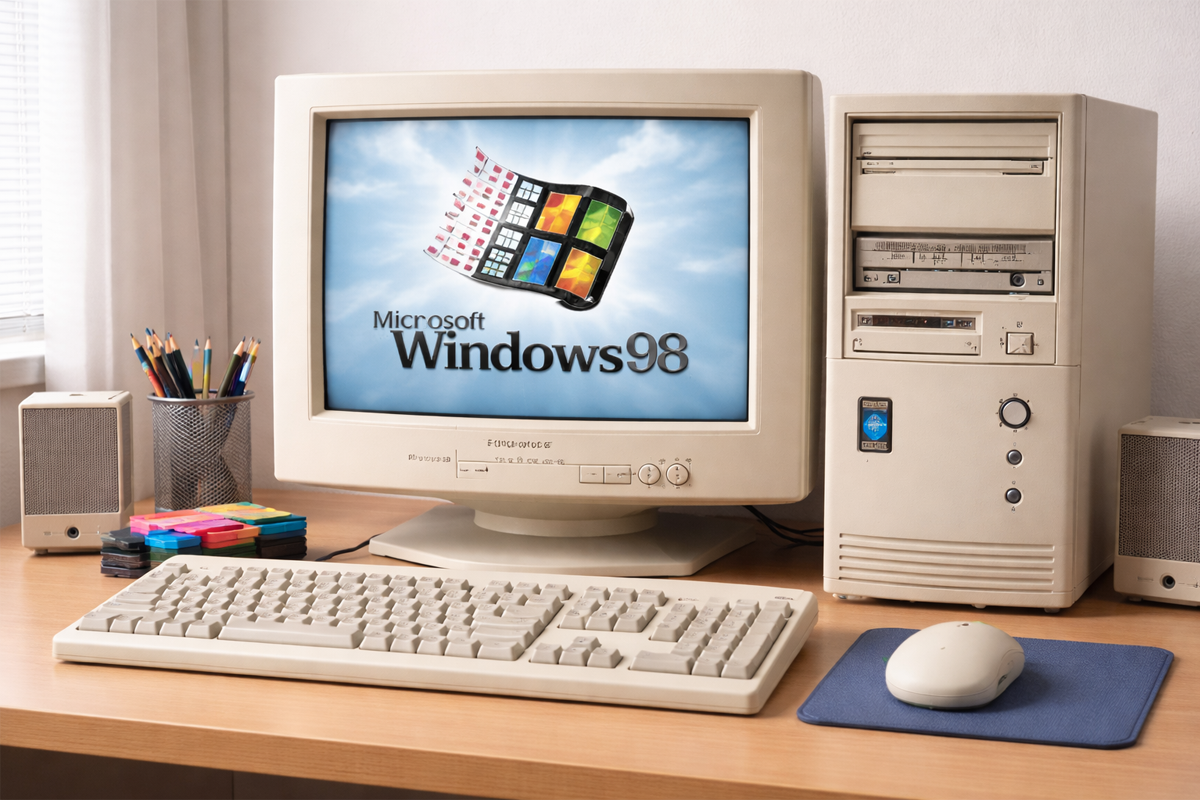

Alors que la Silicon Valley s’enfonce dans une course aux armements matériels vertigineuse, une expérience menée par des chercheurs d’Oxford vient de prouver l’impensable. En faisant tourner un modèle de langage sur un PC de 1998 doté de seulement 128 Mo de RAM, l’organisation EXO Labs démontre que l’optimisation logicielle pourrait être la véritable clé de la démocratisation de l’intelligence artificielle.

Le contraste est tout à fait saisissant. Tandis que les géants du secteur s’arrachent les derniers processeurs Nvidia Blackwell B200 à des prix oscillant entre 30 000 et 40 000 dollars l’unité, une équipe de chercheurs de l’Université d’Oxford a décidé de faire un bond de 27 ans en arrière.

Menée par Mohamed Baioumy et Alex Cheema au sein de l’organisation EXO Labs, cette expérience insolite prouve qu’un processeur Pentium II cadencé à 350 MHz, vestige de l’année de la victoire de la France en 1998, a encore son mot à dire face aux défis de l’IA moderne.

La prouesse de l’optimisation en langage C pur

Pour réussir ce tour de force sur une machine tournant sous Windows 98, les chercheurs ont dû faire preuve d’une ingéniosité technique remarquable.

L’exploit repose d’ailleurs sur l’utilisation du code Llama2.c. C’est une version simplifiée et réécrite en langage C pur. Et elle est capable de s’affranchir des besoins gargantuesques des bibliothèques logicielles contemporaines.

En optimisant drastiquement le chemin entre le processeur et la mémoire vive, l’équipe a pu contourner les limites d’un hardware que tout le monde croyait obsolète pour ce type de tâches.

Des performances surprenantes malgré les limites physiques

Les performances obtenues lors de cette démonstration sont d’ailleurs surprenantes. Sur un modèle léger de 260 000 paramètres, la vieille bécane a affiché une vitesse d’exécution de 39,31 tokens par seconde.

Pour l’utilisateur, cela se traduit par une génération de texte quasi instantanée. Donc plus rapide que la vitesse de lecture humaine moyenne.

Toutefois, les chercheurs ne cachent pas les limites physiques de l’exercice. Si l’on tentait de charger un modèle d’un milliard de paramètres, la vitesse s’effondrerait à 0,0093 token par seconde. L’outil deviendra de ce fait inutilisable.

EXO v1.0.67 is out.

— EXO Labs (@exolabs) January 28, 2026

Adds support for Kimi K2.5 and tensor sharding support for MiniMax M2.1. pic.twitter.com/GRMz5nmA3D

Une cohérence syntaxique au service d’une prose absurde

La prose générée par ce PC de collection, bien qu’absurde sur le fond, témoigne d’une cohérence syntaxique fascinante.

Les dialogues surréalistes entre des personnages nommés « Spot » et « Sleepy Joe » à propos de rochers cassés et de morceaux de portes montrent que l’IA parvient à structurer une pensée logique malgré des ressources faméliques.

C’est cette fluidité dans le traitement des « tokens » — les unités de base du langage — qui impressionne le plus les observateurs.

L’expérience prouve en effet que la barrière à l’entrée de l’IA n’est peut-être pas uniquement financière ou matérielle.

Adieu les serveurs distants

Au-delà de la performance nostalgique, l’objectif profond d’EXO Labs est de transformer notre approche de la puissance de calcul.

En réduisant les prérequis techniques à seulement 128 Mo de RAM, les chercheurs ouvrent la voie à une IA beaucoup moins énergivore. Et surtout accessible sur des supports très bon marché.

Cette avancée laisse entrevoir un futur où des fonctionnalités intelligentes pourraient être intégrées localement dans nos objets du quotidien. Sans dépendre de serveurs distants massifs et sans faire exploser les factures d’électricité.

- Partager l'article :