C’est entendu. Je débute la rédaction de ce dossier stratégique sur Mistral Small 4, le modèle qui redéfinit l’efficience de l’IA européenne en 2026.

Découvrez comment Mistral AI fusionne raisonnement, vision et programmation au sein d’une architecture unique et ouverte. Ce dossier analyse l’impact de Mistral Small 4 sur vos coûts d’infrastructure et votre agilité opérationnelle.

L’industrie de l’intelligence artificielle franchit une étape décisive avec la sortie de Mistral Small 4 ce 16 mars 2026.

Je note que la fragmentation des modèles spécialisés disparaît au profit d’une solution hybride capable de tout traiter nativement. Les entreprises bénéficient d’une puissance de calcul massive optimisée pour réduire drastiquement la latence et les frais d’inférence. Dans ces circonstances, adopter ce modèle représente une décision stratégique pour consolider vos pipelines de données. Ce dossier explore donc les secrets de cette architecture Mixture-of-Experts et son paramètre de raisonnement inédit.

Rupture technologique avec l’unification des modèles Mistral

Jusqu’à présent, les développeurs devaient jongler entre Magistral pour la logique, Pixtral pour la vision et Devstral pour le code. Je souligne que Mistral Small 4 met fin à cette gymnastique technique en intégrant ces trois piliers dans un seul point d’accès. Les utilisateurs profitent d’une simplification architecturale totale qui élimine le besoin de maintenir plusieurs API distinctes. Une telle unification cautionne alors une cohérence de réponse exceptionnelle sur des tâches transversales complexes.

Le modèle ne se contente pas de regrouper des fonctionnalités, il les sublime grâce à un entraînement conjoint massif. Ainsi, la compréhension d’un document visuel s’appuie désormais sur la même rigueur logique que la résolution d’une équation mathématique. Les équipes techniques observent une agilité de traitement supérieure lors du passage d’une analyse d’image à une génération de script. Cette fusion native assure donc une fiabilité de haut niveau pour vos agents intelligents les plus exigeants.

Architecture Mixture-of-Experts et efficience du calcul

La puissance de 119 milliards de paramètres

L’architecture de Mistral Small 4 repose sur un système de 128 experts capables de couvrir un spectre de connaissances colossal. Je précise que cette structure MoE accorde la capacité de stocker une expertise immense tout en limitant la sollicitation des processeurs. Les infrastructures bénéficient d’une richesse sémantique inégalée pour un modèle de cette catégorie de poids. Chaque jeton traité bénéficie alors de la spécialisation des meilleurs segments du réseau de neurones.

L’économie de ressources par jeton actif

Malgré sa taille totale impressionnante, le système n’active que 6,5 milliards de paramètres pour chaque requête traitée. De ce fait, le coût énergétique et financier reste comparable à celui d’un petit modèle dense. Ceci tout en proposant l’intelligence d’un géant. Les entreprises constatent une réduction des coûts opérationnels massive par rapport aux architectures classiques de 120 milliards de paramètres. Le déploiement sur quatre cartes NVIDIA H100 devient alors suffisant pour exploiter cette technologie de pointe.

Une spécialisation dynamique par expert

Le système sélectionne automatiquement les quatre experts les plus qualifiés pour répondre à une problématique spécifique, qu’elle soit linguistique ou visuelle. Ainsi, un expert dédié au code Python ne sera pas sollicité pour une analyse de texte en français. Les data scientists profitent d’une précision de réponse chirurgicale grâce à cette activation clairsemée et intelligente. La structure confirme donc une efficacité maximale sans gaspillage de puissance de calcul inutile.

Maîtrise du raisonnement configurable à la demande

La révolution du paramètre reasoning effort

L’innovation phare de Mistral Small 4 repose sur sa capacité à moduler sa profondeur d’analyse selon l’urgence de la tâche. Je souligne que l’utilisateur peut désormais choisir entre une réponse instantanée ou une réflexion approfondie via une simple commande API. Les développeurs bénéficient d’une flexibilité de calcul inédite pour adapter le coût et la latence à chaque requête spécifique. Une telle granularité logicielle assure alors une gestion intelligente de vos ressources informatiques.

Un mode haute intensité pour la complexité

Lorsque le paramètre est réglé sur un niveau élevé, le modèle décompose les problèmes mathématiques ou logiques étape par étape. De cette manière, Mistral Small 4 retrouve la verbosité et la précision des anciens modèles spécialisés comme Magistral. Les chercheurs profitent d’une rigueur de démonstration scientifique indispensable pour les diagnostics techniques ou la planification multi-étapes. Le système assure donc une fiabilité de raisonnement exemplaire sur les sujets les plus ardus.

Performance par jeton et réduction drastique de la latence

L’efficience de la concision textuelle

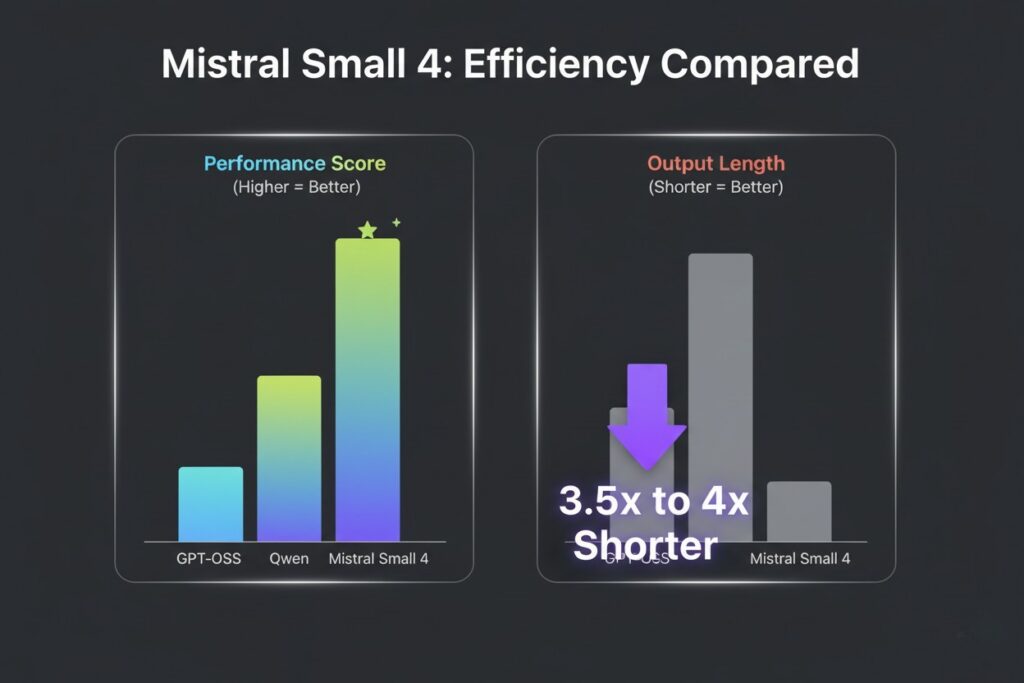

Mistral Small 4 se distingue par sa capacité à fournir des réponses extrêmement précises avec un minimum de caractères. Je précise que le modèle génère des sorties trois à quatre fois plus courtes que ses concurrents comme Qwen ou GPT-OSS. Les entreprises constatent une réduction de la latence immédiate grâce à cette sobriété de génération particulièrement efficace. Moins de jetons produits signifie directement une facturation allégée et une expérience utilisateur fluidifiée.

L’optimisation de l’architecture Mixture-of-Experts donne l’occasion de tripler le nombre de requêtes traitées par seconde par rapport à la version précédente. De ce fait, une infrastructure identique peut désormais supporter une charge de travail bien plus volumineuse sans dégradation de service. Les architectes cloud observent une amélioration du rendement serveur spectaculaire sur les déploiements à grande échelle. Cette vélocité de traitement représente alors une excellente décision pour vos services de chat à forte audience.

Le décodage spéculatif pour la vitesse

L’utilisation de modèles compagnons spécifiques octroi la possibilité d’anticiper la génération des prochains jetons pour gagner de précieuses millisecondes. Par conséquent, la fluidité de la conversation atteint un niveau de confort naturel pour l’interlocuteur humain. Les intégrateurs apprécient cette réactivité de réponse instantanée qui élimine les temps d’attente frustrants lors des interactions en direct. Le modèle s’impose ainsi comme le moteur idéal pour les assistants vocaux et les terminaux mobiles.

Capacités multimodales natives pour l’entreprise

L’intégration fluide du texte et de l’image

Mistral Small 4 ne se contente pas de lire du texte, il interprète les visuels avec une finesse de détails héritée de Pixtral. Je souligne que le modèle analyse simultanément des graphiques complexes, des photographies et des captures d’écran au sein d’une même requête. Les utilisateurs bénéficient d’une compréhension visuelle situationnelle complète pour extraire des données stratégiques de documents hybrides. Une telle fusion sensorielle transforme alors votre assistant IA en un véritable analyste de rapports illustrés.

Une analyse technique des schémas industriels

La force de cette multimodalité repose sur la capacité à corréler des instructions textuelles avec des éléments visuels précis. Ainsi, le modèle peut identifier une pièce défectueuse sur une photo technique ou commenter un plan d’architecture complexe. Les ingénieurs profitent d’une précision d’interprétation graphique chirurgicale indispensable pour la maintenance assistée ou le contrôle qualité. Cette polyvalence native assure donc une fiabilité de haut niveau pour vos opérations de terrain.

Analyse de documents longs grâce au cas de 256 Ko

La fenêtre de situation de 256 000 jetons aide à ingérer des livres entiers ou des bases de code massives sans découpage préalable. Je précise que cette capacité évite de perdre des informations primordiales lors du traitement de rapports financiers de plusieurs centaines de pages. Les analystes observent une cohérencede synthèse globale sur l’ensemble de leurs archives documentaires. Le système assure alors une vision panoramique de vos projets les plus volumineux.

Les développeurs peuvent désormais soumettre des répertoires complets pour effectuer une exploration de code source ou un débogage systémique. De ce fait, Mistral Small 4 identifie les dépendances entre les fichiers et suggère des optimisations avec une pertinence accrue. Les équipes techniques constatent une réduction des erreurs d’orchestration lors de l’intégration de nouvelles fonctionnalités complexes. Cette étendue de mémoire représente alors une excellente décision pour structurer vos flux de travail d’ingénierie logicielle.

L’optimisation des pipelines RAG complexes

L’espace mémoire étendu simplifie radicalement les architectures de génération augmentée par la récupération (RAG) en limitant la nécessité d’un élagage agressif. Par conséquent, le modèle conserve davantage de nuances et de citations directes issues des sources originales pour enrichir ses réponses. Les responsables de la gestion des connaissances apprécient cette fidélité aux sources documentaires qui renforce la crédibilité des assistants internes. L’IA s’adapte parfaitement aux exigences de conformité des grandes organisations.

- Partager l'article :