ACE Robotics révèle des technologies révolutionnaires de robotique.

Trois innovations clés transforment la robotique en applications réelles.

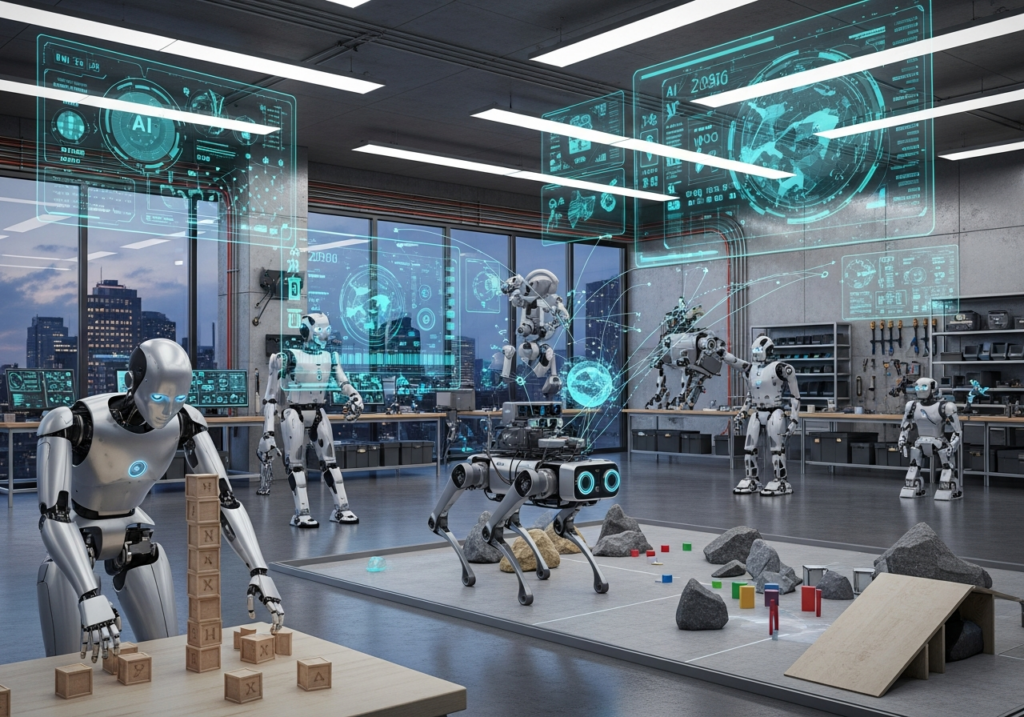

SenseTime, via sa filiale ACE Robotics, a dévoilé une nouvelle pile technologique complète. Ces avancées visent à faire passer l’intelligence incarnée des laboratoires vers des usages industriels. Elles combinent collecte de données, modélisation avancée et exécution robotique dans des environnements complexes. Cette annonce pourrait bien accélérer l’adoption de l’IA incarnée dans de nombreux secteurs.

Une nouvelle ère pour l’IA incarnée

ACE Robotics, soutenu par SenseTime, a notamment présenté trois technologies majeures pour l’intelligence incarnée le 18 décembre 2025. Ces innovations doivent d’ailleurs transformer la recherche en applications réelles. Elles combinent R&D centrée sur l’humain et modélisation avancée des interactions physiques.

La première est le paradigme de R&D incarné, fondé sur la collecte de données environnementales massives. Cette base alimente un pipeline technique unique couvrant la chaîne complète : des données brutes à l’interaction robotique. C’est une étape majeure vers des robots réellement polyvalents et autonomes.

Le paradigme de R&D incarné d’ACE

Collecte des données et compréhension du monde

Le paradigme d’ACE se concentre sur l’humain et son interaction avec l’environnement. Il repose sur des dizaines de millions d’heures de données collectées annuellement. Ces données comprennent des vidéos, des mesures de capteurs et des annotations comportementales.

Cette collecte enrichit une base de données multidimensionnelle « humain‑objet‑scène ». Cette richesse permet une modélisation plus précise des interactions complexes. De plus, l’approche favorise une meilleure compréhension contextuelle des tâches réalisées par des robots.

Un pipeline complet pour la robotique

Le processus débutant avec la collecte de données se poursuit avec le modèle du monde Kairos 3.0, puis l’interaction incarnée. Ainsi, les données brutes deviennent des modèles exploitables qui pilotent des robots dans des environnements réels. Ce pipeline réduit les écarts entre simulation et exécution.

L’intégration de ce système étend la capacité des robots à apprendre sur de longues durées. Elle améliore aussi la précision des interactions physiques avec les objets et les humains. En outre, cette base vise à réduire les temps de développement pour les applications robotiques avancées.

Kairos World Model 3.0 au cœur de la simulation

Une architecture multimodale avancée

Kairos 3.0 se présente comme un modèle du monde multimodal intégrant compréhension, génération et prédiction. Il est conçu pour capturer simultanément la physique et le comportement humain. Cela permet de prédire des scénarios d’interaction complexes à long terme.

Avec cette modélisation, les développeurs peuvent générer des simulations de tâches à l’aide d’instructions simples. Kairos 3.0 prend en charge 115 scénarios spécifiques à différents secteurs. Ainsi, il facilite le prototypage de tâches dans des environnements variés, du logistique à la maintenance industrielle.

Compatibilité étendue avec le matériel

Kairos 3.0 a déjà été adapté à plusieurs types de puces d’IA fabriquées en Chine. Parmi elles figurent celles de Moore Threads, Biren Technology et Sugon. Cette polyvalence assure une intégration fluide dans des plateformes matérielles diverses.

De plus, l’adoption par différents fabricants accélère l’écosystème technologique autour de l’IA incarnée. Cela renforce la compétitivité de l’industrie chinoise face aux solutions étrangères. Ainsi, les innovations de Kairos 3.0 peuvent s’étendre rapidement à des robots du monde réel.

Le module A1 Embodied Super Brain

Un super cerveau pour robots physiques

Le module A1 Embodied Super Brain est une autre avancée importante annoncée par ACE Robotics. Effectivement, il permet une interaction basée sur le cloud entre le langage naturel, la perception visuelle et l’exécution robotique. Ce super cerveau convertit des instructions complexes en actions réalisables par des robots physiques.

Grâce à A1, les plateformes robotiques peuvent effectuer des inspections, des évitements d’obstacles et d’autres tâches complexes. Ces actions sont réalisables dans des environnements dynamiques et changeants. Ainsi, les robots deviennent plus adaptatifs et utiles dans des contextes pratiques.

Applications concrètes et perspectives

Des robots comme les chiens robots ou les plateformes mobiles bénéficieront directement de ce module. Effectivement, A1 permet une meilleure compréhension des environnements riches et variés. Il améliore la robustesse des systèmes robotiques face à des situations imprévues.

De plus, la combinaison de Kairos 3.0 et d’A1 permet de créer des robots qui planifient et réagissent en temps réel. Cela fait passer la robotique incarnée d’un stade expérimental à une maturité industrielle tangible. Cette évolution ouvre la voie à une adoption plus rapide dans l’automatisation intelligente.

- Partager l'article :