La technologie de l’IA, souvent perçue comme un outil révolutionnaire, a été utilisée à des fins destructrices lors d’un incident choquant à Las Vegas. Matthew Livelsberger, un ancien Béret vert, a orchestré une attaque en utilisant ChatGPT pour planifier chaque étape. Cette affaire soulève des questions inquiétantes sur l’utilisation des technologies avancées dans des contextes dangereux.

Une attaque planifiée avec l’aide de l’intelligence artificielle

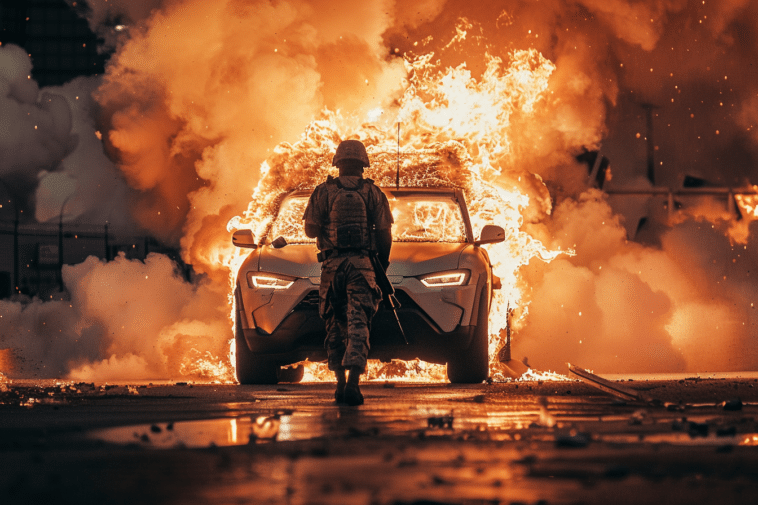

Le 37 janvier 2025, un Tesla Cybertruck a explosé devant l’hôtel Trump International à Las Vegas. Matthew Livelsberger, vétéran de l’armée américaine est derrière cette attaque. La police de Las Vegas a révélé que l’attaque avait été minutieusement préparée avec l’aide de ChatGPT, un outil d’IA générative populaire.

Livelsberger avait utilisé ChatGPT pour obtenir des informations précises sur les explosifs, la vitesse des cartouches et la légalité des feux d’artifice en Arizona. Ces recherches montrent les possibilités de détournement de l’IA à des fins dangereuses. Malgré la violence de l’explosion, qui a fait sept blessés légers, les dégâts matériels sont restés minimes. Selon les autorités, l’objectif n’était pas de causer des destructions massives, mais d’envoyer un « signal d’alarme » au pays.

Des motivations complexes mêlant politique et traumatisme personnel

L’attaque de Livelsberger n’était pas un acte isolé. Il a laissé des notes détaillant ses luttes personnelles et ses motivations profondes. Parmi celles-ci, il exprimait un besoin de « purifier » son esprit des traumatismes de guerre et de se libérer du poids des vies prises au combat.

Dans ses lettres, il dénonçait ce qu’il percevait comme un déclin irréversible des États-Unis en évoquant des sujets comme la guerre en Ukraine et les divisions internes. Fait surprenant, il n’exprimait aucune animosité envers le président élu Donald Trump ni envers Elon Musk. Au contraire, il appelait les citoyens à s’unir derrière ces figures pour éviter l’effondrement.

Un cas isolé, mais des implications inquiétantes

L’attaque de Livelsberger a coïncidé avec une autre attaque à la Nouvelle-Orléans, où un camion a tué 14 personnes. Bien que les deux incidents ne soient pas liés, ils soulignent une tendance préoccupante dans l’utilisation de technologies avancées pour planifier des actes malveillants.

Les forces de l’ordre continuent d’examiner le téléphone, l’ordinateur portable et la montre de Livelsberger pour comprendre pleinement l’ampleur de ses préparatifs. L’IA, dans cette affaire, met en lumière les risques croissants liés à ces technologies, souvent détournées à des fins malveillantes.

La nécessité de réglementer l’IA pour éviter les abus

Ce drame soulève des questions cruciales sur la régulation de l’IA et son potentiel de détournement. Alors que ChatGPT et des outils similaires sont conçus pour aider, ils peuvent facilement devenir des armes entre de mauvaises mains. Cet événement tragique rappelle l’importance de garde-fous technologiques, pour prévenir de tels abus.

Avec l’essor rapide de l’intelligence artificielle, les autorités doivent notamment anticiper et combler les lacunes permettant l’exploitation de ces outils. Ainsi, il devient crucial de garantir que la technologie serve à améliorer la société, et non à l’endommager.

- Partager l'article :